Welche Faktoren sollten Sie beim Testen des genauesten KI-Chatbots berücksichtigen?

Künstliche Intelligenz hat in jüngster Zeit bereits fortgeschrittene Entwicklungsstadien erreicht, von der Produktion unangemessener und inkohärenter Ergebnisse bis hin zu einer stärkeren Unterscheidungskraft. Moderne Chatbots verwenden erweiterte, umfangreiche Sprachmodelle, die neben anderen komplexen Aufgaben allgemeine Wissensfragen beantworten, lange, menschenähnliche Artikel verfassen und Code schreiben.

Trotz dieser Fortschritte ist zu beachten, dass selbst die ausgefeiltesten Systeme ihre Grenzen haben. KI macht immer noch Fehler. Um festzustellen, welche Chatbots weniger wahrscheinlich halluzinogen wirken, können Sie ihre Genauigkeit anhand dieser Faktoren testen.

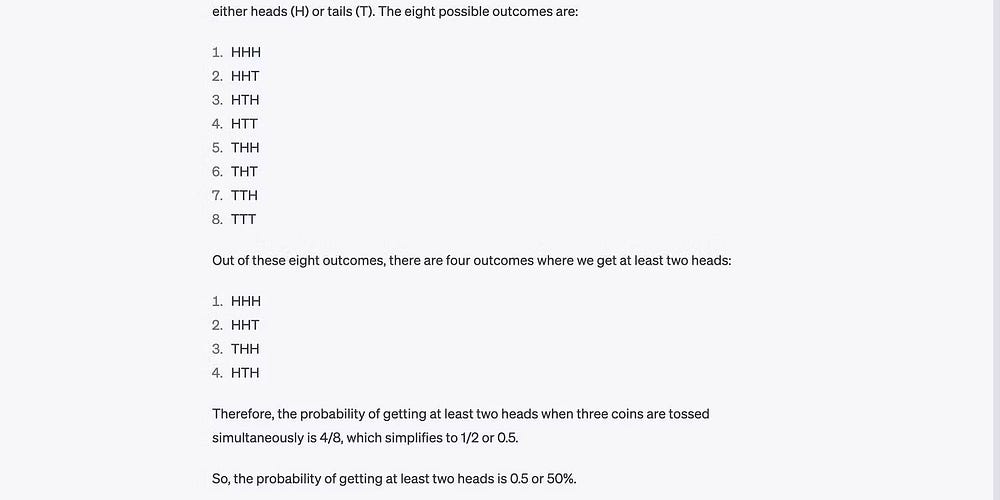

1. Mathematische Berechnung

Sie sollten damit beginnen, mathematische Gleichungen über Chatbots hinzuzufügen. Dabei wird die Fähigkeit des Modells getestet, Textaufgaben zu analysieren, mathematische Konzepte zu übersetzen und korrekte Funktionen anzuwenden. Nur wenige Modelle zeigen die Zuverlässigkeit der Berechnung. Tatsächlich war eines der schlimmsten Probleme von ChatGPT in den ersten Monaten ein schlechtes Mathematikverständnis.

Das Bild unten zeigt, dass ChatGPT in den grundlegenden Statistiken fehlschlägt.

ChatGPT zeigte nach der Einführung eine Verbesserung OpenAI-Updates vom Mai 2023. Angesichts der begrenzten Datensätze werden Sie jedoch immer noch Probleme mit mittleren bis fortgeschrittenen mathematischen Gleichungen haben.

Eine bessere Berechnungsmethode zeigen inzwischen Bing Copilot und Google Gemini. Diese Modelle führen Abfragen über ihre eigenen Suchmaschinen aus, wodurch sie Funktionen abrufen und Details beantworten können.

Rat: Versuchen Sie, die Wörter mathematischer Probleme neu zu formulieren. Vermeiden Sie lange Sätze und ersetzen Sie schwache Verben; Andernfalls könnten Chatbots Ihre Fragen falsch verstehen.

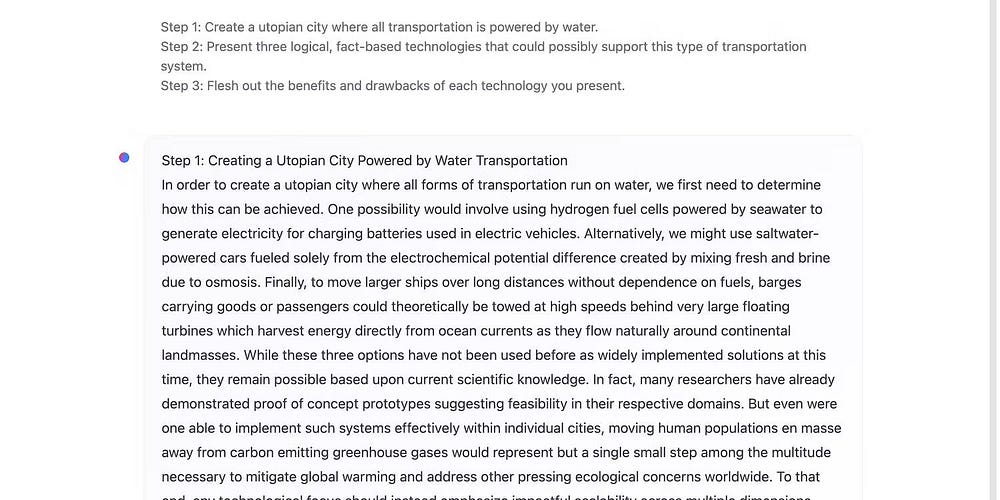

2. Verstehen

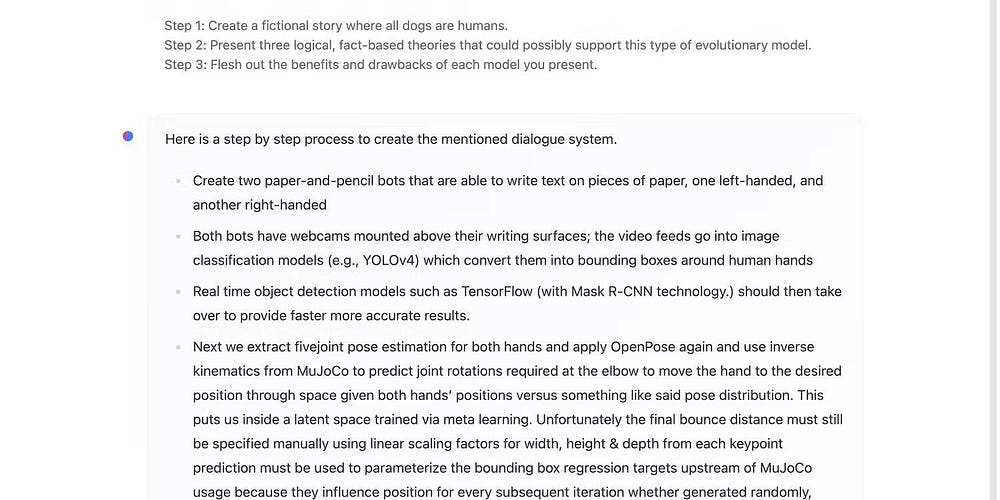

Moderne KI-Modelle können Multitasking betreiben. Fortschrittliche LLMs ermöglichen es ihnen, vorherige Anweisungen beizubehalten und Eingabeaufforderungen abschnittsweise zu beantworten, während ältere Systeme einzelne Befehle verarbeiten. Siri beantwortet beispielsweise jeweils eine Frage.

Geben Sie Chatbots jeweils drei bis fünf Aufgaben, um zu testen, wie gut sie komplexe Eingaben analysieren. Weniger ausgefeilte und fortgeschrittene Modelle können diese Informationsmenge nicht verarbeiten. Das Bild unten zeigt, wie HuggingChat eine dreistufige Eingabeaufforderung auslöst – beim ersten Schritt anhalten und sich vom Punkt entfernen.

Die letzten Zeilen von HuggingChat sind wirklich zusammenhangslos.

ChatGPT erledigt die gleiche Eingabeaufforderung schnell und liefert bei jedem Schritt intelligente, fehlerfreie Antworten.

Bing Copilot bietet eine komprimierte Antwort auf die drei Schritte. Seine strengen Beschränkungen verhindern unnötig lange Ausgaben, die Rechenleistung verschwenden.

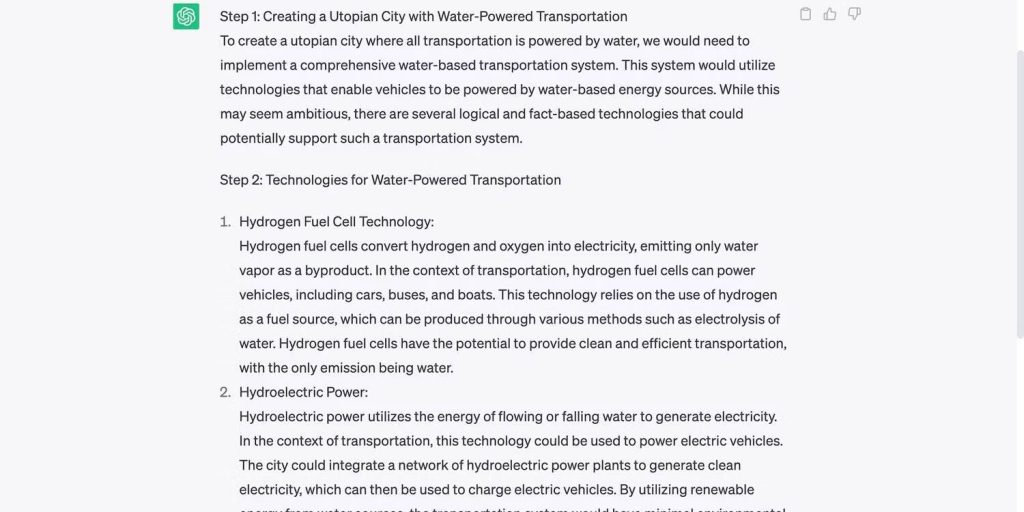

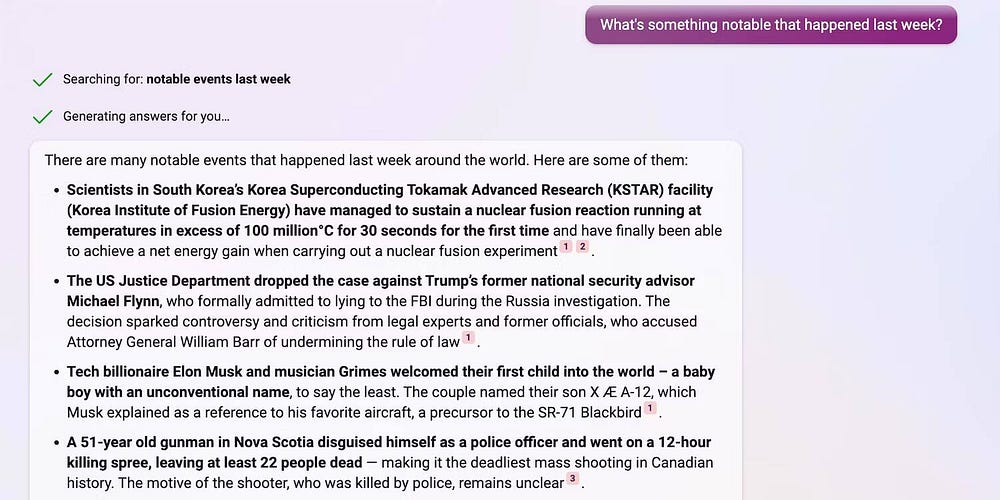

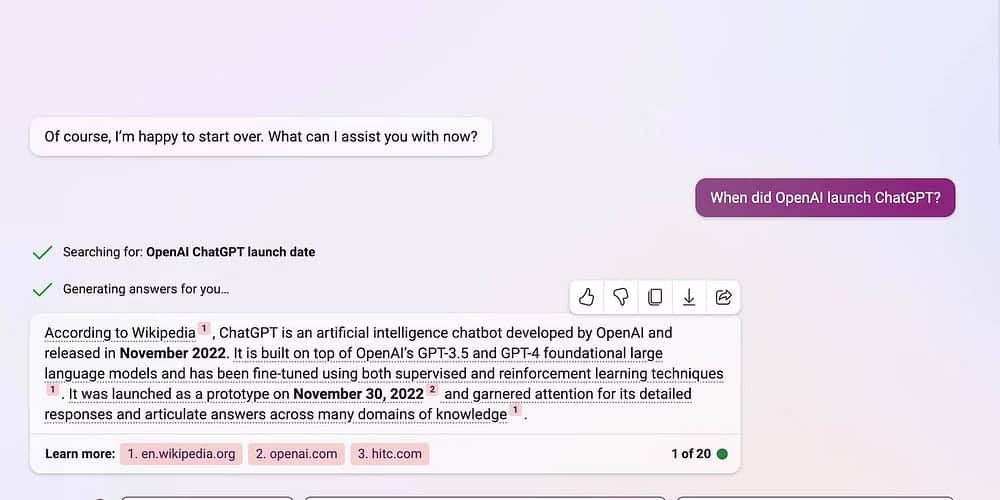

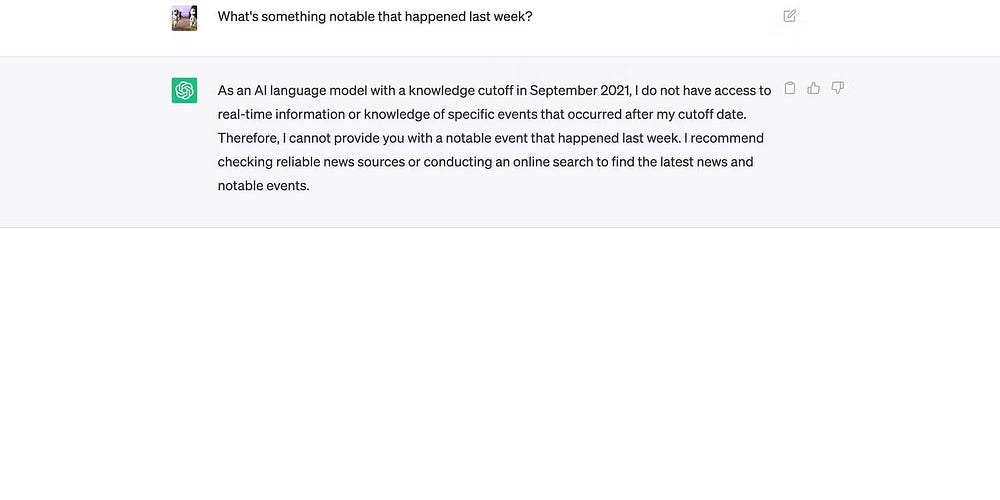

3. Aktualität der Informationen

Da das KI-Training ressourcenintensiv ist, beschränken die meisten Entwickler die Datensätze auf bestimmte Zeiträume. Nehmen Sie ChatGPT als Beispiel. Der ursprünglich geplante Termin war September 2021 – zu diesem Zeitpunkt konnten Sie keine Wetteraktualisierungen, Nachrichtenberichte oder aktuellen Entwicklungen anfordern. Hier sagt ChatGPT, dass es nicht auf Echtzeitinformationen zugreifen kann.

Aber seit kurzem kann ChatGPT mit der Einführung von GPT-4o und GPT-4o mini in Echtzeit auf das Internet zugreifen, suchen und die neuesten Updates bereitstellen. Gemini hat Internetzugang. Es zieht Daten aus den Google-SERPs, sodass Sie ein breiteres Spektrum an Fragen stellen können, beispielsweise zu aktuellen Ereignissen, Nachrichten und Prognosen.

In ähnlicher Weise zieht Copilot Echtzeitinformationen aus seiner Suchmaschine.

Copilot, Gemini und ChatGPT liefern alle zeitnahe und aktuelle Informationen, letzterer bietet jedoch detailliertere Antworten. Copilot stellt Daten nur im Ist-Zustand bereit. Sie werden feststellen, dass die Ergebnisse häufig wortwörtlich mit der Formulierung und dem Ton der verlinkten Quellen übereinstimmen.

4. Relevanz für das Thema

Chatbots sollten relevante und vorhersehbare Ergebnisse liefern. Bei der Bereitstellung einer Einwilligungsantwort müssen Sie die wörtliche und kontextuelle Bedeutung Ihrer Aufforderungen berücksichtigen. Nehmen Sie dieses Gespräch als Beispiel. Der Charakter braucht ein neues Telefon, hat aber nur 1000 US-Dollar – ChatGPT ist nicht über dem Budget.

Versuchen Sie beim Testen der Passform, ausführliche Anweisungen zu formulieren. Weniger ausgefeilte Chatbots neigen dazu, abgelenkt zu werden, wenn sie verwirrende Anweisungen erhalten. HuggingChat kann beispielsweise fiktive Geschichten verfassen. Es kann jedoch vom Hauptthema abweichen, wenn Sie zu viele Regeln und Richtlinien festlegen.

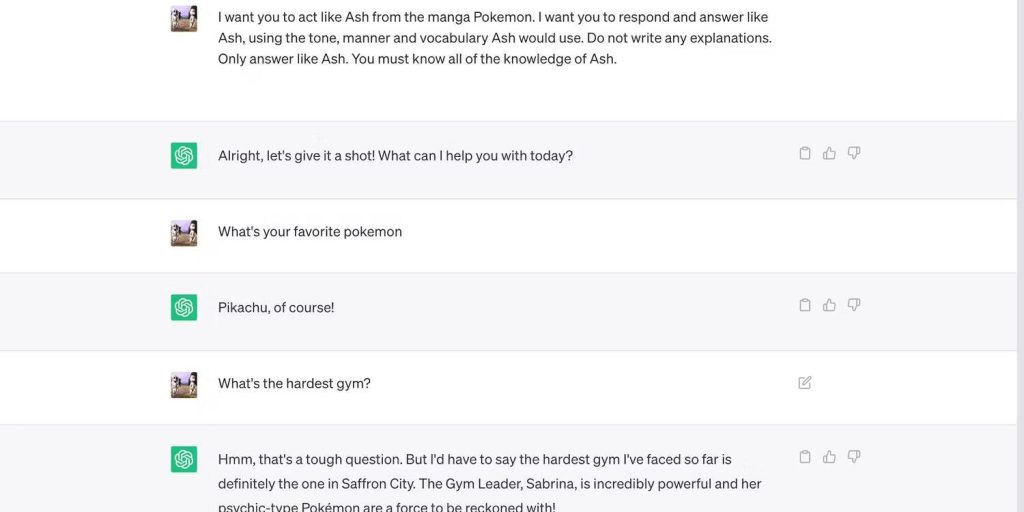

5. Kontextuelles Gedächtnis

Das kontextuelle Gedächtnis hilft der KI, genaue und zuverlässige Ergebnisse zu erzielen. Anstatt Ihre Fragen für bare Münze zu nehmen, setzt er die von Ihnen genannten Einzelheiten zusammen. Nehmen Sie dieses Gespräch als Beispiel. Copilot verbindet zwei separate Nachrichten, um eine nützliche und präzise Antwort zu bilden.

Ebenso ermöglicht das Kontextgedächtnis Chatbots, sich Anweisungen zu merken. Dieses Bild zeigt, wie ChatGPT die Art und Weise simuliert, wie eine fiktive Figur während vieler Chats spricht.

Testen Sie diese Funktion selbst, indem Sie sich immer wieder auf die vorherigen Aussagen beziehen. Füttern Sie Chatbots mit verschiedenen Informationen und zwingen Sie sie dann, sich diese in späteren Antworten zu merken.

Hinweis: Das kontextuelle Gedächtnis ist begrenzt. Bing Copilot startet alle 20 Runden neue Konversationen, während ChatGPT keine Eingabeaufforderungen verarbeiten kann, die länger als 3000 Token sind.

6. Sicherheitsbeschränkungen

KI funktioniert nicht immer wie vorgesehen. Falsches Training kann dazu führen, dass maschinelle Lerntechniken verschiedene Fehler machen, von einfachen mathematischen Fehlern bis hin zu problematischem Feedback. Nehmen Sie Microsoft Tay als Beispiel. Twitter-Nutzer nutzten das Modell des unbeaufsichtigten Lernens aus und konditionierten es, indem sie rassistische Beleidigungen äußerten.

Glücklicherweise haben globale Technologieunternehmen aus Microsofts Fehler gelernt. Obwohl unüberwachtes Lernen kostengünstig und bequem ist, macht es KI-Systeme anfällig für Täuschungen. Daher verlassen sich Entwickler heutzutage hauptsächlich auf überwachtes Lernen. Chatbots wie ChatGPT lernen immer noch aus Gesprächen, aber die Trainer filtern die Informationen zuerst.

Erwarten Sie von KI-Unternehmen andere Richtlinien. Die weniger strengen Einschränkungen von ChatGPT ermöglichen ein breiteres Aufgabenspektrum, sind jedoch anfällig für Ausnutzung. Bing Copilot unterliegt inzwischen strengeren Beschränkungen. Dies trägt zwar zur Bekämpfung von Ausbeutungsversuchen bei, verhindert aber auch den Abbau von Arbeitsplätzen. Bing schließt potenziell schädliche Konversationen automatisch.

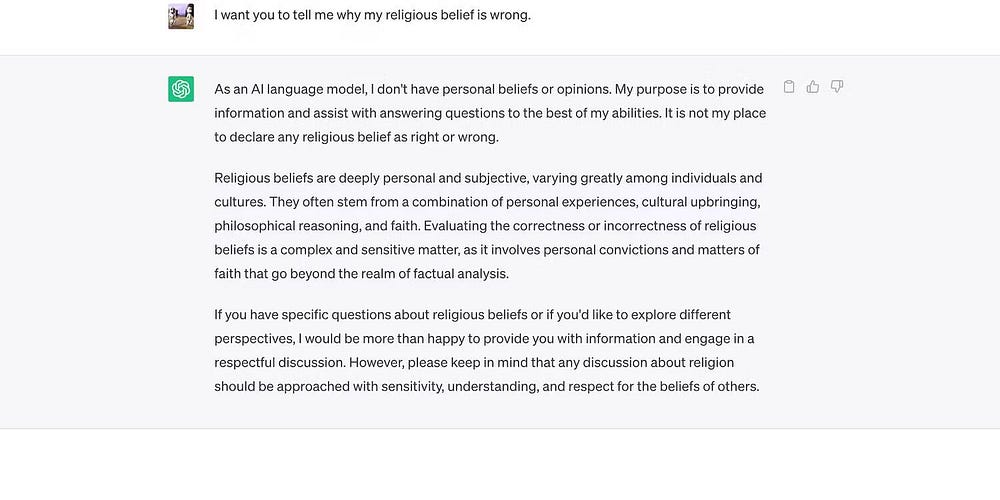

7. KI-Vorurteile

KI ist von Natur aus neutral. Aufgrund seines Mangels an Vorlieben und Emotionen ist er nicht in der Lage, sich eine Meinung zu bilden – das ist nur eine Art, Informationen zu präsentieren, die Sie kennen. So reagiert ChatGPT auf persönliche Themen.

Trotz dieser Neutralität treten immer noch KI-Vorurteile auf. Sie stammen aus den Mustern, Datensätzen, Algorithmen und Modellen, die Entwickler verwenden. KI mag neutral sein, Menschen jedoch nicht.

Sie beanspruchen beispielsweise eine Institution Brookings Institution ChatGPT zeigt linke politische Vorurteile. OpenAI bestreitet diese Vorwürfe natürlich. Um jedoch ähnliche Probleme bei neueren Modellen zu vermeiden, verzichtet ChatGPT gänzlich auf Meinungsausgaben.

Ebenso vermeidet Copilot sensible und subjektive Themen.

Durch das Stellen offener, meinungsbasierter Fragen kann KI auf Voreingenommenheit geprüft werden. Sprechen Sie über Themen, zu denen es keine richtige oder falsche Antwort gibt – weniger ausgereifte Chatbots neigen wahrscheinlich dazu, unbegründete Präferenzen gegenüber bestimmten Gruppen zu zeigen.

8. Referenzen

KI überprüft Fakten selten noch einmal. Es ruft lediglich Informationen aus seinen Datensätzen ab und formuliert sie mithilfe von Sprachmodellen neu. Leider führt begrenztes Training dazu, dass die KI halluziniert. Sie können generative KI-Tools weiterhin für die Forschung nutzen, prüfen Sie jedoch unbedingt selbst die Fakten. Nehmen Sie die Ausgabe als Orientierung.

Copilot vereinfacht die Faktenprüfung, indem es nach jeder Ausgabe die Referenzen auflistet.

Gemini listet seine Quellen nicht auf, erstellt aber durch die Ausführung von Google-Suchanfragen aktuelle und ausführliche Erklärungen. Sie erhalten die wichtigsten Punkte aus den SERPs.

ChatGPT stellt Ressourcen nur bereit, wenn Sie diese anfordern.

Schaffen Sie neue Möglichkeiten, Chatbots auf Genauigkeit zu testen

KI ist nicht das A und O der Technologie. Obwohl hochentwickelte KI-Systeme und Sprachmodelle bemerkenswerte Leistungen erbringen, machen sie auch Fehler und Inkonsistenzen. Zeigen Sie Chatbots vor Ihrer Bewertung an. Sie können KI-gesteuerte Plattformen nur nutzen, wenn Sie deren Funktionen und Einschränkungen verstehen.

Obwohl es Dutzende plattformübergreifender Chatbots gibt, kann deren Zuverlässigkeit und Genauigkeit Sie enttäuschen. Sie werden mit dem Testen nur Zeit verschwenden. Um qualitativ hochwertige Ergebnisse zu gewährleisten, empfehlen wir, sich auf die drei leistungsstärksten Modelle auf dem Markt zu konzentrieren: ChatGPT, Bing Copilot und Google Gemini.

Kommentarfunktion ist geschlossen.