Googles KI-Fehler: Halluzinierende Redewendungen und beliebte Sprichwörter

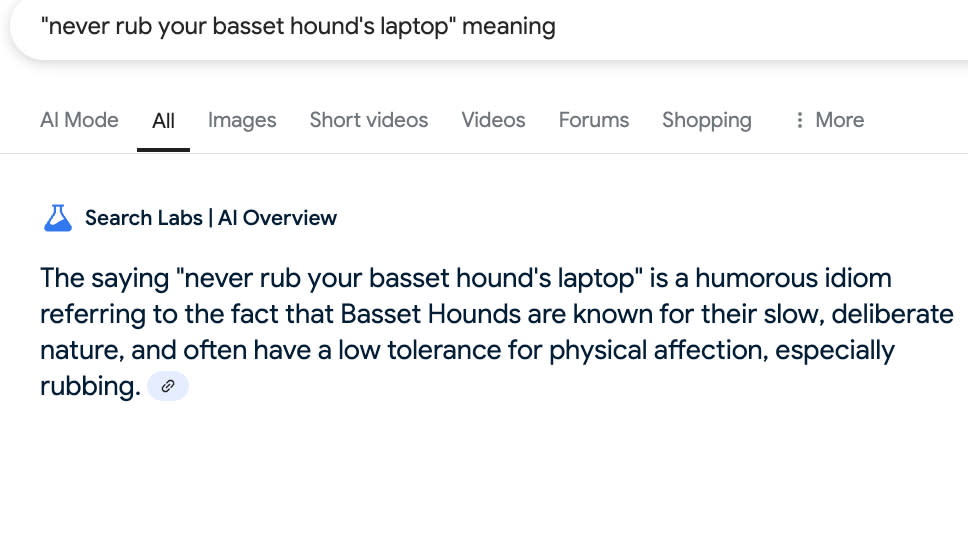

Der neuste KI-Trend ist urkomisch. Ein Benutzer hat herausgefunden, dass man in die Google-Suche eine falsche Phrase eingeben und das Wort „Bedeutung“ hinzufügen kann. Anschließend generiert die Funktion „AI Overview“ von Google basierend auf Ihrer Vorstellungskraft eine Bedeutung für diesen Ausdruck.

Der Historiker Greg Jenner löste diese Welle mit einem Beitrag auf Bluesky Er bat Google, die Bedeutung des Satzes „Einen Dachs kann man nicht zweimal lecken“ zu erklären. Die Funktion „KI-Übersicht“ erklärt hilfreich, dass dieser Ausdruck bedeutet, dass man jemanden nicht ein zweites Mal täuschen kann, nachdem er bereits einmal getäuscht wurde – was eine vernünftige Erklärung zu sein scheint, ignoriert jedoch die Tatsache, dass der Begriff nicht existierte, bevor diese Abfrage weit verbreitet war.

Seitdem haben die Leute viel Spaß daran gehabt, die KI-Übersichtsfunktion dazu zu bringen, Begriffe wie „Ein Tintenfisch in einer Vase wird nicht schlecht über dich reden“ (Bedeutung Etwas außerhalb seiner natürlichen Umgebung könnte ihm offenbar keinen Schaden zufügen) oder „Sie können Ihren Hund an den Strand mitnehmen, aber Sie können ihn nicht in die Schweiz segeln“ (Und das ist es auchist laut der Funktion „AI Overview“ eine ziemlich eindeutige Aussage über die Schwierigkeiten internationaler Reisen mit Haustieren.

Seitdem haben die Leute viel Spaß daran gehabt, die KI-Übersichtsfunktion dazu zu bringen, Begriffe wie „Ein Tintenfisch in einer Vase wird nicht schlecht über dich reden“ (Bedeutung Etwas außerhalb seiner natürlichen Umgebung könnte ihm offenbar keinen Schaden zufügen) oder „Sie können Ihren Hund an den Strand mitnehmen, aber Sie können ihn nicht in die Schweiz segeln“ (Und das ist es auchist laut der Funktion „AI Overview“ eine ziemlich eindeutige Aussage über die Schwierigkeiten internationaler Reisen mit Haustieren.

Dies funktioniert jedoch nicht in allen Fällen, da einige Ausdrücke keine AI-Übersichtsergebnisse zurückgeben. Der Kognitionswissenschaftler Gary Marcus sagte Kabelgebunden„Es ist höchst inkonsistent, was man von GenAI auch erwarten würde.“

Jenner weist darauf hin, dass dies zwar unterhaltsam sei, aber auch auf einige potenzielle Risiken hinweise, die sich daraus ergeben, dass man sich bei der Informationsbeschaffung zu stark auf KI-generierte Quellen wie „AI Overview“ verlässt. كتب Jenner: „Es ist ein Warnsignal, dass eine der Kernfunktionen von Google – die Fähigkeit, ein Zitat auf seinen Wahrheitsgehalt zu überprüfen, eine Quelle zu verifizieren oder etwas Unvollständiges in Erinnerung zu behalten – viel schwieriger werden wird, wenn KI es vorzieht, statistische Wahrscheinlichkeiten gegenüber der tatsächlichen Wahrheit zu legitimieren.“

Dies ist nicht das erste Mal, dass auf die Grenzen der von der KI bereitgestellten Informationen hingewiesen wird, insbesondere der Funktion „KI-Übersicht“. Als der „KI-Überblick“ veröffentlicht wurde, enthielt er die berüchtigte Empfehlung, dass die Menschen täglich einen kleinen Stein essen sollten und dass sie Klebstoff auf ihre Pizza schmieren könnten. Diese konkreten Antworten wurden jedoch schnell wieder entfernt.

Seitdem hat Google erklärt, dass die meisten KI-Übersichten nützliche und sachliche Informationen liefern und dass es weiterhin Feedback zu seinem KI-Produkt sammelt.

Dies dient vorerst als Erinnerung daran, die Informationen im Feld „KI-Übersicht“ oben in den Google-Ergebnissen noch einmal zu überprüfen, da diese möglicherweise nicht korrekt sind.

Kommentarfunktion ist geschlossen.