Microsoft bringt Phi-4 auf den Markt: ein superinferenzielles KI-Modell als Konkurrenz zu DeepSeek R1

Zusammenfassung:

- Microsoft hat Phi-4-Inferenz-KI-Modelle auf den Markt gebracht, die mit 14 Milliarden bzw. 3.8 Milliarden Parametern trainiert wurden.

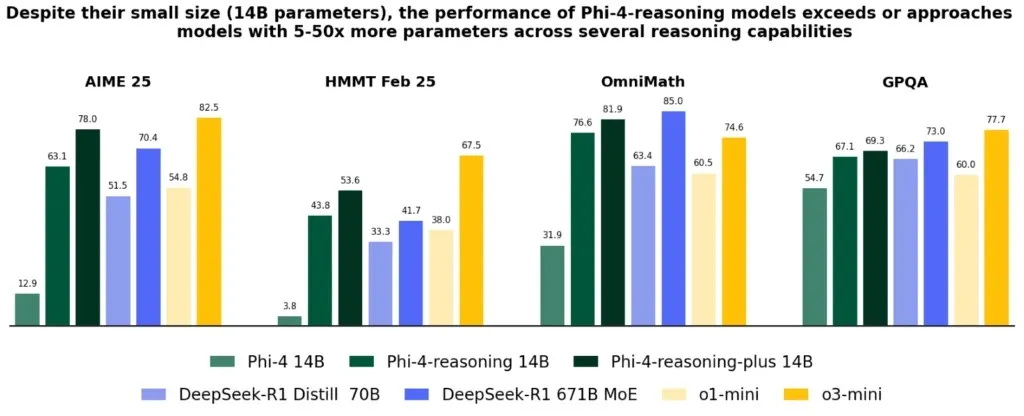

- Trotz ihrer geringen Größe konkurrieren die Phi-4-Inferenzmodelle mit viel größeren Modellen wie DeepSeek R1 und o3-mini.

- Laut Microsoft können Phi-4-Inferenzmodelle dank ihrer geringen Größe auf PCs mit Windows Copilot+ ausgeführt werden.

Microsoft hat drei neue deduktive KI-Modelle auf den Markt gebracht, darunter Phi-4-Reasoning, Phi-4-Reasoning-Plus und Phi-4-Mini-Reasoning. Dabei handelt es sich um kleine Sprachmodelle, konzipiert für Endgeräte wie Windows-Rechner und mobile Geräte. Das Phi-4-Reasoning-KI-Modell wird mit 14 Milliarden Parametern trainiert und kann komplexe Inferenzaufgaben ausführen.

Das Phi-4-Reasoning-Plus-Modell verwendet dasselbe Basismodell, nutzt jedoch eine zusätzliche Berechnung der Inferenzzeit, etwa die 1.5-fache Anzahl von Token im Vergleich zum Phi-4-Reasoning, um eine höhere Genauigkeit zu erzielen. Trotz der geringen Größe der Phi-4-Reasoning-Modelle sind sie konkurrenzfähig mit größeren Modellen wie: DeepSeek R1 671B und o3-mini.

Im GPQA-Standard erreicht das Phi-4-reasoning-plus-14B-Modell eine Punktzahl von 69.3 %, während das o3-mini 77.7 %. Als nächstes erreicht im AIME 2025-Test der Phi-4-Reasoning-Plus-14B 78 % und der o3-Mini 82.5 %. Es zeigt sich weiterhin, dass das kleine Modell von Microsoft den wichtigsten Inferenzmodellen, die wesentlich größer sind, sehr nahe kommt.

Laut Microsoft wurden die Phi-4-Inferenzmodelle durch überwachtes Feintuning trainiert.Zu sorgfältig kuratierten Inferenzdemonstrationen von OpenAI o3-mini. Darüber hinaus schreibt Microsoft: „Das Modell zeigt, dass kleinere Modelle durch eine genaue Datenformatierung und hochwertige synthetische Datensätze mit größeren Modellen konkurrieren können."

Abgesehen davon übertrifft das kleinere Phi-4-Mini-Reasoning-Modell, das mit nur 3.8 Milliarden Parametern trainiert wurde, viele 7B- und 8B-Modelle. Bei Benchmarks wie AIME 24, MATH 500 und GPQA Diamond liefert das Phi-4-mini-reasoning-3.8B-Modell konkurrenzfähige Ergebnisse und kommt dem o1-mini sehr nahe. Es wurde abgeschlossen"AnpassenPhi-4-Mini-ModellPräzise Verwendung synthetischer Daten, die vom Deepseek-R1-Modell generiert wurden"

Die Phi-Modelle von Microsoft werden bereits nativ auf Windows-Computern verwendet. Copilot+ PCsEs profitiert von der integrierten neuronalen Verarbeitungseinheit. Es wird interessant sein zu sehen, wie Phi-4-Inferenzmodelle die KI-Leistung auf dem Gerät verbessern.

Kommentarfunktion ist geschlossen.