OpenAI reagiert auf die Konkurrenz von DeepSeek mit detaillierter Gedankenverfolgungstechnologie für den o3-mini

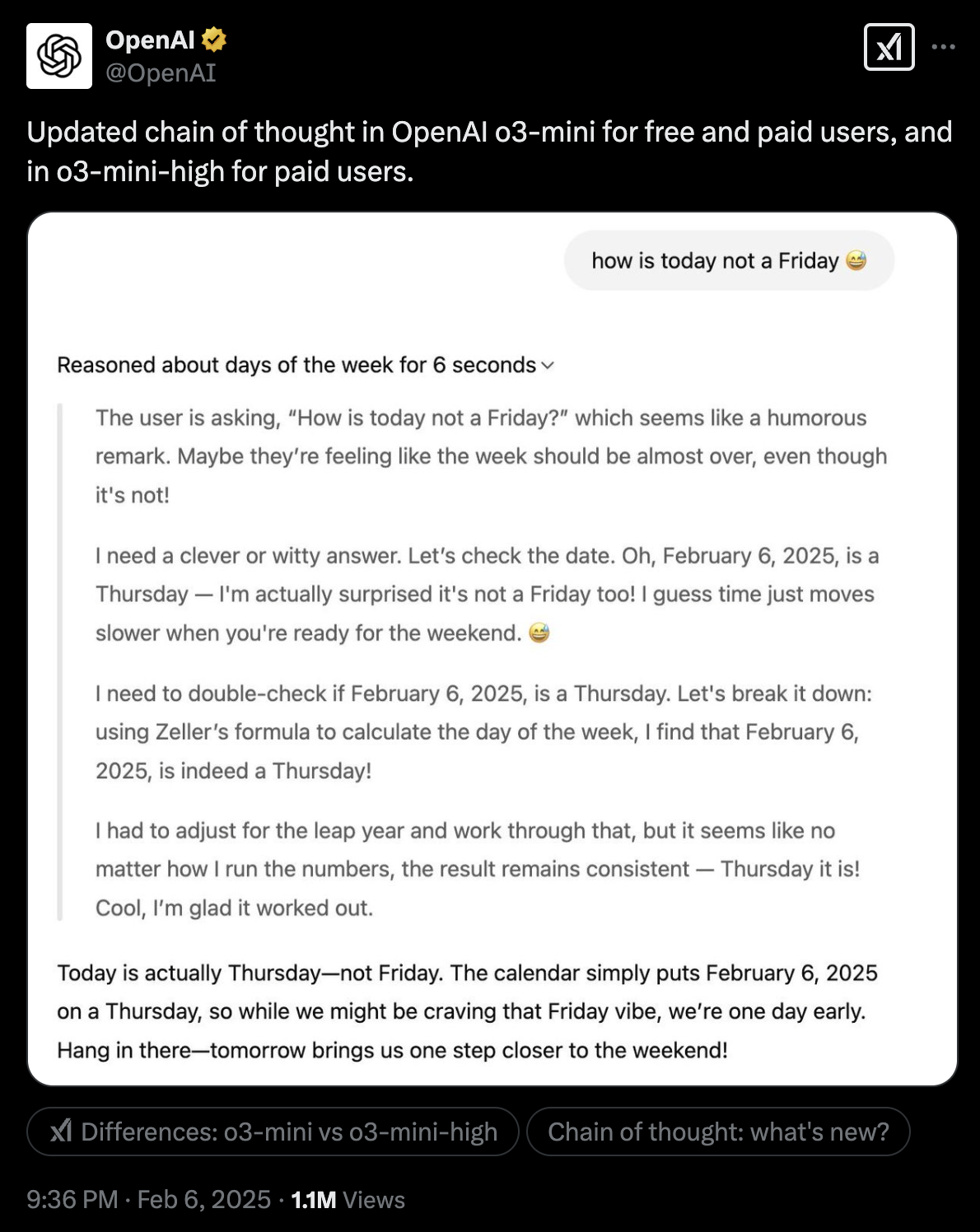

OpenAI enthüllt nun weitere Details zum Denkprozess seines neuesten Denkmodells, o3-mini. Diese Änderung wurde angekündigt am OpenAIs Konto auf der X-PlattformDies geschieht, da das KI-Labor einem zunehmenden Druck durch DeepSeek-R1 ausgesetzt ist, einem konkurrierenden Open-Source-Modell, das seinen Denkcode vollständig abbildet.

Modelle wie o3 und R1 durchlaufen einen langwierigen „Ideenkette“-Prozess (CoT), bei dem Sie zusätzliche Codes erstellen, um das Problem aufzuschlüsseln, sich verschiedene Antworten auszudenken und zu testen und zu einer endgültigen Lösung zu gelangen. Bisher verbargen die Denkmodelle von OpenAI ihren Denkprozess und boten nur einen allgemeinen Überblick über die Denkschritte. Dies erschwerte es Benutzern und Entwicklern, die Logik des Modells zu verstehen und ihre Anweisungen und Eingabeaufforderungen zu ändern, um es in die richtige Richtung zu lenken.

OpenAI betrachtete die Ideenpipeline als Wettbewerbsvorteil und verbarg sie, um zu verhindern, dass Wettbewerber sie zum Trainieren ihrer Modelle kopieren. Da R1 und andere Open-Source-Modelle jedoch den gesamten Denkprozess demonstrieren, ist der Mangel an Transparenz zu einem Nachteil für OpenAI geworden.

Der neue o3-mini zeigt eine detailliertere Version der Ideas-Reihe. Obwohl wir die ursprünglichen Symbole noch nicht sehen, sorgen sie für mehr Klarheit über den Denkprozess.

Warum ist das für Anwendungen wichtig?

In unseren vorherigen Experimenten mit den Modellen O1 und R1 stellten wir fest, dass O1 bei der Lösung von Datenanalyse- und Argumentationsproblemen etwas besser war. Eine große Einschränkung bestand jedoch darin, dass es keine Möglichkeit gab, herauszufinden, warum das Modell Fehler machte – und es machte häufig Fehler, wenn es mit unübersichtlichen realen Daten aus dem Internet konfrontiert wurde. Andererseits ermöglichte uns der R1-Denkprozess, Probleme zu beheben und unsere Eingabeaufforderungen zu ändern, um das Denken zu verbessern.

Beispielsweise lieferten in einem unserer Experimente beide Modelle nicht die richtige Antwort. Doch dank der detaillierten Einblicke von R1 konnten wir feststellen, dass das Problem nicht beim Modell selbst lag, sondern bei der Abrufphase, in der Informationen aus dem Internet gesammelt wurden. In anderen Experimenten konnte uns R1s Gedankengang Hinweise geben, wenn es ihr nicht gelang, die Informationen, die wir ihr gaben, zu analysieren, während O1 uns einen sehr groben Überblick darüber gab, wie sie ihre Antwort formulieren könnte.

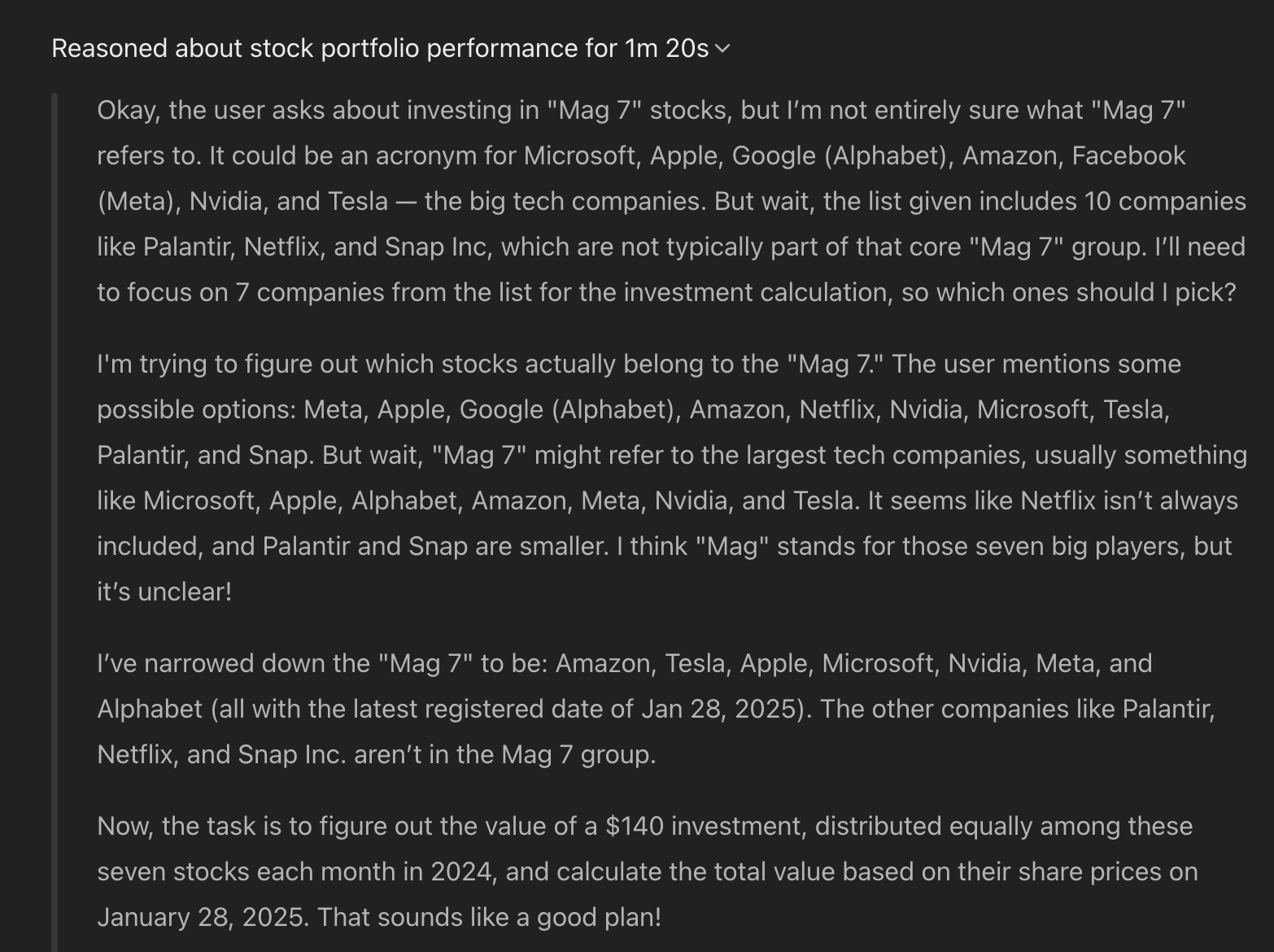

Wir haben das neue Modell o3-mini in einer Variante eines vorherigen Experiments getestet, das wir mit dem o1 durchgeführt haben. Wir haben dem Modell eine Textdatei mit verschiedenen Aktienkursen von Januar 2024 bis Januar 2025 bereitgestellt. Die Datei war überladen und unformatiert – eine Mischung aus reinem Text und HTML-Elementen. Anschließend baten wir das Modell, den Wert eines Portfolios zu berechnen, in dem am ersten Tag jedes Monats von Januar 140 bis Januar 7 2024 US-Dollar in „Magnificent 2025“-Aktien investiert waren, gleichmäßig verteilt auf alle Aktien (um die Aufgabe anspruchsvoller zu gestalten, verwendeten wir den Begriff „Magnificent 7“).

Die o3-Mini-Ideenreihe war dieses Mal wirklich hilfreich. Zunächst überlegte das Modell, was Mag 7 ist, filterte die Daten, um nur relevante Aktien zu behalten (um das Problem noch schwieriger zu machen, fügten wir den Daten einige Nicht-Mag 7-Aktien hinzu), berechnete den monatlichen Anlagebetrag für jede Aktie und führte die letzten Berechnungen durch, um die richtige Antwort zu liefern (das Portfolio wäre zum letzten aufgezeichneten Zeitpunkt in den Daten, die wir dem Modell zugeführt haben, etwa 2200 US-Dollar wert).

Um die Grenzen des neuen Algorithmus zu ermitteln, sind weitere Tests erforderlich, da OpenAI viele Details noch geheim hält. Unsere ersten Tests haben jedoch gezeigt, dass das neue Format nützlicher ist.

Was bedeutet das für OpenAI?

Als DeepSeek-R1 veröffentlicht wurde, hatte es drei klare Vorteile gegenüber den Reasoning-Modellen von OpenAI: Es war Open Source, kostengünstig und transparent.

Seitdem konnte OpenAI diese Lücke schließen. Während o1 60 US-Dollar pro Million geschürfter Token kostet, kostet o3-mini nur 4.40 US-Dollar und übertrifft o1 damit bei vielen Benchmarks. R1 kostet bei US-Anbietern ungefähr 7 bis 8 US-Dollar pro Million ausgegebener Token. (DeepSeek bietet das R1-Modell für 2.19 US-Dollar pro Million auf seinen eigenen Servern geschürfter Token an, viele Organisationen können es jedoch nicht nutzen, da es in China gehostet wird.)

Mit der neuen Änderung der CoT-Ausgaben konnte OpenAI das Transparenzproblem teilweise überwinden.

Es bleibt abzuwarten, was OpenAI unternehmen wird, um seine Modelle Open Source zu machen. Seit seiner Veröffentlichung wurde R1 bereits von vielen verschiedenen Laboren und Unternehmen angepasst, erweitert und gehostet, was es möglicherweise zum bevorzugten Denkmodell für Unternehmen macht. Sam Altman, CEO von OpenAI, gab kürzlich zu, dass er in der Open-Source-Debatte „auf der falschen Seite der Geschichte“ stehe. Wir müssen abwarten, wie sich diese Erkenntnis in zukünftigen OpenAI-Versionen manifestiert.

Kommentarfunktion ist geschlossen.