Studie: KI-Lärm behindert echte KI-Forschung

Eine neue Studie, die diesen Monat von der Association for the Advancement of Artificial Intelligence (AAAI) veröffentlicht wurde und an der Hunderte von KI-Forschern beteiligt waren, kommt zu einem wichtigen Ergebnis: Unser aktueller Ansatz zur KI wird uns wahrscheinlich nicht zu künstlicher allgemeiner Intelligenz führen.

Künstliche Intelligenz war in den letzten Jahren ein beliebtes Gesprächsthema, doch als wissenschaftliches Forschungsgebiet existiert KI bereits seit Jahrzehnten. Beispielsweise wurden Alan Turings berühmte Abhandlung „Computing Machinery and Intelligence“ und der Turing-Test, über den wir heute noch sprechen, im Jahr 1950 veröffentlicht.

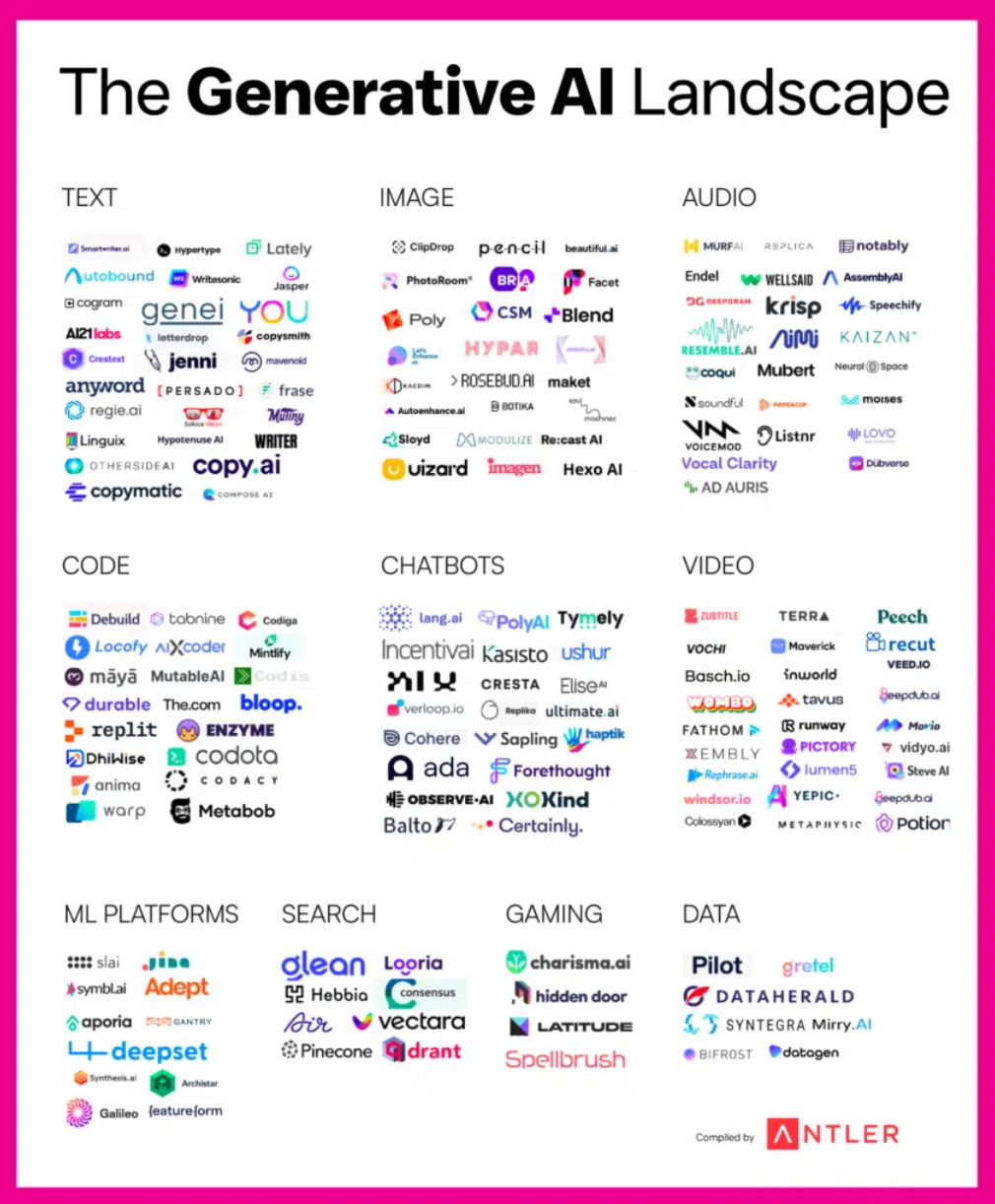

Die KI, über die heute alle reden, ist aus diesen Jahrzehnten der Forschung entstanden, entfernt sich aber auch davon. Anstatt sich auf wissenschaftliche Forschung zu beschränken, gibt es mittlerweile auch einen eigenen Zweig der KI, den wir „kommerzielle KI“ nennen können.

Große Monopole wie Microsoft, Google, Meta, Apple und Amazon sind führend bei kommerziellen KI-Bemühungen, deren Hauptziel die Entwicklung von KI-Produkten ist. Dies sollte kein Problem darstellen, aber im Moment sieht es so aus, als ob es eines sein könnte.

Erstens: Da die meisten Menschen die KI-Forschung erst seit ein paar Jahren verfolgen, stammt alles, was der Durchschnittsbürger über KI weiß, von diesen Unternehmen und nicht von der wissenschaftlichen Gemeinschaft. Die Studie umfasst Dieses Thema wird im Kapitel „Wahrnehmung vs. Realität“ behandelt. 79 % der teilnehmenden Wissenschaftler sind der Meinung, dass die aktuelle Wahrnehmung der KI-Fähigkeiten nicht mit der Realität der KI-Forschung und -Entwicklung übereinstimmt.

Mit anderen Worten: Was die Öffentlichkeit über KI denkt, entspricht nicht dem, was Wissenschaftler über KI denken. Der Grund dafür ist ebenso einfach wie bedauerlich: Wenn ein leitender Tech-Manager eine Aussage über KI macht, handelt es sich dabei nicht um eine wissenschaftliche Meinung, sondern um Produktmarketing. Sie möchten die Technologie hinter ihren neuen Produkten anpreisen und dafür sorgen, dass jeder das Bedürfnis verspürt, auf den Zug aufzuspringen.

Wenn er sagt Sam Altmann Oder Mark Zuckerberg Arbeitsplätze im Software-Engineering werden beispielsweise durch KI ersetzt, weil man Ingenieure dazu bewegen will, KI-Kenntnisse zu erlernen und Technologieunternehmen dazu bewegen will, in teure Unternehmenspläne zu investieren. Sofern sie jedoch nicht anfangen, ihre Ingenieure auszutauschen (und dies auch ausnutzen), würde ich persönlich kein Wort glauben, das sie zu diesem Thema sagen.

Allerdings beeinflusst kommerzielle KI nicht nur die öffentliche Wahrnehmung. Die Studienteilnehmer sind der Ansicht, dass der von großen Technologieunternehmen geschaffene „KI-Hype“ den Forschungsanstrengungen schadet. So stimmen beispielsweise 74 % der Befragten zu, dass die Richtung der KI-Forschung vom Hype bestimmt wird – wahrscheinlich, weil Forschung, die mit kommerziellen KI-Zielen im Einklang steht, leichter zu finanzieren ist. 12 % glauben zudem, dass die theoretische KI-Forschung darunter leidet.

Wie ernst ist dieses Problem? Auch wenn die großen Technologieunternehmen Einfluss auf unsere Forschung nehmen, dürften die vermutlich enormen Summen, die sie in dieses Feld stecken, insgesamt positive Auswirkungen haben. Allerdings ist Vielfalt in der Forschung entscheidend – wir müssen viele verschiedene Wege verfolgen, um den besten zu finden.

Doch die großen Technologieunternehmen konzentrieren sich derzeit nur auf eines: große Sprachmodelle. Dieser sehr spezifische Typ von KI-Modellen ist die Grundlage fast aller aktuellen KI-Produkte. Experten wie Sam Altman glauben, dass wir durch die zunehmende Skalierung dieser Modelle (d. h. durch mehr Daten, mehr Trainingszeit und mehr Rechenleistung) letztendlich eine allgemeine KI erreichen werden.

Diese als Skalenhypothese bekannte Idee besagt, dass die kognitiven Fähigkeiten einer KI umso größer und die Fehlerquote umso geringer sind, je mehr Leistung wir ihr zuführen. Einige Interpretationen besagen auch, dass unerwartet neue kognitive Fähigkeiten auftreten werden. Obwohl große Sprachmodelle derzeit nicht besonders gut darin sind, Probleme zu planen und zu begründen, müssen diese Fähigkeiten irgendwann entstehen.

es gibt keine Mauer

– Sam Altman (@sama) November 14, 2024

In den letzten Monaten wurde die Expansionshypothese jedoch heftig kritisiert. Einige Wissenschaftler glauben, dass die Skalierung großer Sprachmodelle niemals zu AGI führen wird, und sie glauben, dass all die zusätzliche Macht, die wir Neue Modelle Es führt nicht mehr zu Ergebnissen. Stattdessen sind wir an eine „Skalierungsgrenze“ oder „Skalierungsmauer“ gestoßen, wo große Mengen an Rechenleistung und zusätzliche Daten nur zu geringfügigen Verbesserungen bei neuen Modellen führen. Die meisten an der AAAI-Studie beteiligten Wissenschaftler vertreten diese Argumentationsseite:

Die Mehrheit der Befragten (76 %) gab an, dass eine „Ausweitung aktueller KI-Ansätze“ zur Erzielung einer AGI „unwahrscheinlich“ oder „sehr unwahrscheinlich“ sei. Dies deutet auf Zweifel hin, ob aktuelle Modelle des maschinellen Lernens ausreichen, um allgemeine Intelligenz zu erreichen.

Die heutigen großen Sprachsysteme können sehr relevante und nützliche Antworten liefern, wenn alles gut läuft, aber sie Basierend auf mathematischen Prinzipien Um dies zu tun. Viele Wissenschaftler sind davon überzeugt, dass wir neue Algorithmen benötigen, die auf der Grundlage von Logik, Vernunft und Faktenwissen zu einer Lösung gelangen, wenn wir dem Ziel einer künstlichen allgemeinen Intelligenz näher kommen wollen. Hier ist ein bissiges Zitat über große Sprachsysteme und allgemeine künstliche Intelligenz von Forschungsbericht 2022 Von Jacob Browning und Yann LeCun.

Ein System, das ausschließlich auf Sprache trainiert ist, wird niemals an die menschliche Intelligenz herankommen, selbst wenn es von jetzt an bis zum Erlöschen der Hitze des Universums trainiert würde.

Es gibt jedoch noch keine Möglichkeit herauszufinden, wer hier Recht hat. Einerseits ist die Definition allgemeiner künstlicher Intelligenz nicht festgelegt und nicht alle streben dasselbe an. Manche Menschen glauben, dass eine allgemeine künstliche Intelligenz menschenähnliche Reaktionen mit menschenähnlichen Methoden produzieren sollte – sie sollte also die Welt um sich herum beobachten und Probleme auf ähnliche Weise wie wir lösen. Andere wiederum sind der Ansicht, dass sich die allgemeine KI eher auf richtige Antworten als auf menschenähnliche Reaktionen konzentrieren sollte und dass die verwendeten Methoden keine Rolle spielen sollten.

Allerdings spielt es in vielerlei Hinsicht keine Rolle, für welche Version der AGI Sie sich interessieren oder ob Sie für oder gegen die Skalierungshypothese sind – wir müssen unsere Forschungsanstrengungen dennoch diversifizieren. Wenn wir uns nur auf die Skalierung großer Sprachmodelle konzentrieren, müssen wir bei Null anfangen, wenn sie nicht funktionieren, und es gelingt uns möglicherweise nicht, neue, effektivere oder effizientere Methoden zu entdecken. Viele der an dieser Studie beteiligten Wissenschaftler befürchten, dass kommerzielle KI und der damit verbundene Hype den tatsächlichen Fortschritt verlangsamen werden. Wir können jedoch nur hoffen, dass ihre Bedenken berücksichtigt werden und dass beide Zweige der KI-Forschung koexistieren und gemeinsam Fortschritte machen können. Nun, man kann auch hoffen, dass KI-Blase Alle KI-gestützten technischen Produkte explodieren und verschwinden, wenn Sie so wollen, in der Versenkung.

Kommentarfunktion ist geschlossen.