KI-Modelle: enorme Fähigkeiten, aber in der Videospielbranche unzureichend

Da sich KI-Tools ständig weiterentwickeln, werden wir ständig dazu ermutigt, komplexe Aufgaben an sie zu delegieren. Große Sprachmodelle könnenLLMs) Unsere E-Mails schreiben, Präsentationen erstellen, Anwendungen gestalten, Videos erstellen, im Internet recherchieren und Ergebnisse zusammenfassen und vieles mehr. Eine Sache fällt mir allerdings immer noch sehr schwer: Videospiele.

In diesem Jahr haben bisher zwei der größten KI-Unternehmen (Microsoft und Anthropic) versucht, mit ihren Modellen Spiele zu erstellen oder zu spielen. Die Ergebnisse sind wahrscheinlich viel begrenzter als viele Leute erwarten. Dies unterstreicht die aktuellen Herausforderungen im Bereich der generativen KI, insbesondere bei Aufgaben, die eine langfristige strategische Planung und komplexe Entscheidungsfindung erfordern.

Damit sind sie perfekte Beispiele dafür, was generative KI heute wirklich kann – kurz gesagt: Sie kann viel mehr als früher, aber sie kann nicht alles. Dies spiegelt wider, dass sich die generative KI noch in der Entwicklungsphase befindet und dass sie trotz ihrer zunehmenden Fähigkeiten in einigen Bereichen noch immer mit Einschränkungen konfrontiert ist.

Microsoft produziert Quake II mit künstlicher Intelligenz

Die Produktion von Videospielen steht vor ähnlichen Herausforderungen wie die Videoproduktion, wo die Bewegungen seltsam und verzerrt sind und die künstliche Intelligenz nach einer gewissen Zeit den Bezug zur „Realität“ verliert. Der jüngste Versuch von Microsoft, der Jeder kann es versuchen.Es handelt sich um eine KI-generierte Version von Quake II.

Ich habe das Spiel mehrere Male gespielt und es ist eine wirklich seltsame Erfahrung, mit verwirrenden Feinden, die aus dem Nichts auftauchen, und der Umgebung, die sich um Sie herum verändert, während Sie sich bewegen. Wenn ich einen neuen Raum betrat, verschwand oft der Türrahmen, sobald ich mich umdrehte, und wenn ich wieder nach vorne blickte, hatten sich die Wände bewegt.

Das Erlebnis dauert nur ein paar Minuten, bevor es stoppt und Sie auffordert, ein neues Spiel zu starten. Wenn Sie Pech haben, kann es jedoch sein, dass es schon vorher nicht mehr richtig auf Ihre Eingaben reagiert.

Es ist jedoch eine großartige Erfahrung und ich denke, es wäre von Vorteil, wenn mehr Leute es sehen würden. Sie können selbst erfahren, was generative KI kann und wo die aktuellen Grenzen liegen. Obwohl es beeindruckend ist, dass wir überhaupt in der Lage waren, ein interaktives Videospielerlebnis zu schaffen, ist es schwer vorstellbar, dass irgendjemand diese Technologiedemo spielen und gleichzeitig glauben könnte, dass das nächste Assassin's Creed von KI produziert wird.

Dennoch gibt es derartige Vorstellungen und Annahmen vor allem deshalb, weil die Menschen derzeit ständig von KI hören. Auch wenn Sie sich überhaupt nicht für KI interessieren, wird sie Ihnen dennoch überall aufgezwungen. Das Problem besteht darin, dass die Informationen, die der Durchschnittsbürger erhält, fast ausschließlich aus Marketingkommentaren großer Technologieunternehmen und von Nachrichtenpublikationen aufgegriffenen Kommentaren von Führungskräften bestehen.

Das bedeutet, dass sie übertriebene und widersprüchliche Behauptungen wie diese hören:

Sie hat das Potenzial, einige der größten Probleme der Welt zu lösen, etwa Klimawandel, Armut und Krankheiten. (Bill Gates)

Es ist wahrscheinlich, dass wir bei Meta im Jahr 2025 zusammen mit anderen Unternehmen, die hauptsächlich daran arbeiten, über eine KI verfügen werden, die als Ingenieur der mittleren Ebene in Ihrem Unternehmen fungieren und effizient Code schreiben kann. (Mark Zuckerberg)

Die effektive Nutzung von KI ist mittlerweile eine grundlegende Erwartung an alle bei Shopify. Es ist heute ein Werkzeug für alle Berufe und wird mit der Zeit immer wichtiger werden. Ehrlich gesagt glaube ich nicht, dass man umhin kommt, sich die Anwendung von KI im eigenen Unternehmen anzueignen. (Toby Lütke, CEO von Shopify)

Wir sind jetzt zuversichtlich, dass wir wissen, wie man künstliche allgemeine Intelligenz (AGI) in unserem traditionellen Verständnis aufbaut. Wir glauben, dass wir im Jahr 2025 die ersten KI-Agenten erleben werden, die „in die Belegschaft eintreten“ und die Produktionsweise von Unternehmen grundlegend verändern werden. (Sam Altman, CEO von OpenAI)

Künstliche Intelligenz ist gefährlicher als etwa eine schlecht geführte Flugzeugkonstruktion, eine mangelhafte Produktionswartung oder eine schlampige Autoproduktion, denn sie hat das Potenzial – wenn auch nur ein kleines, aber nicht unbedeutendes – die Zivilisation zu zerstören. (Elon Musk)

Das klingt alles ein bisschen viel, nicht wahr? Es soll uns gleichzeitig retten und zerstören, es soll sowohl ein Werkzeug für Profis als auch ein Werkzeug sein, das sie ersetzt – und es sieht so aus, als ob wir schon dieses Jahr eine künstliche Intelligenz auf Science-Fiction-Niveau bekommen könnten. Wenn die Leute das alles hören, erwarten sie erstaunliche Dinge von diesen Geräten und glauben, dass alle Büroangestellten ihre Tage damit verbringen, wie Star Trek-Figuren mit ihren Computern zu reden.

Die Realität sieht jedoch anders aus. Die Realität sieht aus wie Quake II, verwackelt und verschwommen mit unverständlichen Feindumrissen. LLM-Modelle auf ChatGPT-Ebene waren bereits im Jahr 2022 ein aufregender Durchbruch und machten allen viel Spaß, damit herumzuspielen – aber für die Mehrzahl der Anwendungen, die uns die großen Technologieunternehmen jetzt aufdrängen, ist KI einfach nicht leistungsfähig genug. Die Genauigkeit ist sehr gering, die Fähigkeit, Anweisungen zu befolgen, sehr gering, die Kontextbereiche sind sehr klein und sie werden nur mit Internet-Kauderwelsch und nicht mit Wissen aus der realen Welt geschult.

Doch die Entwicklung eines Videospiels ist ein äußerst komplexes Unterfangen – schließlich brauchen ganze Teams Jahre, um diese Dinge zu entwickeln. Wie wäre es stattdessen mit Videospielen?

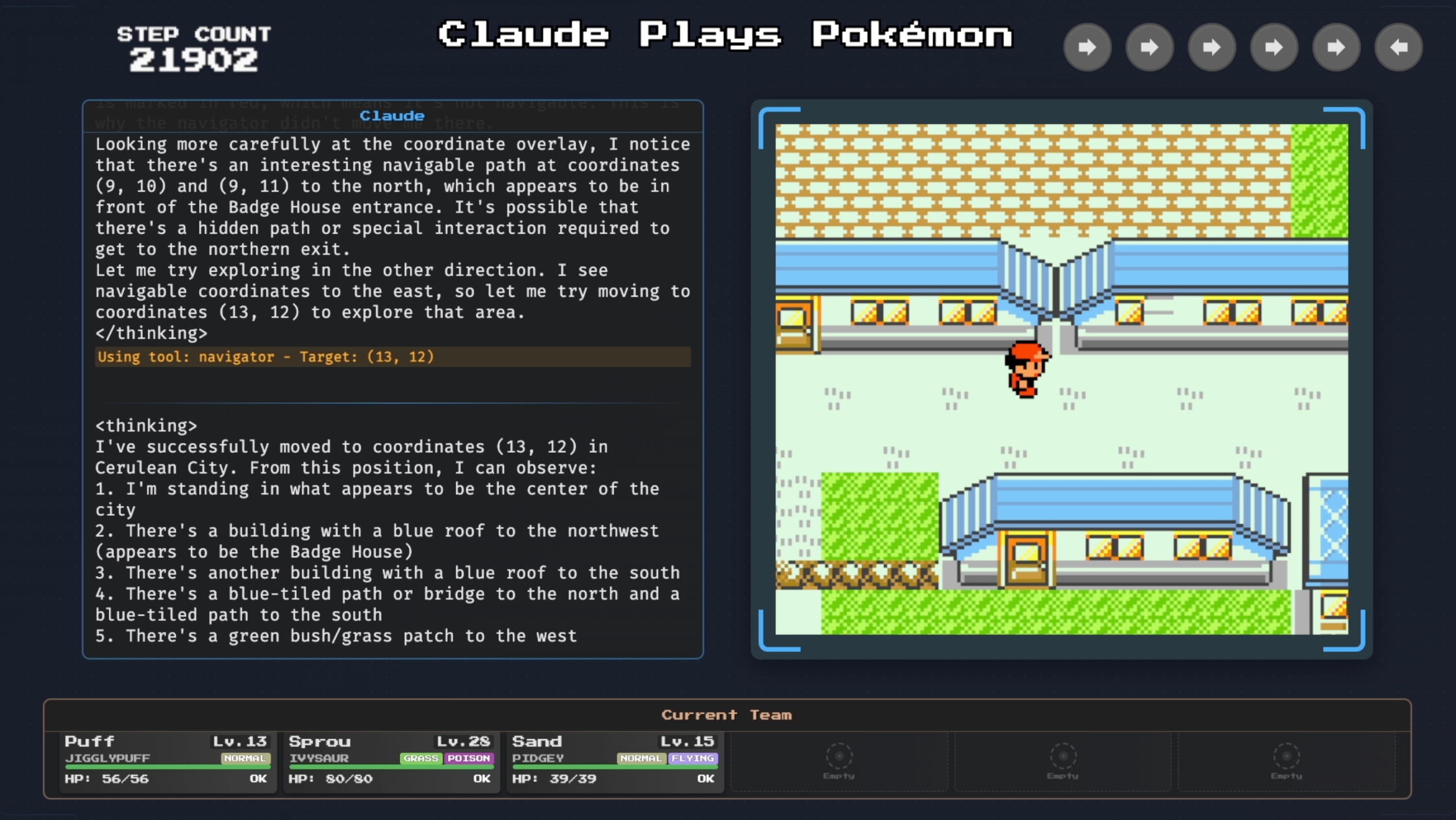

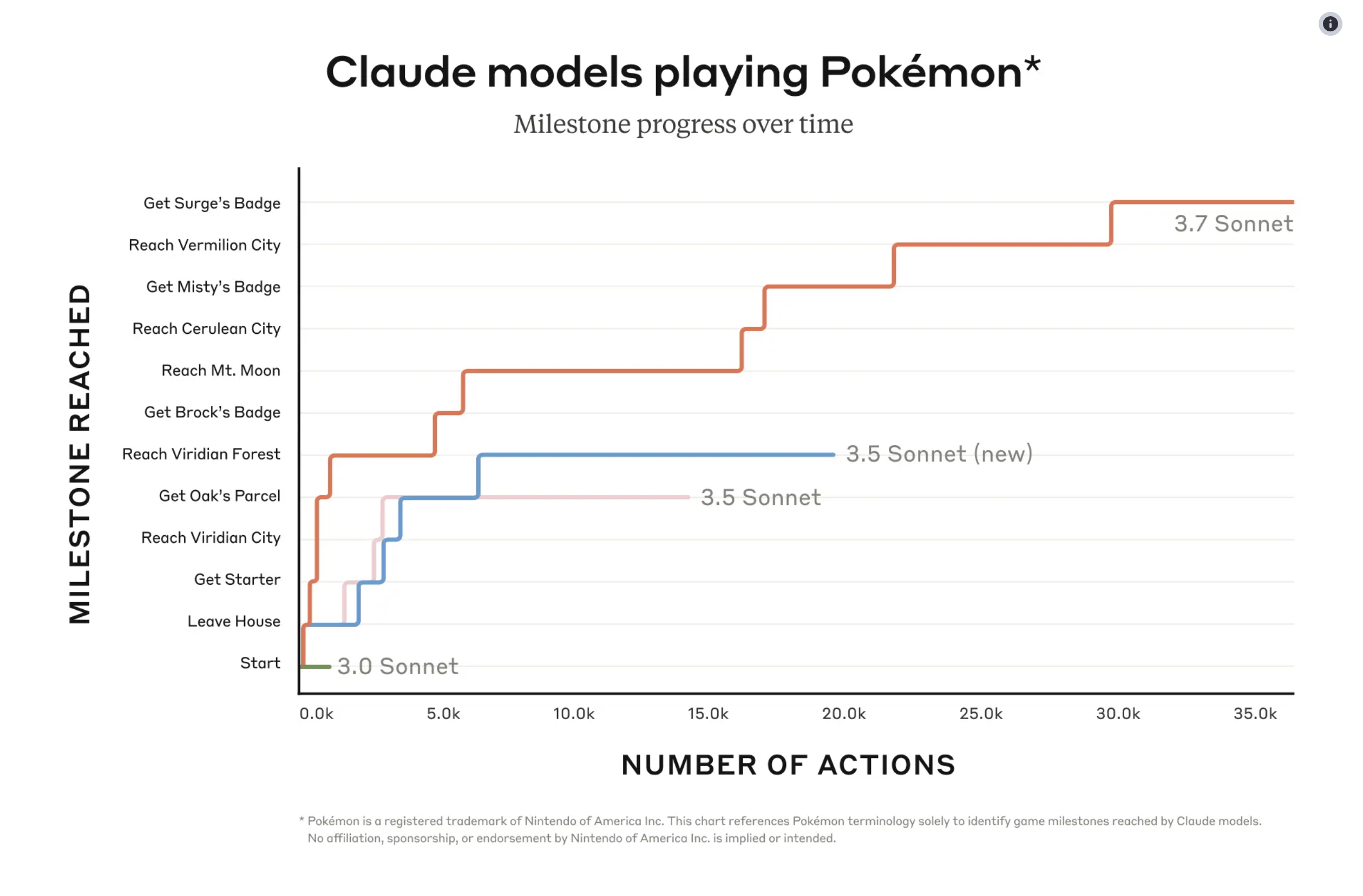

Claude „spielt“ Pokémon Rote

Nun, es stellt sich heraus, dass die Leute auch auf diesem Gebiet experimentieren. Das neuste Modell von Anthropic, das Claude 3.7 Sonett , Er spielt Pokémon Rote Edition auf Twitch Es existiert jetzt seit etwa zwei Monaten und es leistet beim Spielen von Pokémon die beste Arbeit, die ein großes Sprachmodell (LLM) jemals geleistet hat. Allerdings gibt es einen kleinen Vorbehalt: Er liegt noch immer meilenweit hinter dem Durchschnittsniveau eines 10-jährigen Menschenkindes zurück.

Ein Problem ist die Geschwindigkeit – Claude führt über mehrere Tage hinweg Tausende von Aktionen aus, um beispielsweise den Vertania-Wald zu durchqueren. Dies spiegelt die Herausforderungen der KI bei der Bewältigung komplexer Aufgaben wider.

Warum dauert es so lange? Es ist nicht so, dass er nicht wüsste, wie man Pokémon-Kämpfe strategisch gewinnt – das ist tatsächlich der Teil, in dem er gut ist. Das Navigieren durch die Umgebung und das Vermeiden von Bäumen und Gebäuden hingegen ist nicht so gut. Claude hat nie gelernt, Pokémon zu spielen, und es fällt ihm nicht leicht, Pixelkunst und ihre Darstellung zu verstehen. Diese Schwierigkeiten verdeutlichen die Kluft zwischen der Fähigkeit zur Datenverarbeitung und der Fähigkeit zur Interaktion mit komplexen Umgebungen.

Besonders schwierig ist es für ihn, labyrinthartige Gebiete wie den Mondberg zu durchqueren, da er Schwierigkeiten hat, eine Karte der Gegend zu erstellen und zu vermeiden, dass er zurückverfolgt wird. Einmal blieb er so in einer Ecke stecken, dass er zu dem Schluss kam, das Spiel sei kaputt, und eine offizielle Anfrage zum Zurücksetzen des Spiels stellte. Dies verdeutlicht, dass der KI trotz ihrer fortgeschrittenen Fähigkeiten immer noch das intuitive Verständnis fehlt, das der Mensch besitzt.

Auch diese frühen Versuche waren nicht ohne lustige Momente.

Einmal steckte Claude in einer Ecke fest und war davon überzeugt, dass etwas nicht stimmte. Er schrieb eine formelle Anfrage zum Zurücksetzen des Spiels. pic.twitter.com/5RIiCJdxCM— Anthropisch (@AnthropicAI) 25. Februar 2025

Außerdem kann er sich nicht gut an seine Ziele, Dinge, die er bereits ausprobiert hat, oder Orte, die er zuvor besucht hat, erinnern.

Dafür gibt es einen ganz einfachen Grund: Große Sprachmodelle (LLMs) haben ein begrenztes „Kontextfenster“, das als ihr Gedächtnis fungiert. Sie können nur eine bestimmte Menge an Informationen speichern, und sobald Claude dieses Limit erreicht, komprimiert er die vorhandenen Daten, um Platz für mehr zu schaffen. So kann eine Information wie „Viridian City besucht, jedes Gebäude betreten und mit jedem NPC gesprochen“ auf „Viridian City besucht“ komprimiert werden – was Claude dazu veranlasst, zurückzugehen und zu prüfen, ob es in der Stadt etwas Plus zu tun gibt.

Kurz gesagt: Claude weiß nicht, wohin er geht, läuft gegen Wände, wird durch zufällige Objekte und NPCs verwirrt, vergisst, wo er war und was er zu tun versucht, und jede Entscheidung, die er trifft, erfordert unzählige Absätze des Nachdenkens. Dies ist keine Kritik – es handelt sich um spannende Experimente, die große Sprachmodelle (LLMs) an die Grenzen des Möglichen bringen.

Doch bei all dem Hype um KI ist es wichtig, dass die Leute Demos wie diese sehen und sich ihre eigene Meinung über KI bilden. Manche Leute versuchen, uns die Vorstellung zu verkaufen, dass wir kurz vor dem Erreichen des Gipfels der Intelligenz stünden – dass künstliche Intelligenz (KI) innerhalb weniger Jahre sogar die intelligentesten Menschen übertreffen werde –, aber ich glaube nicht, dass sie die Wahrheit sagen, sondern nur Verkäufer. Wir sind noch lange nicht am Höhepunkt, das Ganze fängt gerade erst an.

Kommentarfunktion ist geschlossen.