Telefongeheimnisse, die KI-Enthusiasten brauchen: Gemini und ChatGPT optimal nutzen

Einer der auffälligsten – und ehrlich gesagt langweiligsten – Trends in der Smartphone-Branche der letzten zwei Jahre war das ständige Gerede über KI-Erlebnisse. Insbesondere Siliziumunternehmen rühmen sich oft damit, dass ihre neuesten Mobilprozessoren KI-Operationen auf dem Gerät ermöglichen, etwa die Videoerstellung.

Wir sind schon da, wenn auch noch nicht ganz. Bei all dem Hype um KI-Tricks, die bei Smartphone-Benutzern mal gut und mal schlecht ankommen, geht die Diskussion selten über auffällige Präsentationen neuer Prozessoren und sich ständig weiterentwickelnder Chatbots hinaus.

Erst als das Fehlen von Gemini Nano im Google Pixel 8 für Aufsehen sorgte, wurde der Öffentlichkeit klar, wie entscheidend die RAM-Kapazität für KI auf Mobilgeräten ist. Apple stellte außerdem schnell klar, dass Apple Intelligence auf Geräte mit mindestens 8 GB RAM beschränkt bleiben würde. Diese Entscheidung spiegelt die Bedeutung des RAM für die effiziente Ausführung von KI-Modellen wider.

Doch beim Image eines „KI-Telefons“ geht es nicht nur um die Speicherkapazität. Wie gut Ihr Telefon KI-gestützte Aufgaben ausführt, hängt auch von unsichtbaren RAM-Optimierungen und dem Speicher ab. Und nein, ich spreche nicht nur über Kapazität.

KI-Telefone erhalten Speicherinnovationen.

Digital Trends hat sich mit Micron, einem weltweit führenden Anbieter von Speicher- und Speicherlösungen, zusammengesetzt, um die Rolle von RAM und Speicher bei KI-Operationen auf Smartphones zu analysieren. Wenn Sie das nächste Mal ein Premium-Telefon kaufen, sollten Sie die Fortschritte von Micron auf dem Schirm haben.

Zu den neuesten Produkten des in Idaho ansässigen Unternehmens gehören mobiler G9 NAND-UFS 4.1-Speicher und 1γ (1-Gamma) LPDDR5X-RAM-Module für Flaggschiff-Smartphones. Wie also fördern diese Speicherlösungen die KI auf Smartphones, abgesehen von der Kapazitätssteigerung?

Beginnen wir mit der NAND UFS 9-Speicherlösung des G4.1. Das Hauptversprechen ist ein sparsamer Stromverbrauch, reduzierte Latenz und eine hohe Bandbreite.. Der UFS 4.1-Standard kann sequentielle Lese- und Schreibgeschwindigkeiten von bis zu 4100 MB/s erreichen, eine Steigerung von 15 % gegenüber der UFS 4.0-Generation, bei gleichzeitiger Reduzierung der Latenzwerte.

Ein weiterer entscheidender Vorteil besteht darin, dass die tragbaren Speichereinheiten der nächsten Generation von Micron mit Kapazitäten von bis zu 2 TB erhältlich sind. Darüber hinaus ist es Micron gelungen, die Größe zu reduzieren, was es zu einer idealen Lösung für faltbare Telefone und schlanke Telefone der nächsten Generation macht, wie Samsung Galaxy Rand S25.

Im Bereich RAM-Weiterentwicklungen hat Micron sogenannte 1γ LPDDR5X RAM-Module entwickelt. Es bietet eine Höchstgeschwindigkeit von 9200 MT/s, kann aufgrund der geringeren Größe 30 % mehr Transistoren unterbringen und verbraucht gleichzeitig 20 % weniger Strom. Micron hat bereits die etwas langsamere 1β-RAM-Lösung (1-Beta) vorgestellt, die in der Smartphone-Serie Samsung Galaxy S25 zu finden ist.

Die Interaktion zwischen Speicher und künstlicher Intelligenz

Ben Rivera, Produktmarketingleiter der Mobile Business Unit von Micron, erklärte, dass Micron vier wichtige Verbesserungen an seinen neuesten Speicherlösungen vorgenommen habe, um schnellere KI-Operationen auf Mobilgeräten zu gewährleisten. Zu diesen Verbesserungen gehören Zoned UFS, Datendefragmentierung, Pinned WriteBooster und Intelligent Latency Tracker.

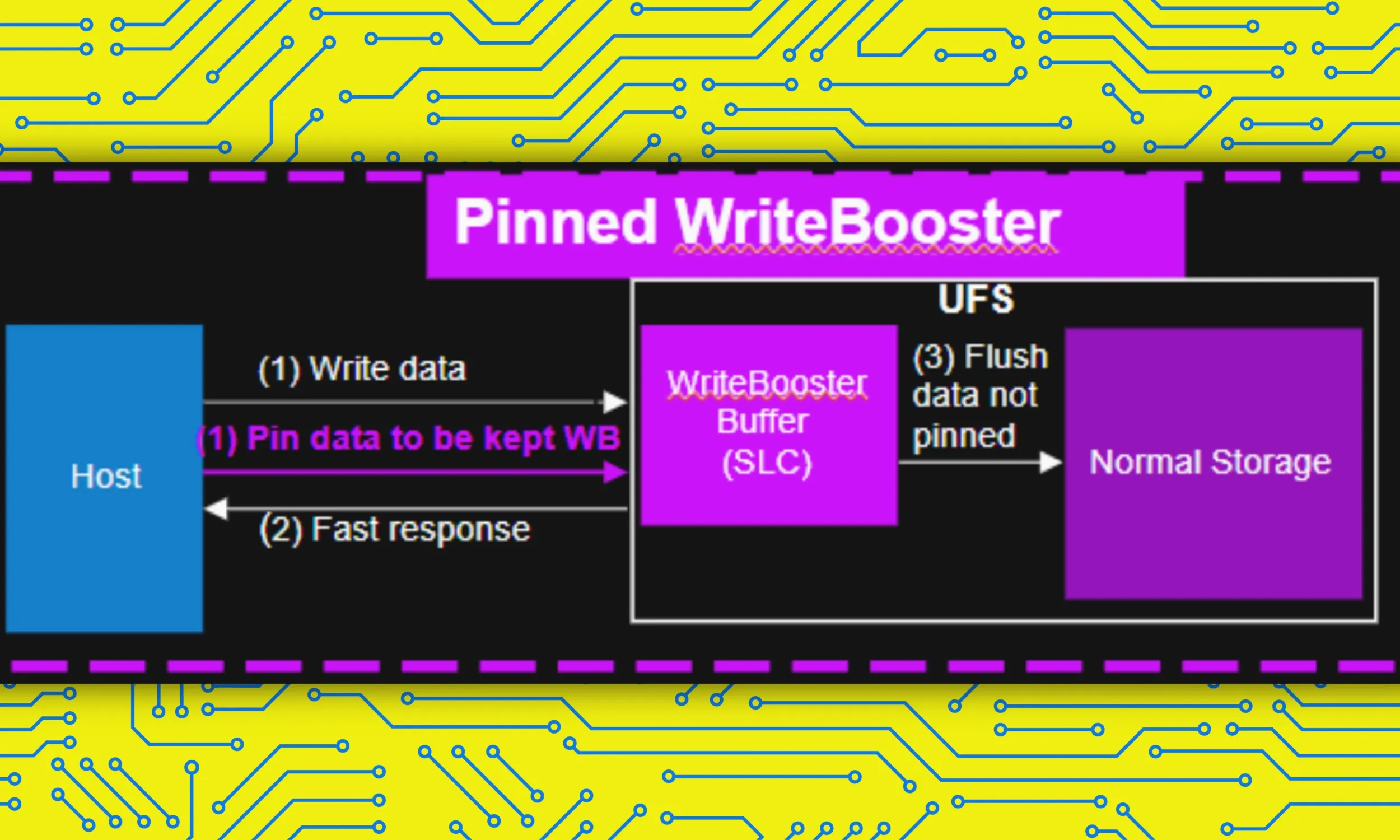

„Diese Funktion ermöglicht es dem Prozessor oder Host, die am häufigsten verwendeten Daten im Smartphone zu identifizieren und zu isolieren oder in einem Bereich des Speichergeräts namens WriteBooster-Puffer (ähnlich einem Cache) zu ‚pinn‘, um einen schnellen und sofortigen Zugriff darauf zu ermöglichen“, erklärt Rivera die Funktion Pinned WriteBooster.

Jedes KI-Modell – wie Google Gemini oder ChatGPT –, das Aufgaben auf einem Gerät ausführen möchte, benötigt einen eigenen Satz von Anweisungsdateien, die lokal auf dem Mobilgerät gespeichert sind. Sie benötigen beispielsweise Apple Intelligence bis zu 7 GB Speicherplatz Für alle seine Operationen.

Um eine Aufgabe auszuführen, können Sie nicht den gesamten KI-Stack an den RAM delegieren, da dieser Platz für die Verarbeitung anderer wichtiger Aufgaben benötigt, z. B. das Tätigen von Anrufen oder die Interaktion mit anderen wichtigen Anwendungen. Um die Einschränkungen des Micron-Speichers zu beheben, wird eine Speicherzuordnung erstellt, die nur die erforderlichen KI-Gewichte aus dem Speicher in den RAM lädt.

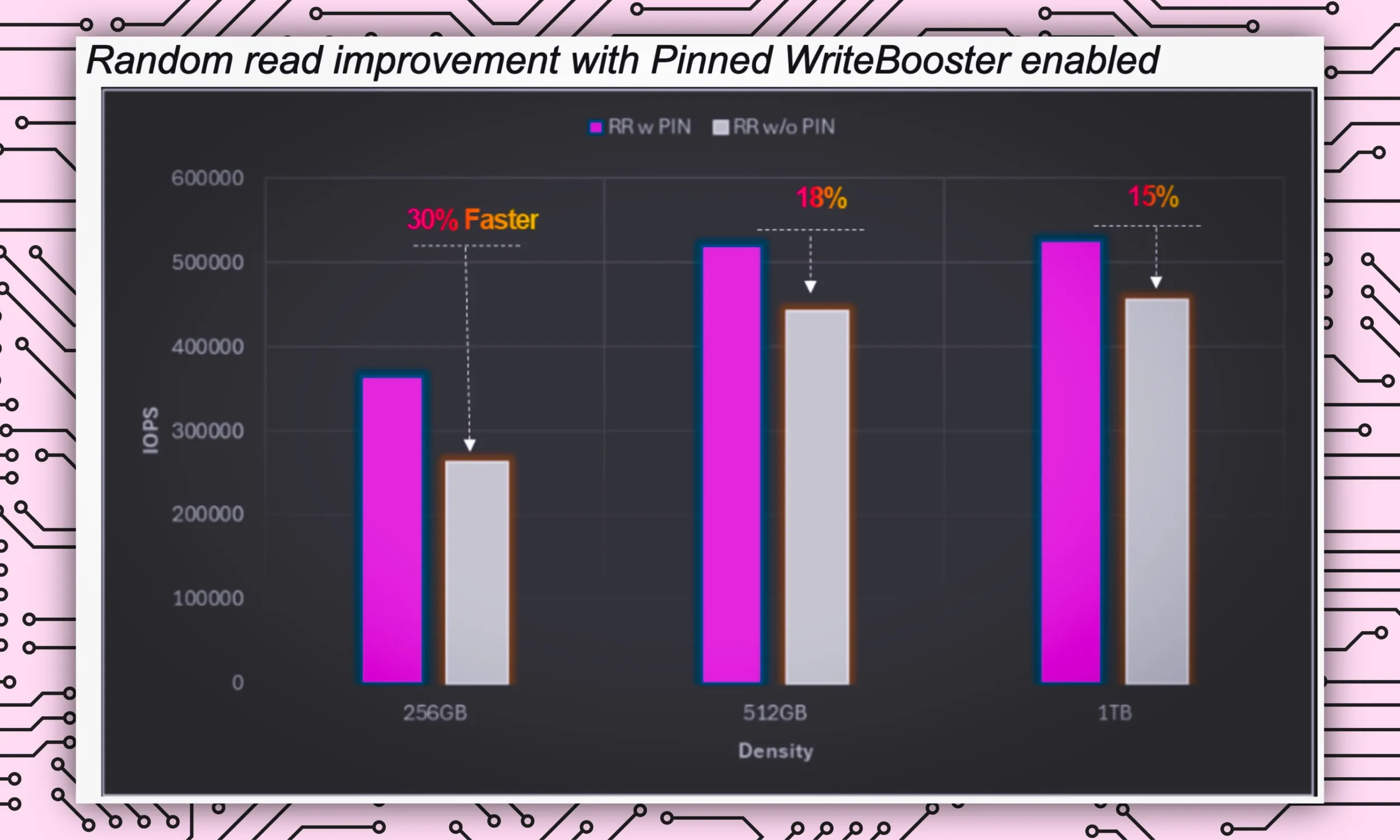

Wenn die Ressourcen begrenzt sind, benötigen Sie schnelleres Datenaustauschen und -lesen. Dadurch wird sichergestellt, dass Ihre KI-Aufgaben ausgeführt werden, ohne die Geschwindigkeit anderer wichtiger Aufgaben zu beeinträchtigen. Dank Pinned WriteBooster wird dieser Datenaustausch um 30 % beschleunigt und sorgt so dafür, dass KI-Aufgaben ohne Verzögerung verarbeitet werden.

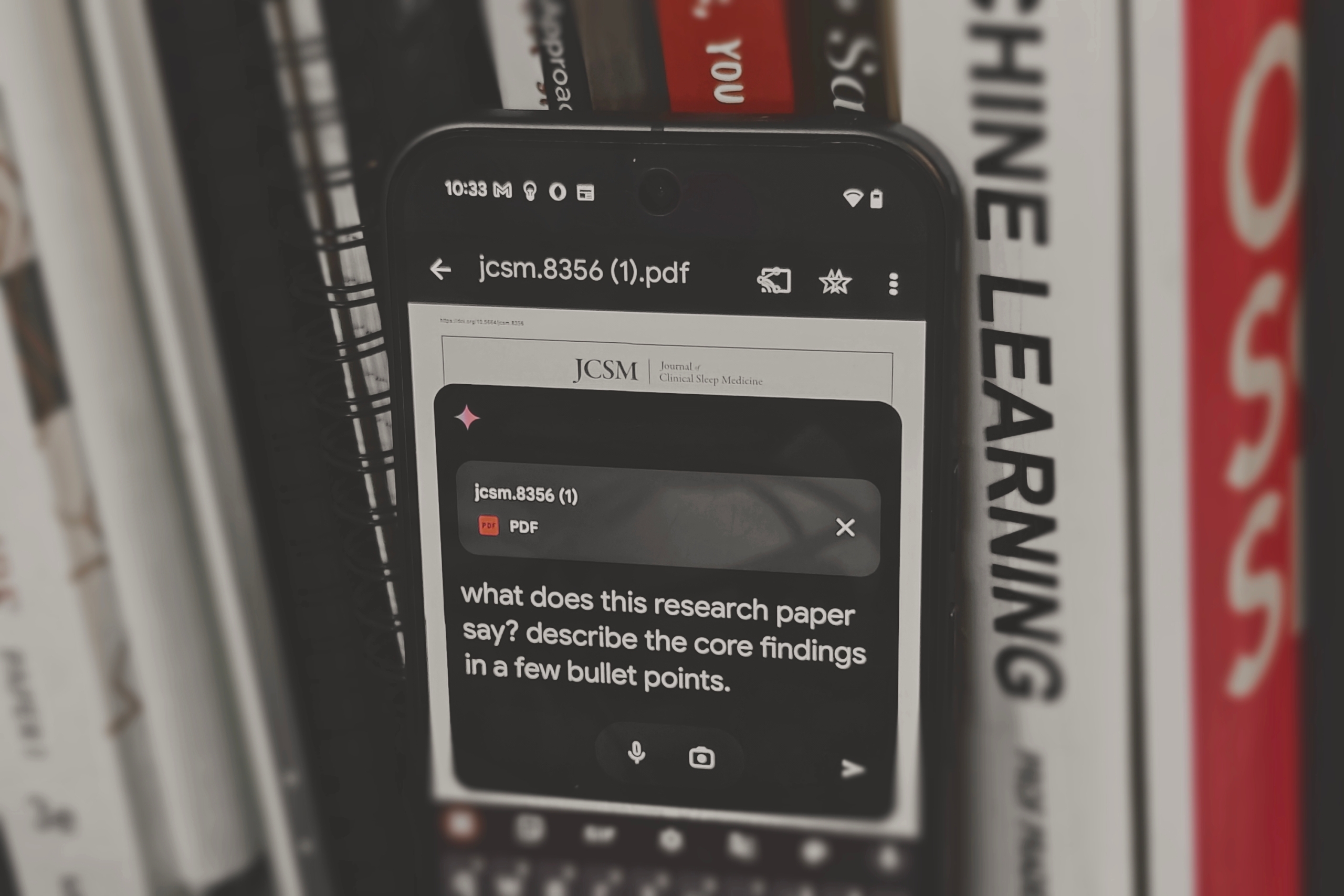

Angenommen, Sie müssen Gemini zum Extrahieren von PDF-Dateien zur Analyse. Durch schnelles Speicheraustauschen wird sichergestellt, dass erforderliche KI-Gewichte schnell vom Speicher in den RAM übertragen werden.

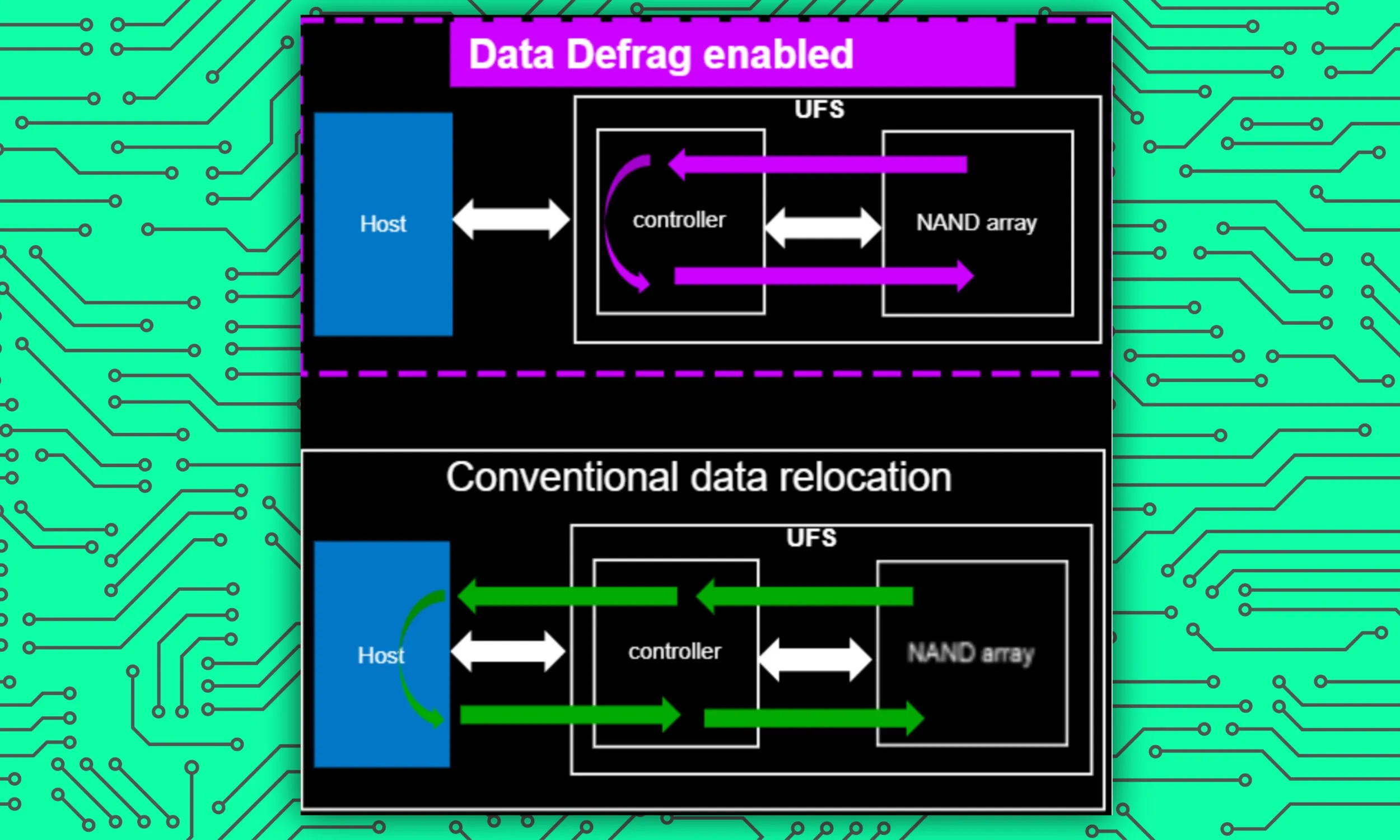

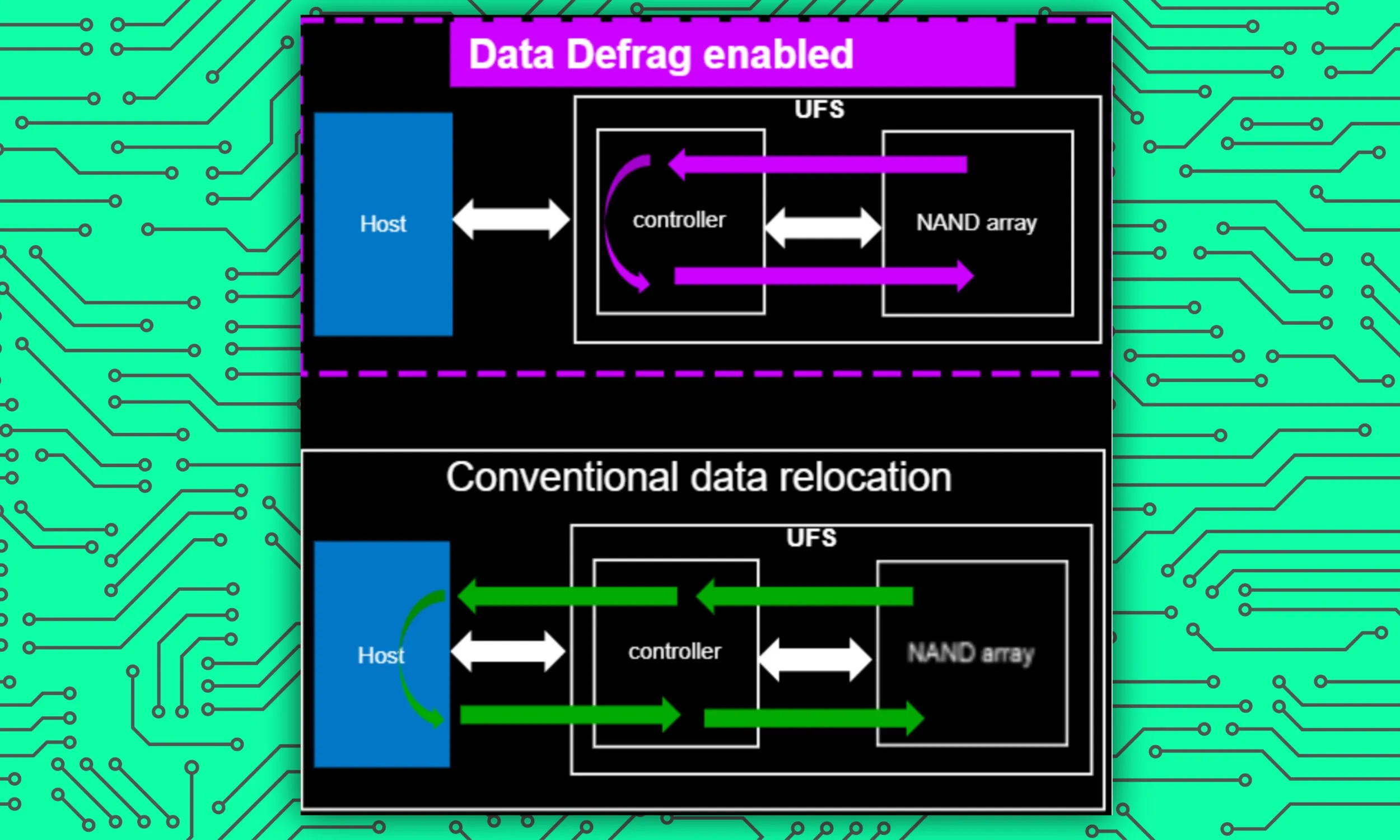

Als nächstes haben wir Data Defrag. Stellen Sie es sich als einen Schreibtisch- oder Schrank-Organizer vor, der dafür sorgt, dass Gegenstände ordentlich nach verschiedenen Kategorien gruppiert und in ihren jeweiligen Schränken platziert werden, sodass sie leicht zu finden sind.

Bei Smartphones werden zwar über einen langen Nutzungszeitraum hinweg große Datenmengen gespeichert, diese werden jedoch in der Regel eher zufällig gespeichert. Dies führt dazu, dass das integrierte System, wenn es auf einen bestimmten Dateityp zugreifen muss, schwieriger wird, alle Dateien zu finden, was zu einer Verlangsamung führt.

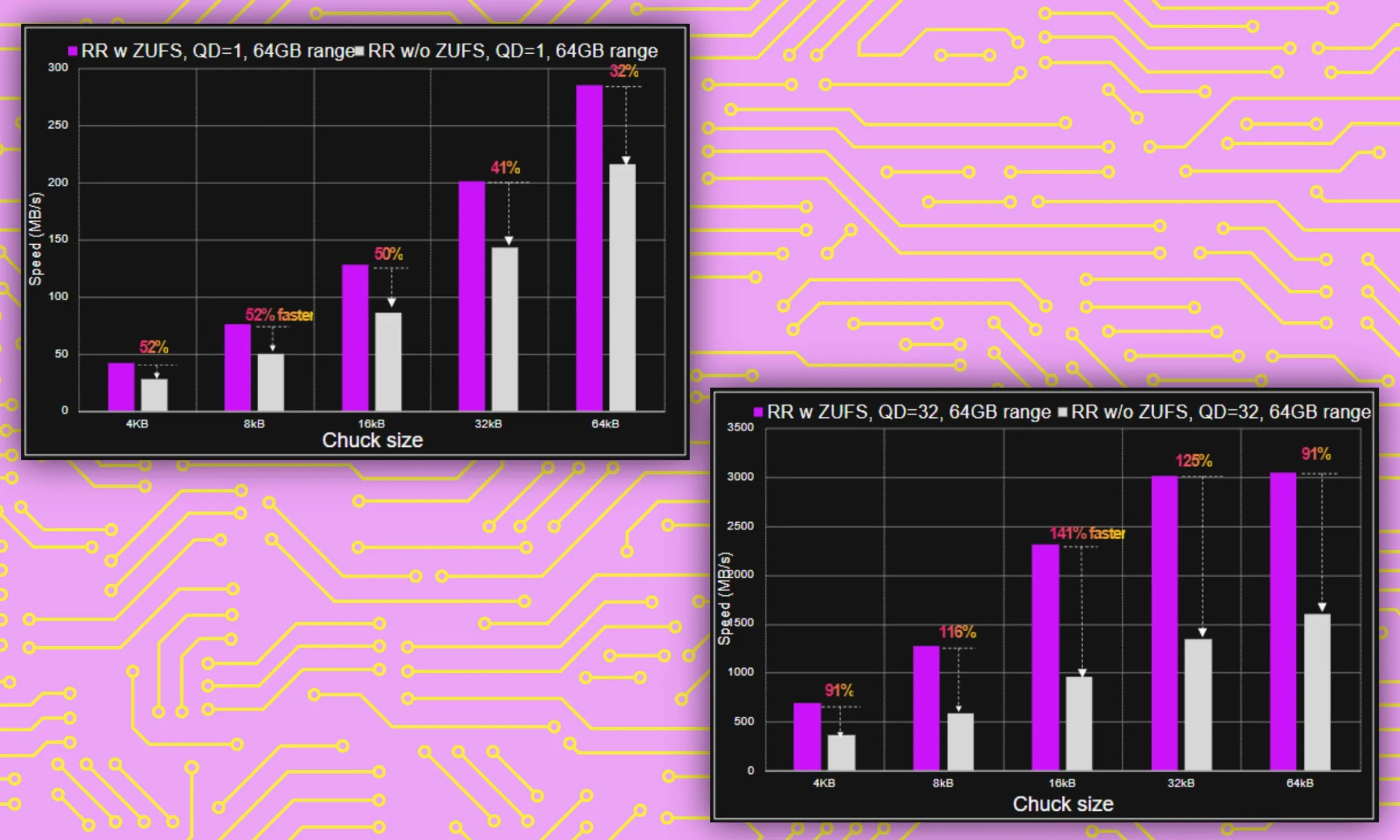

Laut Rivera hilft Data Defrag nicht nur bei der organisierten Datenspeicherung, sondern ändert auch die Art und Weise, wie das Speichergerät mit dem Controller des Geräts interagiert. Somit ist es Erhöht die Datenlesegeschwindigkeit um erstaunliche 60 %, wodurch alle Arten von Benutzer-Gerät-Interaktionen, einschließlich KI-Aufgaben, auf natürliche Weise beschleunigt werden.

„Diese Funktion kann dazu beitragen, KI-Funktionen zu beschleunigen, etwa wenn ein generatives KI-Modell, etwa eines, das zum Generieren eines Bilds aus einer Textaufforderung verwendet wird, vom Speicher in den Arbeitsspeicher abgerufen wird, wodurch Daten schneller vom Speicher in den Arbeitsspeicher gelesen werden können“, sagte ein Micron-Mitarbeiter gegenüber Digital Trends.

Intelligence Latency Tracker ist eine weitere Funktion, die grundsätzlich Latenzereignisse und Faktoren überwacht, die die normale Geschwindigkeit Ihres Telefons verlangsamen könnten. Es hilft später dabei, Fehler zu korrigieren und die Leistung des Telefons zu verbessern, um sicherzustellen, dass es bei normalen Aufgaben sowie bei KI-Aufgaben nicht zu Geschwindigkeitseinbußen kommt.

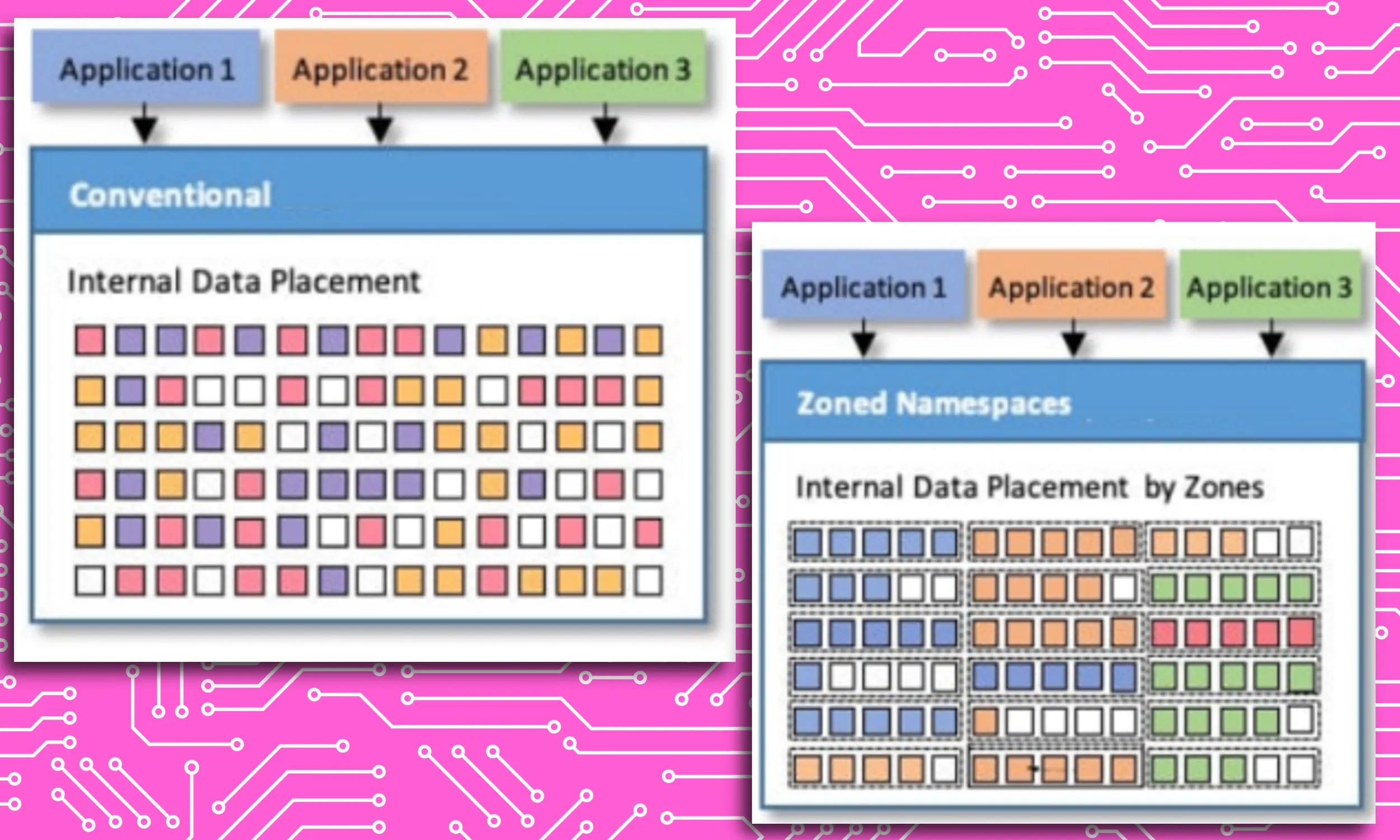

Die letzte Speicherverbesserung ist Zoned UFS. Dieses System stellt sicher, dass Daten ähnlicher Eingabe-/Ausgabeart organisiert gespeichert werden. Dies ist sehr wichtig, da es dem System erleichtert, die erforderlichen Dateien zu finden, anstatt Zeit mit der Suche in allen Ordnern und Verzeichnissen zu verschwenden.

„Die ZUFS-Funktion von Micron hilft bei der Organisation von Daten, sodass der Prozess schneller und reibungsloser abläuft, wenn das System bestimmte Daten für eine Aufgabe finden muss“, sagte uns Rivera.

RAM-Überlauf

Wenn es um KI-Workflows geht, benötigen Sie eine bestimmte Menge RAM. Je mehr Kapazität, desto besser. Während Apple für seine Apple Intelligence Suite einen Basiswert von 8 GB festgelegt hat, sind die Player im Android-Ökosystem auf 12 GB als sicheren Standard umgestiegen. Warum?

„KI-Erlebnisse sind auch daten- und energieintensiv“, erklärt Rivera. „Um das Versprechen der KI zu erfüllen, müssen Arbeitsspeicher und Datenspeicher geringe Latenz und hohe Leistung bei maximaler Energieeffizienz bieten.“

Mit seiner 5γ (1-gamma) LPDDR1X DRAM-Lösung der nächsten Generation für Smartphones konnte Micron die Betriebsspannung von Speichermodulen reduzieren. Dann ist da noch die alles entscheidende Frage der lokalen Leistung. Rivera sagt, dass die neuen Speichermodule mit Geschwindigkeiten von bis zu 9.6 Gigabit pro Sekunde arbeiten können und so eine herausragende KI-Leistung gewährleisten.

Laut Micron haben Verbesserungen an seinem Extrem-Ultraviolett-Lithografieprozess (EUV) nicht nur die Tür zu höheren Geschwindigkeiten geöffnet, sondern auch zu einer Steigerung der Energieeffizienz um satte 20 %.

Der Weg zu personalisierteren KI-Erlebnissen?

Die RAM- und Speicherlösungen der nächsten Generation von Micron für Smartphones zielen nicht nur auf eine verbesserte KI-Leistung ab, sondern auch auf die allgemeine Beschleunigung Ihrer alltäglichen Smartphone-Aufgaben. Ich habe mich gefragt, ob der verbesserte mobile NAND-UFS-9-Speicher und der 4.1γ-(1-Gamma)-LPDDR1X-RAM des G5 auch Offline-KI-Prozessoren beschleunigen würden.

Sowohl Smartphone-Hersteller als auch KI-Labore bewegen sich zunehmend in Richtung lokaler KI-Verarbeitung. Dies bedeutet, dass Ihre Abfragen nicht an einen Cloud-Server gesendet werden, wo der Prozess verarbeitet wird und das Ergebnis dann über eine Internetverbindung an Ihr Telefon gesendet wird, sondern dass der gesamte Workflow lokal auf Ihrem Telefon ausgeführt wird.

Von der Transkription von Anrufen und Sprachnotizen bis hin zur Verarbeitung komplexer Forschungsmaterialien in PDFs geschieht alles auf Ihrem Telefon und es werden niemals persönliche Daten von Ihrem Gerät übertragen. Es handelt sich dabei zwar um einen sichereren und schnelleren Ansatz, erfordert jedoch gleichzeitig leistungsstarke Systemressourcen. Ein schnelleres, effizienteres Speichermodul ist eine dieser wesentlichen Anforderungen.

Können die Lösungen der nächsten Generation von Micron dabei helfen, KI lokal anzugehen? Sie kann. Tatsächlich werden dadurch auch Prozesse beschleunigt, die eine Cloud-Verbindung erfordern, wie etwa das Erstellen von Videos mit dem Veo-Modell von Google, für das immer noch leistungsstarke Computerserver erforderlich sind.

„Eine native KI-Anwendung, die direkt auf dem Gerät ausgeführt wird, hat den meisten Datenverkehr, da sie nicht nur Benutzerdaten vom Speichergerät liest, sondern auch KI-Inferenzen auf dem Gerät durchführt“, sagt Rivera. „In diesem Fall helfen unsere Funktionen, den Datenfluss für beide zu optimieren.“

Wann können Sie also damit rechnen, dass Telefone mit den neuesten Lösungen von Micron auf den Markt kommen? Rivera sagt, dass alle großen Smartphone-Hersteller die RAM- und Speichermodule der nächsten Generation von Micron übernehmen werden. In Bezug auf den Marktzugang sollten Sie „Hauptmodelle, die Ende 2025 oder Anfang 2026 auf den Markt kommen“ auf Ihrem Einkaufsradar haben.

Kommentarfunktion ist geschlossen.