Google bringt Gemini 2.0 Pro und Flash-Lite auf den Markt und verbindet Flash Thinking mit YouTube, Maps und der Suche

Googles Gemini-Reihe großer Sprachmodelle (LLMs) hatte vor fast einem Jahr einen holprigen Start mit einigen peinlichen, falsch generierten Bildern. Seitdem hat sich die Serie jedoch stetig verbessert und das Unternehmen scheint entschlossen zu sein, seine zweite Generation – Gemini 2.0 – zur bisher größten und besten für Verbraucher und Unternehmen zu machen.

اليوم, Angekündigt Das Unternehmen kündigte die öffentliche Veröffentlichung von Gemini 2.0 Flash an, stellte Gemini 2.0 Flash-Lite vor und veröffentlichte eine Betaversion von Gemini 2.0 Pro.

Diese Modelle, die zur Unterstützung von Entwicklern und Unternehmen entwickelt wurden, sind jetzt über Google AI Studio und Vertex AI verfügbar, wobei Flash-Lite in der öffentlichen Vorschau und Pro für frühe Tests verfügbar ist.

„Alle diese Modelle werden bei der Veröffentlichung über Multimedia-Eingabe mit Textausgabe verfügen, wobei Plus Media in den kommenden Monaten für die allgemeine Nutzung verfügbar sein wird“, schrieb Google DeepMind CTO Koray Cavukcioglu im Blogbeitrag des Unternehmens, in dem die Ankündigung angekündigt wurde – ein Vorteil, den Google mit sich bringt, selbst wenn Konkurrenten wie DeepSeek Und OpenAI Durch die Einführung starker Wettbewerber.

Google nutzt seine Multimedia-Fähigkeiten

Weder der DeepSeek-R1 noch OpenAIs neues o3-mini-Modell Akzeptieren Sie Multimedia-Eingaben, z. B. Bilder, Datei-Uploads oder Anhänge.

Das R1-Modell kann sie zwar auf seiner Website und in seiner mobilen Chat-App akzeptieren, nutzt jedoch die optische Zeichenerkennung (OCR), eine über 60 Jahre alte Technologie, um aus diesen Uploads nur den Text zu extrahieren – und versteht oder analysiert keine der anderen darin enthaltenen Funktionen.

Beide stellen jedoch eine neue Klasse von „Denkmodellen“ dar, die sich bewusst mehr Zeit nehmen, um Antworten zu durchdenken und über „Gedankenketten“ und die Gültigkeit ihrer Antworten nachzudenken. Dies steht im Gegensatz zu typischen großen Sprachmodellen wie der Gemini 2.0 Pro-Serie. Ein Vergleich von Gemini 2.0 mit DeepSeek-R1 und OpenAI o3 ist also wie ein Vergleich von Äpfeln mit Birnen.

Aber auch von Google selbst gab es heute Neuigkeiten: Google-CEO Sundar Pichai verkündete via X-Plattform Informationen zum Anwendungsupdate Google Gemini Für iOS- und Android-Mobiltelefone mit Gemini 2.0 Flash Thinking. Das Modell kann mit Google Maps, YouTube und Google Search verbunden werden und ermöglicht so eine ganze Reihe neuer KI-gestützter Suchvorgänge und Interaktionen, mit denen neue Wettbewerber wie DeepSeek und OpenAI ohne diese Dienste nicht mithalten können.

Ich habe es beim Schreiben dieses Artikels kurz mit der Google Gemini iOS-App auf meinem iPhone ausprobiert und es war auf der Grundlage meiner ersten Anfragen beeindruckend: Es stellte Ähnlichkeiten zwischen den zehn meistgesehenen YouTube-Videos des letzten Monats fest und lieferte mir innerhalb von Sekunden eine Liste der Arztpraxen in der Nähe und deren Öffnungszeiten.

Öffentliche Version von Gemini 2.0 Flash

Das Gemini 2.0 Flash-Modell, das zunächst als Beta-Version auf den Markt kam, ist Im Dezember, jetzt produktionsbereit.

Es wurde für hocheffiziente KI-Anwendungen entwickelt, liefert Antworten mit geringer Latenz und unterstützt multimodales Denken im großen Maßstab.

Einer seiner Hauptvorteile gegenüber der Konkurrenz ist sein Kontextfenster oder die Anzahl der Token, die ein Benutzer als Anreiz hinzufügen und in einer einzigen Hin- und Her-Interaktion mit einem LLM-gestützten Chatbot oder einer API zurückerhalten kann.

Während viele führende Modelle, wie etwa OpenAIs neuer o3-mini, der letzte Woche vorgestellt wurde, 200000 Token oder weniger unterstützen – das entspricht einem 400- bis 500-seitigen Roman – unterstützt Gemini 2.0 Flash XNUMX Million Token. Das bedeutet, dass es enorme Mengen an Informationen verarbeiten kann und sich daher besonders für hochfrequente, groß angelegte Aufgaben eignet.

Gemini 2.0 Flash-Lite: Kostengünstige KI-Lösungen

Gemini 2.0 Flash-Lite ist ein brandneues großes Sprachmodell, das kostengünstige KI-Lösungen ohne Kompromisse bei der Qualität bereitstellen soll.

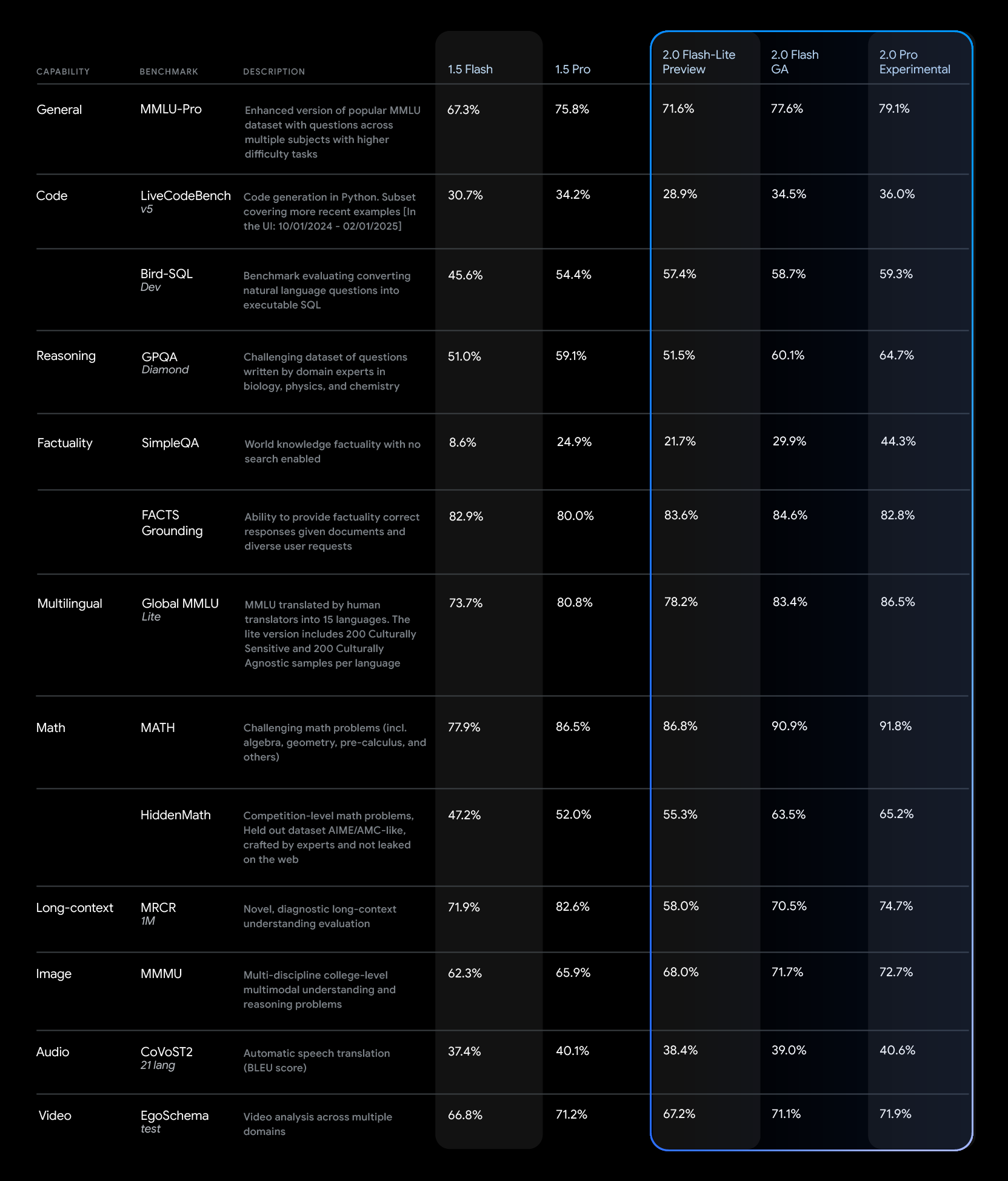

Google DeepMind berichtet, dass Flash-Lite seinen vollwertigen (stärker parametrisierten) Vorgänger Gemini 1.5 Flash bei externen Benchmarks wie MMLU Pro (77.6 % gegenüber 67.3 %) und Bird SQL (57.4 % gegenüber 45.6 %) übertrifft, während Preis und Geschwindigkeit gleich bleiben.

Es unterstützt auch Multimedia-Eingabe und verfügt über ein Kontextfenster mit 1 Million Token, ähnlich dem vollständigen Flash-Modell.

Flash-Lite ist derzeit als öffentliche Vorschau über Google AI Studio und Vertex AI verfügbar und wird voraussichtlich in den kommenden Wochen allgemein verfügbar sein.

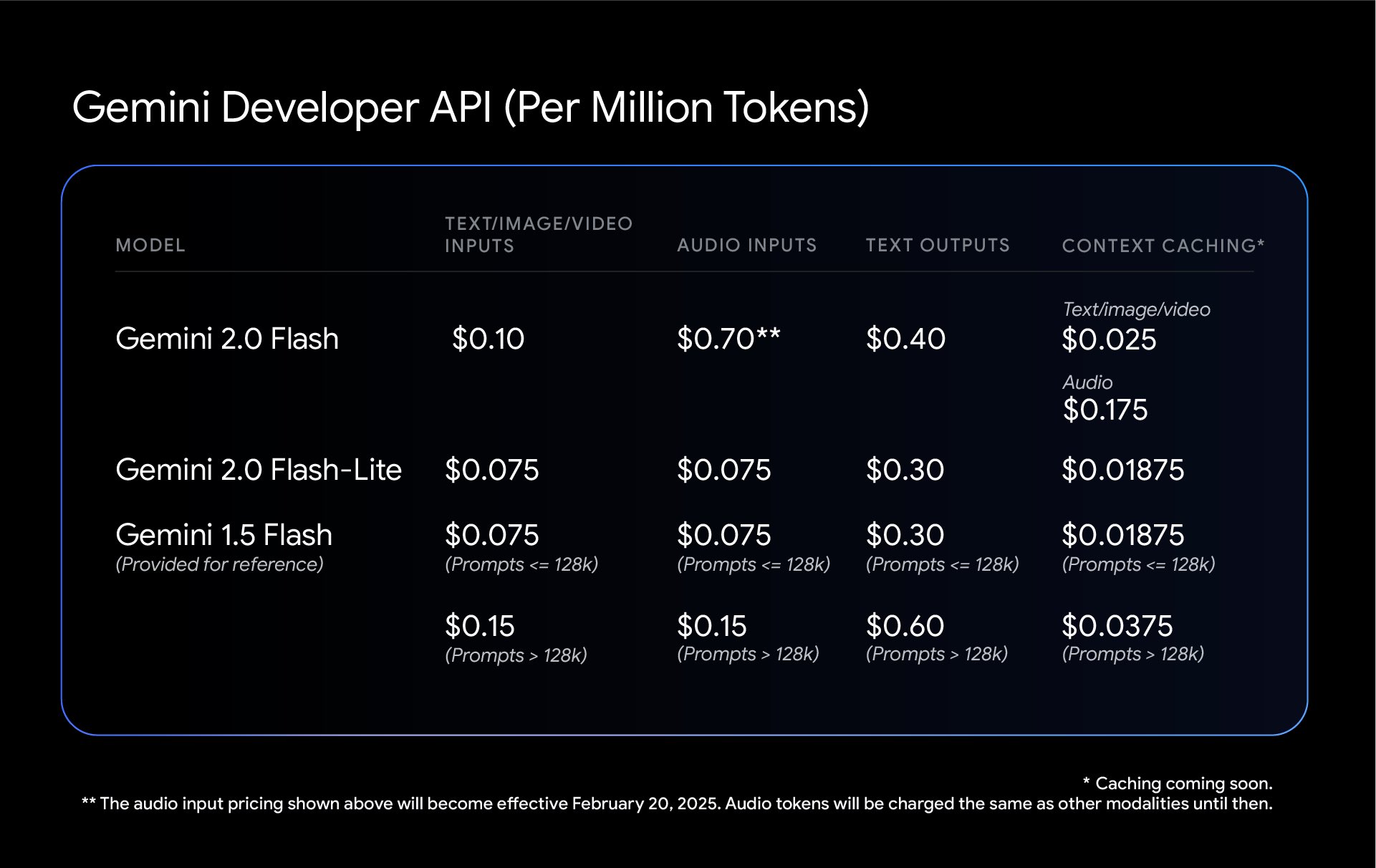

Wie in der folgenden Tabelle gezeigt, kostet Gemini 2.0 Flash-Lite 0.075 USD pro Million Token (Eingabe) und 0.30 USD pro Million Token (Ausgabe). Flash-Lite ist eine sehr kostengünstige Option für Entwickler und übertrifft Gemini 1.5 Flash in den meisten Benchmarks bei gleicher Kostenstruktur.

Logan Kilpatrick hob die Kosten und den Wert der Gemini 2.0 Flash-Modelle hervor, als Männlich auf X-Plattform„Der Gemini 2.0 Flash bietet das beste Preis-Leistungs-Verhältnis aller LLM-Modelle, es ist Zeit, ihn zu bauen!“

Im Vergleich zu anderen führenden traditionellen LLM-Modellen, die über die Provider-API verfügbar sind, wie z. B. OpenAI 4o-mini (0.15 USD/0.6 USD pro Million I/O-Token) und Anthropischer Claude (0.8 $/4 $! pro Million I/O-Token) und sogar DeepSeeks traditionellem LLM V3 (0.14 $/0.28 $) scheint Gemini 2.0 Flash das beste Preis-Leistungs-Verhältnis zu bieten.

Gemini 2.0 Pro Beta kommt mit 2 Millionen Symbolen im Kontextfenster

Das Modell Gemini 2.0 Pro (Beta) steht jetzt zum Testen für Benutzer zur Verfügung, die erweiterte KI-Funktionen benötigen.

Google DeepMind beschreibt dieses Modell als sein leistungsstärkstes Modell hinsichtlich der Programmierleistung und der Fähigkeit, komplexe Eingabeaufforderungen zu verarbeiten. Es verfügt über ein Kontextfenster mit 2 Millionen Zeichen und erweiterte Argumentationsfunktionen mit der Möglichkeit, externe Tools wie Google Search und Codeausführung zu integrieren.

Sam Witteveen, Mitbegründer und CEO von Red Dragon AI und externer Experte für maschinelles Lernen bei Google, der häufig mit VentureBeat zusammenarbeitet, diskutierte: Profi-Modell im YouTube-Test. „Das neue Gemini 2.0 Pro-Modell verfügt über ein Kontextfenster mit 1.5 Millionen Symbolen, unterstützt Widgets, Codeausführung, Funktionsaufrufe und die Integration mit der Google-Suche – alles, was wir in Pro XNUMX hatten, aber verbessert.“

Er verwies auch auf Googles iterativen Ansatz bei der KI-Entwicklung: „Ein wesentlicher Unterschied in der Strategie von Google besteht darin, dass Betaversionen von Modellen veröffentlicht werden, bevor diese allgemein verfügbar (GA) werden. Dies ermöglicht eine schnelle Iteration auf der Grundlage von Feedback.“

Leistungsbenchmarks belegen die Leistungsfähigkeit der Gemini 2.0-Modellfamilie zusätzlich. Beispielsweise übertrifft Gemini 2.0 Pro Flash und Flash-Lite bei Aufgaben wie logischem Denken, mehrsprachigem Verständnis und der Verarbeitung langer Kontexte.

KI-Sicherheit und zukünftige Entwicklungen

KI-Sicherheit und zukünftige Entwicklungen

Zusammen mit diesen Updates implementiert Google DeepMind neue Sicherheitsmaßnahmen für seine Gemini 2.0-Modelle. Das Unternehmen nutzt Techniken des bestärkenden Lernens, um die Reaktionsgenauigkeit zu verbessern, und setzt künstliche Intelligenz ein, um seine Ergebnisse zu überprüfen und zu verbessern. Darüber hinaus werden automatisierte Sicherheitstests verwendet, um Schwachstellen zu identifizieren, darunter auch indirekte Bedrohungen durch Claim Injection.

Mit Blick auf die Zukunft plant Google DeepMind, die Fähigkeiten der Gemini 2.0-Modellfamilie zu erweitern. In den kommenden Monaten werden voraussichtlich weitere Methoden über Text hinaus allgemein verfügbar sein.

Mit diesen Updates verstärkt Google seinen Vorstoß in die KI-Entwicklung und führt eine Reihe von Modellen ein, die auf Effizienz, Erschwinglichkeit und fortgeschrittene Problemlösung ausgelegt sind. Als Reaktion auf den Aufstieg von DeepSeek bietet Google eine eigene Reihe von Modellen an, die von leistungsstark bis sehr leistungsstark und von sehr erschwinglich bis etwas weniger teuer (aber immer noch erschwinglich) reichen.

Wird dies ausreichen, um Google dabei zu helfen, in den Markt für Unternehmens-KI einzudringen, der zuvor von OpenAI und jetzt von DeepSeek dominiert wird? Wir werden die Sache weiter verfolgen und Sie informieren!

Wenn Sie Ihren Chef beeindrucken möchten, hilft Ihnen VB Daily. Wir geben Ihnen Insiderinformationen darüber, was Unternehmen mit generativer KI machen, von organisatorischen Transformationen bis hin zu praktischen Einsätzen, damit Sie Erkenntnisse weitergeben können, um Ihren ROI zu maximieren.

KI-Sicherheit und zukünftige Entwicklungen

KI-Sicherheit und zukünftige Entwicklungen

Kommentarfunktion ist geschlossen.