Wie KI die täglichen Aufgaben von Datenwissenschaftlern neu definiert

Von der Eliminierung wertloser Aufgaben bis zur Beschleunigung wirkungsvoller Projekte: So verändert KI die Arbeitsabläufe der Datenwissenschaft.

In meinen vorherigen Artikeln habe ich verschiedene KI-Tools untersucht und verglichen, zum Beispiel den Data Science Agent von Google, ChatGPT vs. Claude vs. Gemini Für Data Science und DeepSeek V3, usw. Dies ist jedoch nur eine kleine Teilmenge aller verfügbaren KI-Tools für Daten Wissenschaft. Hier sind einige der Tools, die ich bei meiner Arbeit verwendet habe:

- OpenAI-API: Ich verwende es, um Kundenfeedback zu kategorisieren und zusammenzufassen und Produktschwächen zu identifizieren.

- ChatGPT Und GeminiSie helfen mir beim Verfassen von Slack-Nachrichten und E-Mails, beim Schreiben von Analyseberichten und sogar Leistungsbeurteilungen.

- Reine KI:Glean nutzte KI, um in Dokumenten und der internen Kommunikation schnell Antworten zu finden.

- Cursor Und Copilot: Ich genieße es, einfach Tab-Tab zu tippen, um Code und Kommentare automatisch zu vervollständigen.

- Hex-MagieIch verwende Hex für die gemeinsame Tabellenkalkulation bei der Arbeit. Es bietet auch eine Funktion namens Hex-Magie Code schreiben und Fehler mithilfe von Konversations-KI beheben.

- SchneeflockenrindeCortex AI ermöglicht es Benutzern, LLM-Endpunkte aufzurufen, RAGs und Text-zu-SQL-Dienste mithilfe von Daten in Snowflake zu erstellen.

Ich bin mir sicher, dass man diese Liste noch erweitern könnte, und täglich erscheinen neue KI-Tools. Es ist fast unmöglich, zum jetzigen Zeitpunkt eine vollständige Liste zu erstellen. Deshalb möchte ich in diesem Artikel einen Schritt zurücktreten und mich auf eine größere Frage konzentrieren: Was brauchen wir als Datenexperten wirklich und wie kann KI helfen?؟

Im folgenden Abschnitt werde ich mich auf zwei Haupttrends konzentrieren: die Beseitigung von Aufgaben mit geringem Wert und die Beschleunigung von Arbeiten mit hohem Wert.

1. Eliminieren Sie Aufgaben mit geringem Wert

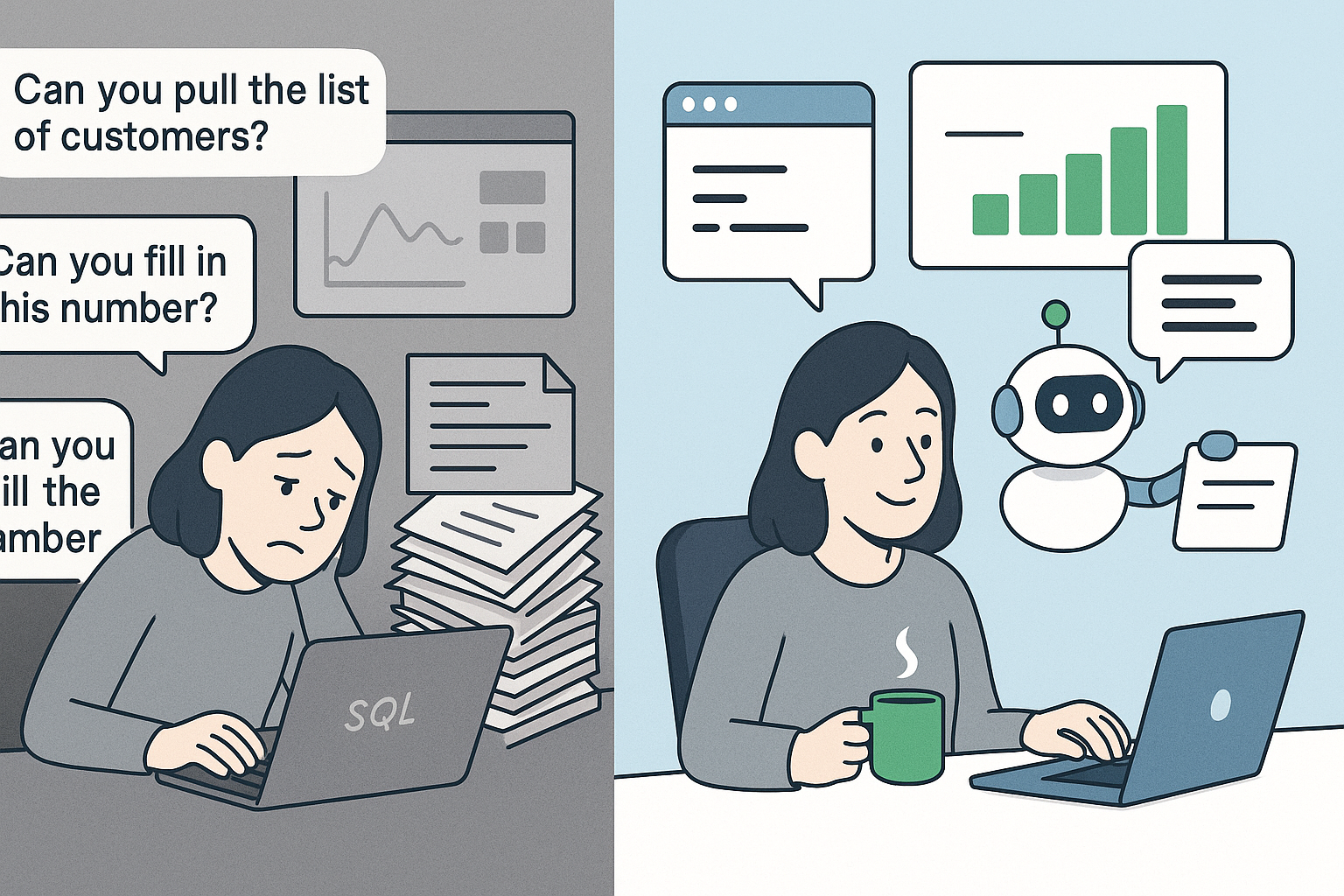

Ich bin Datenwissenschaftler geworden, weil es mir wirklich Spaß macht, aus komplexen Daten geschäftliche Erkenntnisse zu gewinnen und auf dieser Grundlage Geschäftsentscheidungen zu treffen. Allerdings muss ich, nachdem ich nun schon seit über 7 Jahren in diesem Bereich tätig bin, zugeben, dass nicht alle Arbeiten so spannend sind, wie ich gehofft hatte. Bevor wir erweiterte Analysen durchführen oder Modelle für maschinelles Lernen erstellen können, sind im Alltag viele wenig wertvolle Arbeitsabläufe unvermeidlich. Dies liegt in vielen Fällen daran, dass uns die richtigen Tools fehlen, um unseren Stakeholdern Self-Service-Analysen zu ermöglichen. Schauen wir uns unsere heutige Situation und den Idealfall an:

Aktueller Status: Wir fungieren als Dateninterpreten und Gatekeeper (manchmal „SQL-Affen“)

- Einfache Daten-Pull-Anfragen Sie kommt jede Woche über Slack zu mir und meinem Team und fragt: „Wie hoch war Ihr Bruttowarenwert (GMV) im letzten Monat?“ „Können Sie eine Liste der Kunden aufrufen, die diese Kriterien erfüllen?“ „Können Sie mir helfen, diese Nummer für die Präsentation einzutragen, die ich morgen halten muss?“

- Business Intelligence (BI)-Tools unterstützen Self-Service-Anwendungsfälle nicht gut.. Wir haben Business-Intelligence-Tools wie Looker und Tableau eingeführt, damit die Beteiligten Daten problemlos untersuchen und Kennzahlen überwachen können. Tatsächlich muss jedoch immer ein Kompromiss zwischen Einfachheit und der Möglichkeit zur Selbstbedienung eingegangen werden. Manchmal gestalten wir Dashboards mithilfe einiger Kennzahlen leicht verständlich, sie können jedoch nur für wenige Anwendungsfälle verwendet werden. Wenn wir das Tool gleichzeitig so anpassen, dass es frei an die zugrunde liegenden Kennzahlen und Daten herangeführt werden kann, kann es sein, dass die Beteiligten das Tool verwirrend finden und sich nicht sicher genug sind, es zu verwenden. Im schlimmsten Fall werden möglicherweise Daten extrahiert und falsch interpretiert.

- Es liegen nur wenige oder veraltete Dokumente vor.. Dies kommt häufig vor, kann aber verschiedene Gründe haben – vielleicht arbeiten wir schnell und konzentrieren uns darauf, Ergebnisse zu liefern, oder es sind keine guten Richtlinien zur Datendokumentation und -verwaltung vorhanden. Dies führt dazu, dass Stammeswissen für Personen außerhalb des Datenteams zu einem Engpass bei der Nutzung der Daten wird.

Idealfall: Ermöglichen Sie Stakeholdern die Selbstbedienung, damit wir wenig wertschöpfende Arbeit reduzieren können

- Stakeholder können einfache Datenabfragen durchführen und grundlegende Datenfragen mühelos und sicher beantworten.

- Datenteams verbringen weniger Zeit mit der Erstellung wiederkehrender Berichte oder einfacher einmaliger Abfragen.

- Dashboards sind ohne direkte Hilfe erkennbar, interpretierbar und umsetzbar.

Welche Rolle kann KI also spielen, um dem Idealzustand näher zu kommen? Nach meinen Beobachtungen sind dies die allgemeinen Trends, in die sich KI-Tools bewegen, um die Lücke zu schließen:

- Datenabfrage in natürlicher Sprache (Text-to-SQL)Eine Möglichkeit, die technischen Hürden zu senken, besteht darin, den Beteiligten die Abfrage von Daten in natürlicher Sprache zu ermöglichen. Es gibt in der Branche viele Text-to-SQL-Bemühungen:

- zum Beispiel, Schneeflocke Es ist eines der Unternehmen, das große Fortschritte erzielt hat in Text2SQL-Modelle Und begann, diese Fähigkeit in sein Produkt zu integrieren.

- Viele Unternehmen (einschließlich meines) haben Text2SQL-Lösungen auch intern erkundet. Ich habe zum Beispiel teilgenommen Uber Ihre Reise mit Ubers QueryGPT Um dem Betriebsteam die Datenabfrage zu erleichtern. In diesem Artikel wird detailliert beschrieben, wie Uber eine Multi-Agenten-Architektur zum Generieren von Abfragen entwickelt hat. Gleichzeitig wurden jedoch auch erhebliche Herausforderungen in diesem Bereich deutlich, darunter die genaue Interpretation der Benutzerabsicht, die Handhabung großer Tabellendiagramme, die Vermeidung von Halluzinationen usw.

- Ehrlich gesagt, damit Text-to-SQL funktioniert, müssen Sie die Abfrage auf einer sehr hohen Ebene genau gestalten – selbst wenn das Tool nur einmal versagt, kann dies das Vertrauen zerstören und die Stakeholder werden sich letztendlich wieder an Sie wenden, um die Abfragen zu validieren (und dann müssen Sie die Abfragen lesen und neu schreiben, was die Arbeit fast verdoppelt 🙁). Bisher habe ich keine Text-zu-SQL-Vorlage oder kein Text-zu-SQL-Tool gefunden, das perfekt funktioniert. Meiner Ansicht nach ist dies nur erreichbar, wenn Sie eine sehr kleine Teilmenge gut dokumentierter zugrunde liegender Datensätze für bestimmte, standardisierte Anwendungsfälle abfragen. Es ist jedoch sehr schwierig, eine Skalierung vorzunehmen, um alle verfügbaren Daten und unterschiedlichen Geschäftsszenarien einzubeziehen.

- Angesichts der massiven Investitionen in diesem Bereich und der rasanten Entwicklung der KI bin ich mir jedoch sicher, dass wir präzisen und skalierbaren Text-to-SQL-Lösungen immer näher kommen werden.

- Chatbasierter Business Intelligence (BI)-AssistentEin weiterer beliebter Bereich zur Verbesserung der Stakeholder-Erfahrung mit BI-Tools ist ein chatbasierter BI-Assistent. Dies geht sogar noch einen Schritt weiter als Text-to-SQL: Anstatt eine SQL-Abfrage basierend auf der Eingabeaufforderung des Benutzers zu generieren, antwortet es in einem Visualisierungsformat sowie einer Textzusammenfassung.

- Zwillinge in Looker Er ist hier ein Beispiel. Looker ist Eigentum von Google, daher ist die Integration mit Gemini für das Unternehmen eine Selbstverständlichkeit. Ein weiterer Vorteil für Looker beim Aufbau seiner KI besteht darin, dass Datenfelder bereits in der semantischen Ebene von LookML dokumentiert sind, gemeinsame Zuordnungen definiert und gemeinsame Metriken in Dashboards enthalten sind. Es gibt also eine Menge toller Daten, aus denen man lernen kann. Mit Gemini können Benutzer Looker-Dashboards anpassen, Fragen zu den Daten stellen und sogar benutzerdefinierte Datenagenten für die Konversationsanalyse erstellen. Obwohl ich nur begrenzte Erfahrung mit dem Tool habe, kann ich sagen, dass es manchmal nicht einmal einfache Fragen beantworten kann. Lassen Sie mich wissen, ob Sie andere Erfahrungen gemacht haben und es funktioniert hat …

- Tableau hat auch eine ähnliche Funktion eingeführt, Tableau-KI. Ich habe es selbst nicht verwendet, aber der Demo zufolge hilft es dem Datenteam, Daten vorzubereiten, schnell Dashboards in natürlicher Sprache zu erstellen und Datenerkenntnisse in Tableau Pulse zusammenzufassen, damit die Beteiligten Messwertänderungen und ungewöhnliche Trends leicht erkennen können.

- DatenindizierungstoolsKI kann auch dazu beitragen, die Herausforderung zu bewältigen, die entsteht, wenn Daten nur unzureichend oder gar nicht dokumentiert sind.

- Ich erinnere mich, dass eines der Projekte unserer Dateningenieure während eines internen Hackathons darin bestand, LLM zu verwenden, um die Abdeckung der Tabellendokumentation zu erhöhen. KI kann die Codebasis lesen und Spalten in den meisten Fällen mit hoher Genauigkeit entsprechend beschreiben, sodass sie dazu beitragen kann, die Dokumentation mit begrenzter menschlicher Validierung und Änderungen schnell zu verbessern.

- Wenn mein Team neue Tabellen erstellt, bitten wir Cursor nun, YAML-Dateien für die Tabellendokumentation zu schreiben, um uns durch die Bereitstellung hochwertiger Ergebnisse Zeit zu sparen.

- Es gibt auch viele Datenkataloge und Governance-Tools, die mit KI integriert wurden. Wenn ich bei Google nach „AI-Datenindex“ suche, sehe ich Logos von Datenindexierungstools wie Atlan, Alation, Collibra, Informatica usw. (Haftungsausschluss: Ich habe keines davon verwendet). Dies ist ein klarer Branchentrend.

2. Beschleunigen Sie hochwertige Arbeit

Nachdem wir nun darüber gesprochen haben, wie KI dazu beitragen kann, Aufgaben mit geringem Wert zu eliminieren, wollen wir nun darüber diskutieren, wie sie Datenprojekte mit hohem Wert beschleunigen kann. „Hochwertige Arbeit“ bezieht sich hier auf Datenprojekte, die technische Exzellenz mit geschäftlichem Kontext kombinieren und durch abteilungsübergreifende Zusammenarbeit eine bedeutende Wirkung erzielen. Beispielsweise eine eingehende Analyse, die Produktnutzungsmuster versteht und zu Produktänderungen führt, oder ein Kundenabwanderungsvorhersagemodell, um Kunden mit Abwanderungsrisiko zu identifizieren und Initiativen zur Abwanderungsprävention zu entwickeln. Vergleichen wir die aktuelle Situation mit der idealen Zukunft:

Aktueller Stand: Es gibt Engpässe bei ا٠„Ø ¥ Ù † ØªØ§Ø¬ÙŠØ © Im täglichen Arbeitsablauf

- Die explorative Datenanalyse (EDA) ist zeitaufwändig.. Dieser Schritt ist wichtig, um ein erstes Verständnis der Daten zu erlangen, aber die Durchführung aller univariaten und multivariaten Analysen kann zeitaufwändig sein.

- Zeitverschwendung beim Codieren und Debuggen. Seien wir ehrlich: Niemand kann sich alle Modellparameter von Numpy, Pandas und Sklearn merken. Wir müssen beim Codieren ständig nach Dokumentation suchen.

- Umfangreiche unstrukturierte Daten werden nicht vollständig genutzt.. Unternehmen generieren täglich große Mengen Textdaten aus Umfragen, Support-Tickets und Bewertungen. Doch die Frage, wie sich Erkenntnisse auf skalierbare Weise gewinnen lassen, bleibt eine Herausforderung.

Idealfall: Datenwissenschaftler konzentrieren sich auf tiefes Denken, nicht auf die Syntax.

- Das Schreiben von Code geht schneller, wenn man nicht die Syntax nachschlagen muss.

- Analysten verbringen mehr Zeit mit der Interpretation der Ergebnisse und weniger Zeit mit der Arbeit mit Daten.

- Unstrukturierte Daten stellen kein Hindernis mehr dar und können schnell analysiert werden.

Wenn Sie den Idealfall sehen, haben Sie sicher bereits einige KI-Tools im Sinn. Sehen wir uns an, welche Auswirkungen KI tatsächlich haben oder einen Unterschied machen kann:

- KI-Assistenten zum Codieren und Debuggen. Ich denke, dies ist bei weitem die zuverlässigste Art von KI-Tool für jeden, der Code schreibt. Wir sehen bereits, dass es wieder passiert.

- Wenn LLM-Chatbots wie ChatGPT Und ClaudeIngenieure erkannten, dass sie ihre Syntaxfragen oder Fehlermeldungen einfach an einen Chatbot stellen konnten, der äußerst genaue Antworten erhielt. Dies stellt zwar immer noch eine Unterbrechung Ihres Codierungs-Workflows dar, ist jedoch viel besser, als durch Dutzende von StackOverflow-Registerkarten zu klicken – und das fühlt sich bereits wie im letzten Jahrhundert an.

- Später sehen wir Plus und Plus integrierter KI-Codierungstools entstehen – integriert GitHub-Copilot Und Cursor Mit Ihrem Code-Editor können sie Ihre Codebasis lesen, um proaktiv Codevervollständigung und Debugging-Probleme innerhalb Ihrer IDE vorzuschlagen.

- Wie ich eingangs kurz erwähnt habe, Schneeflocke Und Sechskant Es enthält außerdem KI-Codierungsassistenten, die Datenanalysten und Datenwissenschaftlern das Schreiben von Code erleichtern.

- Künstliche Intelligenz für explorative Datenanalyse und -auswertung. Dies ähnelt in gewisser Weise den oben erwähnten chatbasierten BI-Assistenztools, hat jedoch ein ehrgeizigeres Ziel: Es beginnt mit Rohdatensätzen und zielt darauf ab, den gesamten Analysezyklus aus Datenbereinigung, Vorverarbeitung, explorativer Analyse und manchmal sogar Modellierung zu automatisieren. Dies sind die Tools, die oft als „Ersatz für Datenanalysten“ angepriesen werden (aber tun sie das wirklich?).

- Google Data Science Agent Es ist ein sehr beeindruckendes neues Tool, das mit einer einfachen Eingabeaufforderung ein komplettes Jupyter-Notebook erstellen kann. Ich schrieb vor kurzem ein Artikel Erklärt, was er tun kann und was nicht. Kurz gesagt, es kann schnell ein gut organisiertes Jupyter-Notebook erstellen, das auf der Grundlage eines anpassbaren Ausführungsplans ausgeführt wird. Es fehlen jedoch die Funktionen zum Ändern eines Jupyter-Notebooks auf der Grundlage von Folgefragen. Außerdem ist weiterhin jemand mit fundierten Kenntnissen in Datenwissenschaft erforderlich, um Methoden zu überprüfen und manuelle Iterationen durchzuführen. Außerdem ist eine klare Darstellung des Datenproblems mit sauberen, gut dokumentierten Datensätzen erforderlich. Ich halte es daher für ein großartiges Tool, um beim anfänglichen Code etwas Zeit zu sparen, anstatt unsere Arbeitsplätze zu gefährden.

- Es kann auch klassifiziert werden als ChatGPT-Datenanalysetool In diesem Rahmen. Ermöglicht Benutzern, einen Datensatz hochzuladen und mit ihm zu chatten, um ihre Analyse abzuschließen, Visualisierungen zu erstellen und Fragen zu beantworten. Sie finden meinen vorherigen Artikel, in dem seine Fähigkeiten erläutert werden. hier. Es steht auch vor ähnlichen Herausforderungen und funktioniert besser als EDA-Assistent, als dass es Datenanalysten ersetzt.

- NLP-Funktionen sind einfach zu verwenden und skalierbar.. LLM ist großartig in Gesprächen. Daher ist NLP mit dem heutigen LLM deutlich einfacher geworden.

- Mein Unternehmen veranstaltet jedes Jahr einen internen Hackathon. Ich erinnere mich, dass ich bei meinem Hackathon-Projekt vor drei Jahren BERT und andere traditionelle Methoden der Themenmodellierung ausprobiert habe, um Antworten auf NPS-Umfragen zu analysieren. Das hat zwar Spaß gemacht, war aber ehrlich gesagt sehr schwierig, es präzise und für das Unternehmen aussagekräftig zu gestalten. Dann haben wir vor zwei Jahren bei einem Hackathon versucht, OpenAI-API Die Klassifizierung und Zusammenfassung der Feedback-Daten selbst funktionierte einwandfrei und ermöglichte hochpräzise thematische Modellierung, Sentimentanalyse und Feedback-Klassifizierung mit nur einem API-Aufruf. Die Ergebnisse passten dank der Systemeingaben perfekt zu unserem Geschäftskontext. Später bauten wir eine interne Pipeline auf, die sich problemlos um Textdaten aus Umfrageantworten, Support-Tickets, Verkaufsgesprächen, Nutzerforschungsnotizen usw. erweitern ließ. Sie wurde zur zentralen Anlaufstelle für Kundenfeedback und prägte unsere Produkt-Roadmap. Sie finden Plus unter Dieser technische Blog.

- Darüber hinaus gibt es viele neue Unternehmen, die KI-gestützte Analysetools für Kundenfeedback, Produktbewertungsanalysetools, Tools für Kundendienstassistenten und mehr entwickeln. Die Ideen sind alle dieselben: Sie nutzen die Fähigkeit von LLM, den Kontext von Text zu verstehen und Gespräche zu führen, um KI-Agenten zu erstellen, die auf Textanalyse spezialisiert sind.

Fazit

Es ist leicht, sich von den neuesten Tools für künstliche Intelligenz (KI) verwirren zu lassen. Doch letztendlich kommt es vor allem darauf an, mithilfe von KI das zu beseitigen, was uns ausbremst, und das zu beschleunigen, was uns voranbringt. Der Schlüssel liegt darin, pragmatisch zu bleiben: Übernehmen Sie, was heute funktioniert, bleiben Sie neugierig auf das, was sich ergibt, und verlieren Sie nie das Kernziel der Datenwissenschaft aus den Augen – nämlich durch besseres Verständnis bessere Entscheidungen zu treffen.

Kommentarfunktion ist geschlossen.