Meine persönliche Erfahrung: Einen echten KI-Chatbot lokal auf einem iPhone ausführen

KI-gestützte Chatbots, wie zum Beispiel: ChatGPT Und Gemini...auf Cloud Computing angewiesen zu sein. Doch was wäre, wenn Sie ein großes Sprachmodell (LLM) direkt auf Ihrem iPhone ausführen könnten, ohne ein Abonnement oder eine Internetverbindung zu benötigen oder Ihre Daten das Gerät verlassen zu müssen? Dank einer Reihe leichter, kompakter Apps und Modelle ist dies bereits möglich.

Ich habe es selbst ausprobiert und hier ist, was Sie wissen müssen.

Führen Sie KI lokal auf dem iPhone aus

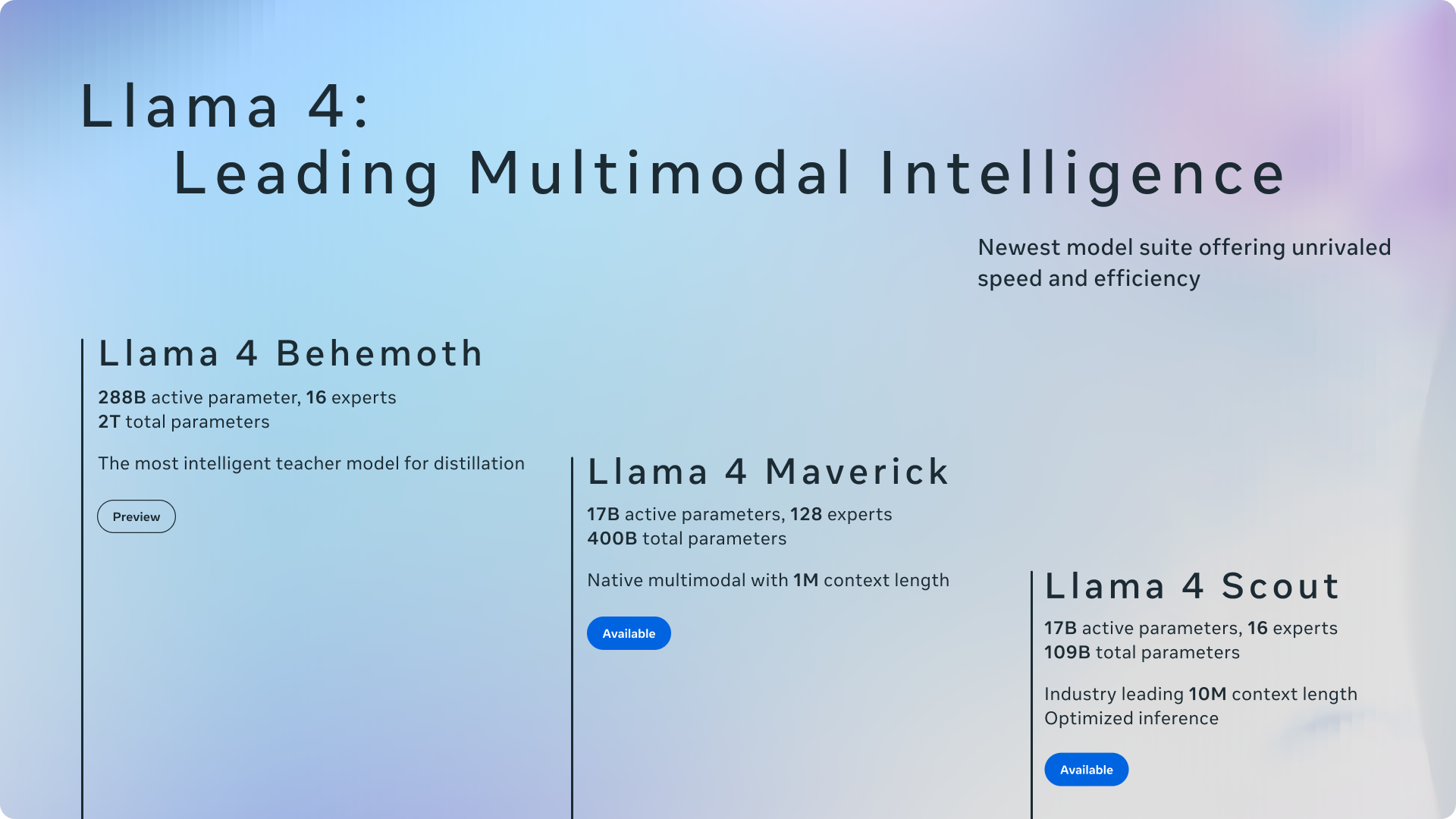

Sie können jetzt Open-Source-Modelle wie Lama Und Qwen Direkt auf iOS. Diese Modelle werden mithilfe eines Prozesses namens Quantisierung reduziert, der sie so komprimiert, dass sie in den mobilen Speicher passen, ohne die Leistung wesentlich zu beeinträchtigen.

Aber es gibt einen wichtigen Punkt: Die Leistung hängt stark von Ihrem Gerät ab. Beispielsweise kann das iPhone 15 Pro oder 15 Pro Max, ausgestattet mit Apples neuestem Chip, Modelle mit bis zu 7 oder 8 Milliarden Parametern ausführen (wie das Llama 3.1 8B), während für ältere Telefone kleinere Modelle mit Parametern zwischen 1 und 3 Milliarden besser geeignet sind.

Apps, die es möglich machen

- LLM Farm (kostenlos): Der einfachste Einstieg. Sie können ein kleines Modell (z. B. Phi-3.5 Instruct) herunterladen und mit nur einem Klick offline ausführen. Schnelle Abfragen lassen sich damit überraschend einfach durchführen.

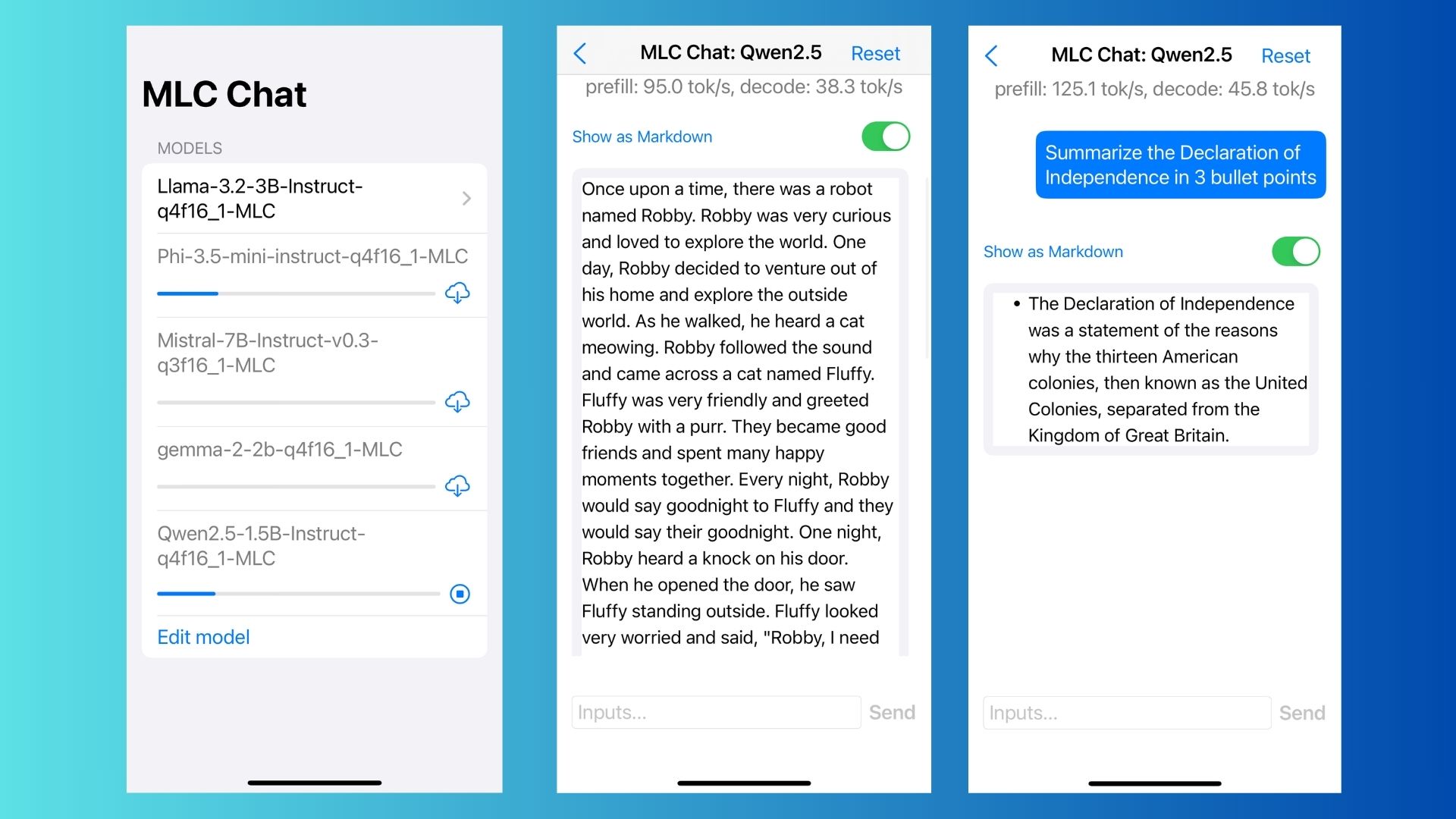

- MLC-Chat (kostenlos):

Dies ist die App, die ich verwendet habe. Ich wollte LLM Farm ausprobieren, aber aus irgendeinem Grund war sie im Apple App Store nicht zum Download verfügbar. Da sie kostenlos ist, habe ich sie ausprobiert und sie hat einwandfrei funktioniert. - Privater LLM (Gemeinschaftsprojekt): Diese Option ist eher ein DIY-Projekt als für den Durchschnittsnutzer. Die App enthält detaillierte Anleitungen zum Herunterladen von Modellen wie Llama 3.1 und Qwen auf Ihr iPhone. Wenn Sie gerne basteln und experimentieren, ist es definitiv einen Versuch wert.

- Apollo (kostenpflichtig): Ich habe Gutes darüber gehört, es aber selbst noch nicht ausprobiert. Lass mich in den Kommentaren wissen, was du von dieser datenschutzorientierten App hältst.

So führen Sie das Modell lokal aus

Nachdem Sie die gewünschte App heruntergeladen haben, öffnen Sie sie. Durchsuchen Sie dort die Liste der integrierten Modelle und wählen Sie eines aus (z. B. Phi-3.5 Instruct Q4 quantisiert). Ich habe mich für Qwen 2.5 entschieden, weil ich es schon länger nicht mehr benutzt hatte.

Nach dem Download wird das Formular auf Ihrem Gerät angezeigt (es kann zwischen einigen hundert Megabyte und mehreren Gigabyte groß sein). Von dort aus können Sie einfach mit dem Chatten beginnen.

Seien Sie realistisch. Jetzt ist nicht der richtige Zeitpunkt, um detaillierte Analysen oder lange, detaillierte Pläne zu verlangen. Bedenken Sie Folgendes:

- die Geschwindigkeit: Kleine Modelle (1–3 Milliarden Parameter) reagieren schneller, während große Modelle pro Symbol Sekunden benötigen können.

- Kontext: Fügen Sie keine ganzen Artikel ein; halten Sie die Eingabeaufforderungen kürzer.

- Ausgabe: Lokale Großsprachenmodelle sind möglicherweise weniger genau als ChatGPT, aber sie sind nützlich zum Notieren, für Zusammenfassungen, Fragen und Antworten und zum Verfassen einfacher Entwürfe.

Es hat mir Spaß gemacht, einige der Eingabeaufforderungen auszuprobieren. Nichts Kompliziertes; ich wollte nur sehen, welche Antworten ich auf die lokale Anfrage bekomme. Was Ihnen sofort auffällt, ist die Geschwindigkeit. Es ist erstaunlich, wie schnell ein großes Sprachmodell reagiert.

Ich habe die folgenden Behauptungen ausprobiert und insgesamt waren die Ergebnisse für mich zufriedenstellend.

- Fassen Sie die Unabhängigkeitserklärung in drei Punkten zusammen.

- „Schreiben Sie eine kurze Gutenachtgeschichte über einen Roboter und eine Katze.“

- „Geben Sie mir drei Ideen für das Abendessen mit Hühnchen, Reis und Brokkoli.“

Das Ausführen eines großen lokalen Sprachmodells ist nicht dasselbe wie ein Chat mit CatGPT-5Es wirkt sicherlich simpel und grob. Wenn Sie dies versuchen, denken Sie daran, Ihre Eingabeaufforderungen kurz zu halten, da die Kontextfenster viel eingeschränkter sind als bei der regulären Chatbot-Version. Sie werden merken, dass die Antworten langsamer sind, wenn Sie das lokale große Sprachmodell überladen.

Warum sollten Sie das tun?

- Es fallen keine Abonnementgebühren an. Sie müssen nicht Ihr gesamtes Guthaben aufbrauchen, nur um es zu versuchen.

- Integrierte Privatsphäre. Alles bleibt auf Ihrem Gerät.

- Überraschend vielseitig. Ich war wirklich erstaunt über die Menge an Aufgaben, die die Miniatur bewältigen konnte. Jedes Mal, wenn ich ihre Grenzen austestete, meisterte sie die Herausforderung mit Leichtigkeit.

Das Endergebnis

Wenn Sie ein iPhone 15 oder neuer haben und erkunden möchten, wie KI „von innen“ aussieht, beginnen Sie dort. Es kann sein LLM-Farm Oder MLCChat Schnelle und kostenlose Möglichkeiten zum Einstieg. Wenn Ihnen der Datenschutz wichtig ist, die App Apollo Einen Versuch wert. Wenn Sie gerne experimentieren und individuell anpassen, Privater LLM Ermöglicht Ihnen, tiefer in benutzerdefinierte Einstellungen einzutauchen.

Denken Sie daran, dass dies nicht die leistungsstarken Chatbots sind, die Sie gewohnt sind. Erwarten Sie also keine ChatGPT-ähnlichen Ergebnisse. Aber es ist ziemlich cool und futuristisch, Ihre eigene KI auf Ihrem iPhone auszuführen.

Kommentarfunktion ist geschlossen.