Die Risiken von Enterprise AI: OpenAI-Alternativen und die Institutionen hinter KI-Agenten

Datenschutz-, Compliance- und Vertrauenslücken bei aktuellen KI-Agent-Integrationen

„Warten Sie … senden Sie Ihre Hauptbucheinträge an OpenAI?“

Das war das Erste, was meine Freundin mich fragte, als ich es ihr zeigte. Fühl-Schreiben, eine KI-gestützte Journaling-App, die ich während eines Hackathons in San Francisco entwickelt habe.

Ich zuckte mit den Schultern.

„Es war ein Hackathon zum Thema KI und ich musste schnell etwas bauen.“

Sie hat keinen Moment verpasst:

„Klar. Aber wie kann ich dem vertrauen, was ich aufgebaut habe? Warum hosten Sie nicht Ihr eigenes LLM?“

Das hat mich aufgehalten.

Ich war stolz darauf, wie schnell die App zusammengestellt wurde. Aber diese eine Frage und die darauf folgenden enthüllten alles, was ich über verantwortungsvolles Bauen mit KI zu wissen glaubte. Auch die Hackathon-Jury hat es erwähnt.

In diesem Moment wurde mir bewusst, wie respektlos wir beim Bauen mit KI sind, insbesondere bei Tools, die mit sensiblen Daten umgehen.

Mir ist etwas Größeres klar geworden:

Beim Bauen mit KI sprechen wir nicht genug über Vertrauen.

Ihre Antwort ist mir im Gedächtnis geblieben. Georgia von Minden ist Datenwissenschaftlerin bei der ACLU, wo sie sich intensiv mit Fragen im Zusammenhang mit personenbezogenen Daten im Rechts- und Bürgerrechtskontext beschäftigt. Ich habe ihre Einsichten immer geschätzt, aber dieses Gespräch war anders.

Also bat ich sie, es zu erklären. Was bedeutet Vertrauen in diesem Zusammenhang wirklich? Insbesondere wenn KI-Systeme mit personenbezogenen Daten umgehen.

Sie sagte mir:

Vertrauen aufzubauen kann schwierig sein, aber Datenverwaltung ist ein guter Ausgangspunkt. Wem die Daten gehören, wie sie gespeichert werden und wofür sie verwendet werden, ist wichtig. Vor zehn Jahren hätte ich diese Frage anders beantwortet. Doch heute, mit enormer Rechenleistung und riesigen Datenspeichern, ist breite Schlussfolgerung ein echtes Problem. OpenAI hat einen so umfassenden Zugriff auf Rechenleistung und Daten, dass die mangelnde Transparenz Vorsicht gebietet.

Wenn es um personenbezogene Daten (PII) geht, weisen sowohl Vorschriften als auch der gesunde Menschenverstand auf die Notwendigkeit einer starken Datenverwaltung hin. Das Senden personenbezogener Daten in API-Aufrufen ist nicht nur riskant – es könnte auch gegen diese Regeln verstoßen und Einzelpersonen gefährden.

Es hat mich daran erinnert, dass wir beim Bauen mit KI, insbesondere bei Systemen, die sensible menschliche Daten verarbeiten, nicht nur Code schreiben.

Wir treffen Entscheidungen über Privatsphäre, Autorität und Vertrauen.

Sobald Sie Benutzerdaten sammeln, insbesondere persönliche Daten wie Tagebucheinträge, übernehmen Sie Verantwortung. Es geht nicht nur darum, was Ihr Modell kann. Es geht darum, was mit diesen Daten geschieht, wohin sie gehen und wer darauf Zugriff hat. Der verantwortungsvolle Umgang mit Benutzerdaten erhöht das Vertrauen der Benutzer und verbessert den Datenschutz.

Die Illusion der Einfachheit

Heute ist es einfacher denn je, etwas auf den Markt zu bringen, das schick aussieht. Mit großen Sprachmodellen (LLMs) wie OpenAI und anderen können Entwickler innerhalb weniger Stunden KI-Tools erstellen. Startups können über Nacht „KI-gestützte“ Funktionen auf den Markt bringen. Was ist mit Institutionen? Das Unternehmen beeilt sich, diese Agenten in seinen Arbeitsablauf zu integrieren.

Doch bei all dieser Aufregung wird eines oft übersehen: Vertrauen.

Wenn Leute darüber reden KI-AgentenSie beziehen sich oft auf einfache Wrapper um große Sprachmodelle (LLMs). Diese Agenten können Fragen beantworten, Aufgaben automatisieren oder sogar Entscheidungen treffen. Viele davon werden jedoch hastig gebaut, ohne dass der Sicherheit, der Einhaltung von Vorschriften oder der Verantwortlichkeit große Aufmerksamkeit geschenkt wird.

Verwenden Sie das Produkt nur für OpenAI Das heißt nicht, dass es sicher ist. Worauf Sie wirklich vertrauen, ist die gesamte Pipeline:

- Wer hat das Cover gebaut?

- Wie wird mit Ihren Daten umgegangen?

- Werden Ihre Informationen gespeichert, aufgezeichnet oder, schlimmer noch, weitergegeben?

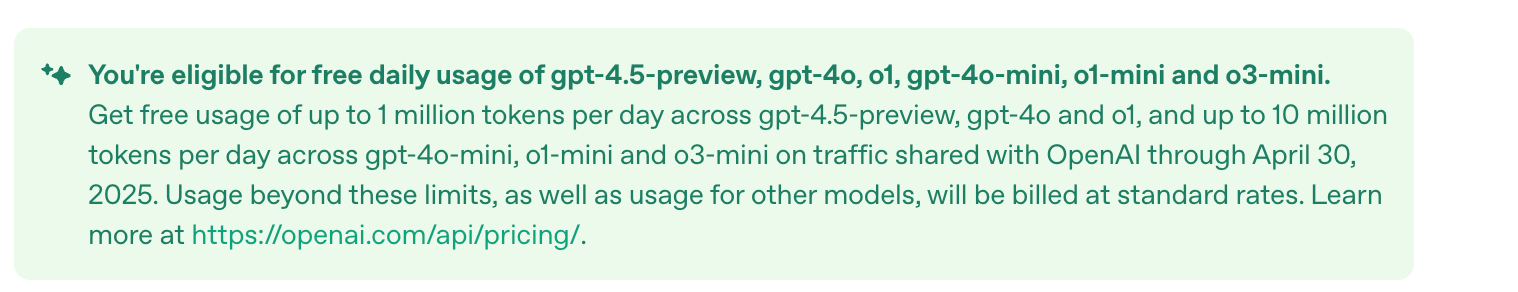

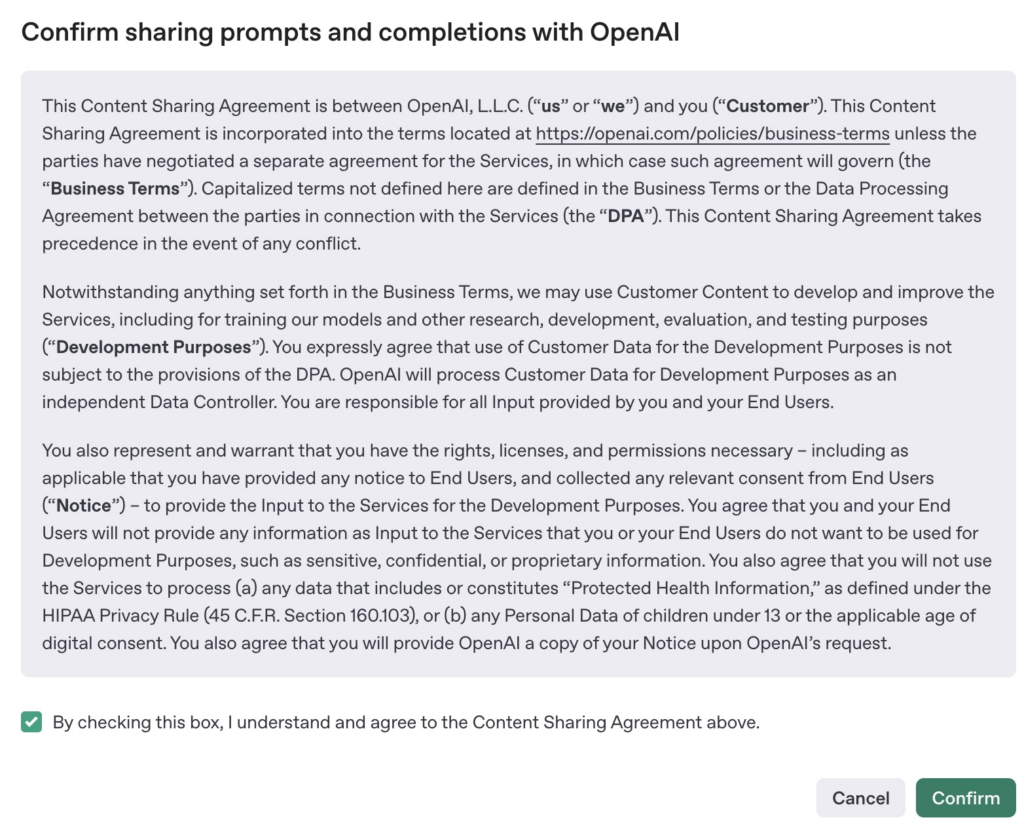

Ich habe die API von OpenAI selbst für Anwendungsfälle bei Kunden verwendet. Kürzlich wurde mir kostenloser Zugang zur API angeboten – bis zu 1 Million Token pro Tag bis Ende April – Wenn ich der Weitergabe meiner Schadensdaten zustimme.

Ich hätte dem beinahe für ein persönliches Nebenprojekt zugestimmt, aber dann fiel mir ein: Wenn ein Lösungsanbieter aus Kostengründen das gleiche Angebot annehmen würde, hätten seine Benutzer keine Ahnung, dass ihre Daten weitergegeben werden. Auf persönlicher Ebene mag dies harmlos erscheinen. Aber im Kontext der Institution? Dies stellt einen schwerwiegenden Verstoß gegen die Privatsphäre und möglicherweise gegen vertragliche oder gesetzliche Verpflichtungen dar.

Es genügt, wenn ein Ingenieur zu einem solchen Deal „Ja“ sagt, und schon sind Ihre Kundendaten in den Händen eines anderen.

Enterprise AI weckt Erwartungen

Ich sehe immer mehr SaaS-Unternehmen und Startups für Entwicklungstools, die mit KI-Agenten experimentieren. Einige erzielen gute Ergebnisse. Manche KI-Agenten ermöglichen es Nutzern, eigene Large Language Models (LLMs) zu verwenden und so die Kontrolle darüber zu behalten, wo das Modell ausgeführt wird und wie die Daten verarbeitet werden. Dies ist ein kluger Ansatz, insbesondere da KI in Unternehmen immer wichtiger wird.

Dies ist der durchdachte Ansatz: Sie legen die Vertrauensgrenzen fest..

Aber nicht jeder ist so begeistert.

Viele Unternehmen stellen einfach eine Verbindung zur API von OpenAI her, fügen einige Schaltflächen hinzu und bezeichnen es als „unternehmensbereit“.

Achtung: Das stimmt nicht.

Was könnte schiefgehen? eine Menge.

Wenn Sie KI-Agenten in Ihre Infrastruktur integrieren, ohne die schwierigen Fragen zu stellen, bestehen folgende potenzielle Risiken:

- DatenleckIhre Ansprüche können vertrauliche Kundendaten, API-Schlüssel oder interne Logik enthalten – und wenn sie über ein Drittanbieterformular übermittelt werden, können diese offengelegt werden.

Im Jahr 2023 fügten Samsung-Ingenieure versehentlich internen Quellcode und Notizen in ChatGPT ein (Forbes). Diese Daten könnten nun Teil zukünftiger Trainingssätze sein – ein erhebliches Risiko für das geistige Eigentum.

- Compliance-VerstößeDas Einreichen personenbezogener Daten (PII) über ein Formular wie OpenAI ohne entsprechende Kontrollen kann einen Verstoß gegen die Datenschutz-Grundverordnung (DSGVO), HIPAA oder Ihre Verträge darstellen.

Das Unternehmen X von Elon Musk musste dies auf die harte Tour lernen. Sie starteten ihren KI-Chatbot „Grok“ und nutzten zum Trainieren alle Benutzerbeiträge, auch von Benutzern aus der EU, ohne über das entsprechende Abonnement zu verfügen. Die Organisatoren griffen schnell ein. Unter Druck stellten sie die Ausbildung von Grok in der Europäischen Union ein (Politisch).

- vage VerhaltenNichtdeterministische Agenten sind schwer zu korrigieren oder zu erklären. Was passiert, wenn ein Kunde fragt, warum ein Chatbot eine falsche Empfehlung abgegeben oder etwas Vertrauliches preisgegeben hat? Um diese Frage zu beantworten, ist Transparenz erforderlich – und diese bieten viele Agenten heutzutage nicht.

- Verwirrung über DateneigentumWem gehört das Produkt? Wer erfasst die Daten? Nimmt der Dienstanbieter an Ihren Eingaben teil?

Zoom wurde 2023 dabei erwischt, genau das zu tun. Sie änderten stillschweigend ihre Servicebedingungen, um die Verwendung von Kundenbesprechungsdaten zum Trainieren von KI zu ermöglichen (Fast Company). Nach einer öffentlichen Gegenreaktion haben sie ihre Politik rückgängig gemacht, doch dies war eine Erinnerung daran, dass Vertrauen über Nacht verloren gehen kann.

- Sicherheitsmängel in der VerpackungIm Jahr 2024 wurden Dutzende von Implementierungen von Flowise – einem beliebten Low-Code-LLM-Orchestrierungstool – im Internet entdeckt, viele davon ohne Authentifizierung (Cybersecurity-Nachrichten). Forscher entdeckten API-Schlüssel, Datenbankanmeldeinformationen und Benutzerdaten im öffentlichen Raum. Dies ist nicht das Problem von OpenAI – dies ist ein Problem. Bauherren. Aber die Endbenutzer zahlen immer noch den Preis.

- KI-Funktionen, die zu weit gehenDie „Recall“-Funktion von Microsoft – Teil der Einführung von Copilot – erfasste automatisch Screenshots der Benutzeraktivitäten, um dem KI-Assistenten bei der Beantwortung von Fragen zu helfen (DoublePulsar). Es schien nützlich … bis Sicherheitsexperten darauf hinwiesen, dass es ein Albtraum für die Privatsphäre sei. Microsoft musste schnell einen Rückzieher machen und die Funktion nur noch optional machen.

Nicht alles braucht OpenAI.

OpenAI ist eine unglaublich leistungsstarke Plattform. Aber es ist nicht immer die beste Lösung.

Manchmal ist ein kleineres lokales Modell völlig ausreichend. In anderen Fällen ist eine regelbasierte Logik die bessere Lösung. Die sicherste Option ist oft eine, die vollständig innerhalb Ihrer eigenen Infrastruktur und gemäß Ihren Regeln ausgeführt wird.

Wir sollten nicht einfach blind ein großes Sprachmodell (LLM) einbinden und es einen „intelligenten Assistenten“ nennen.

In Institutionen, Vertrauen, Transparenz und Kontrolle sind keine optionalen Extras. - Vielmehr ist es unerlässlich.

Es gibt immer mehr Plattformen, die diese Art der Steuerung ermöglichen. Salesforce Einstein 1 Studio unterstützt jetzt die Funktion Bring-dein-eigenes-Modell mit, sodass Sie Ihr großes Sprachmodell (LLM) von AWS oder Azure verbinden können. IBM Watson ermöglicht es Unternehmen, Modelle intern mit vollständigen Prüfpfaden bereitzustellen. Mit MosaicML können Sie mit Databricks private große Sprachmodelle (LLMs) in Ihrer eigenen Cloud trainieren, sodass Ihre vertraulichen Daten Ihre Infrastruktur nie verlassen.

So sollte echte Unternehmens-KI aussehen.

Fazit

KI-Agenten sind unglaublich leistungsstark und ermöglichen Arbeitsabläufe und Automatisierung, die wir vorher nicht erreichen konnten. Eine einfache Entwicklung bedeutet jedoch nicht unbedingt Sicherheit, insbesondere wenn es um die Verarbeitung sensibler Daten in großem Umfang geht.

Bevor Sie mit der Verwendung dieses tollen neuen Mittels beginnen, fragen Sie sich:

- Wer kontrolliert das Modell?

- Wohin gehen die Daten?

- Halten wir die Vorschriften ein?

- Können wir nachsehen, was er macht?

Im Zeitalter der künstlichen Intelligenz ist die größte Bedrohung nicht schlechte Technologie, sondern Blindes Vertrauen.

Über den Autor

Ich bin Ellen, eine Ingenieurin für maschinelles Lernen mit 6 Jahren Erfahrung und arbeite derzeit bei einem Fintech-Startup in San Francisco. Mein Hintergrund umfasst Datenwissenschaftsrollen in der Öl- und Gasberatung sowie die Leitung von KI- und Datenschulungsprogrammen im asiatisch-pazifischen Raum, im Nahen Osten und in Europa.

Ich schließe derzeit meinen Master in Data Science ab (Abschluss im Mai 2025) und suche aktiv nach meiner nächsten Gelegenheit als Machine Learning Engineer. Wenn Sie für eine Empfehlung oder Verbindung offen sind, wäre ich Ihnen wirklich dankbar!

Ich liebe es, mithilfe von KI einen echten Einfluss auf die Welt zu nehmen und bin auch immer offen für projektbasierte Kooperationen.

Kommentarfunktion ist geschlossen.