Was ist Computer Vision und welche Herausforderungen ergeben sich in der Welt selbstfahrender Autos?

Selbstfahrende Autos sind ein kontroverses und faszinierendes Thema, da sie auf fortschrittliche Fahrerassistenzsysteme (ADAS) angewiesen sind, um ein hohes Maß an Sicherheit und Komfort zu erreichen. Obwohl es noch keine vollständig selbstfahrenden Autos gibt, ermöglichen aktuelle Technologien Funktionen wie automatisches Lenken und selbstständiges Einparken.

Diese Autos nutzen fortschrittliche Computer-Vision-Systeme, um ihre Umgebung zu analysieren und intelligente Entscheidungen zu treffen. Dabei stützen sie sich auf eine Vielzahl von Sensoren. In diesem Artikel behandeln wir die Grundlagen der Computervision und wie sie die Effektivität des automatisierten Fahrens verbessert. Außerdem erfahren Sie, welche Herausforderungen und zukünftigen Innovationen in diesem Bereich zu erwarten sind.

Was ist Computer Vision?

Computer Vision ist eine Technologie, die es Maschinen ermöglicht, Objekte in ihrer Umgebung zu sehen und zu erkennen. Es handelt sich um einen Teilbereich der Bildverarbeitung, der sich auf industrielle Anwendungen der visuellen Objekterkennung in autonomen Maschinen wie Robotern und Fahrzeugen konzentriert.

Die heutige Computervision verwendet Deep-Learning-KI-Algorithmen wie Convolutional Neural Networks (CNNs), um robuste, gut verallgemeinerte Modelle zu erstellen, die Objekte unter verschiedenen Bedingungen genau identifizieren können. Es ermöglicht die Implementierung der maschinellen Bildverarbeitung in verschiedenen Aufgaben, die eine höhere Zuverlässigkeit in den Bereichen Fertigung, Landwirtschaft, Robotik und Automobilindustrie erfordern.

Wie funktioniert Computer Vision in selbstfahrenden Autos?

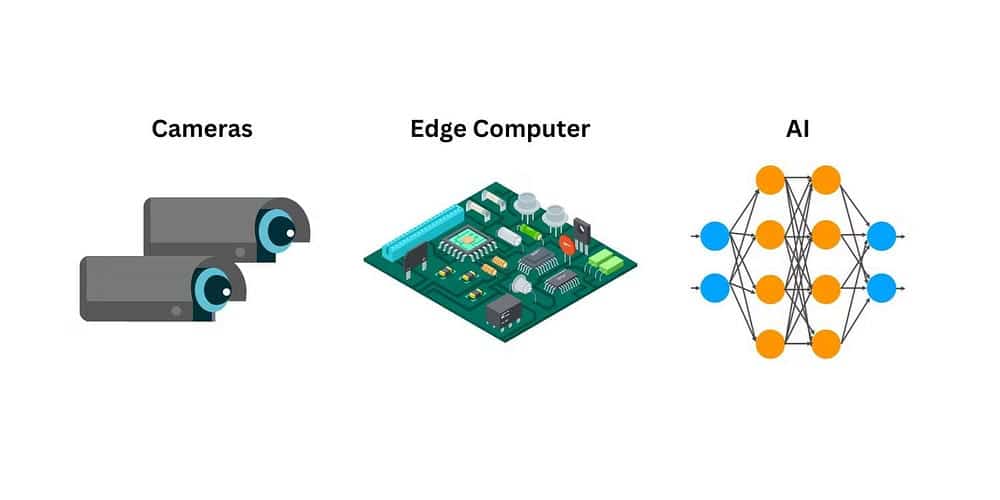

Computer Vision in selbstfahrenden Autos lässt sich grundsätzlich in drei Teile unterteilen: das Kamerasystem, die Verarbeitung (Edge Computing) und die künstliche Intelligenz. Diese Technologie ermöglicht es autonomen Autos, während der Fahrt verschiedene Schilder und Hindernisse zu erkennen, zu berücksichtigen und zu identifizieren. Lassen Sie uns jeden Teil im Detail besprechen, um zu verstehen, wie diese Technologien zusammenwirken, um eine maschinelle Sicht für ein selbstfahrendes Auto zu schaffen.

Kamerasystem

Computer Vision nutzt Kamerasysteme, um visuelle Informationen über die Umgebung zu sammeln. Selbstfahrende Autos verwenden mehrere rund um das Fahrzeug installierte Kameras, um möglichst viele visuelle Informationen zu sammeln.

In Bildverarbeitungskameras werden hauptsächlich zwei Sensoren verwendet: komplementäre Metalloxidhalbleiter (CMOS) und ladungsgekoppelte Bauelemente (CCD). Für selbstfahrende Autos wird die CMOS-Technologie aufgrund ihrer schnellen Auslesegeschwindigkeit, leistungsstarken Elektronik und Parallelverarbeitungsfähigkeiten häufig bevorzugt und ist damit der schnellste Sensor. Lösungen wie verschiedene Beleuchtungsmodi, digitale Nachtsicht und Filter können den CMOS-Sensor bei nicht idealen Lichtverhältnissen unterstützen.

Bei selbstfahrenden Autos werden Kameras in bestimmten Abständen zueinander installiert, um eine stereoskopische Ansicht zu erzeugen. Stereoskopisches Sehen ist die Fähigkeit, zwei oder mehr visuelle Eingaben zu kombinieren und so ein Gefühl von Tiefe oder Dreidimensionalität in Objekten und der Umgebung zu erzeugen. Dies wiederum ermöglicht es Autos, die ungefähre Entfernung zwischen dem Objekt und dem Auto zu triangulieren und zu berechnen.

Da der Mensch zwei Augen hat, profitiert er auch vom stereoskopischen Sehen. Sie können diese Vision selbst testen; Schließen Sie ein Auge und suchen Sie sich einen kleinen Gegenstand von Ihrem Schreibtisch aus. Legen Sie Ihre Hand auf die Seite des Objekts und achten Sie darauf, dass die Spitze des Objekts mindestens fünf Zentimeter entfernt ist. Halten Sie einige Sekunden inne und achten Sie darauf, wie sicher Sie sich bei Ihrer Annäherung fühlen. Versuchen Sie nun, beide Augen zu öffnen und sehen Sie, wie viel besser Ihr Tiefengefühl wird.

Edge-Computing

Beim Edge Computing werden Informationsspeicherung und Rechenleistung näher an das Gerät gebracht, das diese Daten generiert, und an die Benutzer, die mit ihnen interagieren. Traditionell übertrugen Anwendungen Daten von intelligenten Geräten wie Sensoren und Smartphones zur Verarbeitung an ein zentrales Rechenzentrum. Allerdings überstiegen die beispiellose Komplexität und das Datenvolumen die Kapazitäten des Netzwerks. Edge-Computing-Systeme bringen die Verarbeitungskapazitäten näher an Benutzer und Geräte, verbessern die Anwendungsleistung erheblich, reduzieren die Anforderungen an die Netzwerkbandbreite und bieten schnellere Einblicke in Echtzeit.

Während das Kamerasystem im selbstfahrenden Auto Daten sammelt, verarbeitet der Bordcomputer (Edge-Prozessor) alle Eingaben in Echtzeit, um das System umgehend über den Zustand der Umgebung zu informieren. Während bei typischen Computer Vision-Aufgaben durch den Einsatz von Cloud Computing Kosten gespart werden können, birgt die Bindung selbstfahrender Autos an die Cloud einfach zu viele Risiken, selbst wenn dies durch die Auslagerung des Prozesses für die Anforderungen der maschinellen Bildverarbeitung geschieht.

Durch die Verwendung eines hochentwickelten Computers zur Verarbeitung der Eingabedaten werden Latenzprobleme vermieden und sichergestellt, dass die Daten in Echtzeit empfangen, verarbeitet und übertragen werden. Fortschrittliche Computer für selbstfahrende Autos verwenden spezielle Computer, die KI-Grafikprozessoren wie NVIDIAs Tensor Core und CUDA Cores integrieren.

Algorithmen der künstlichen Intelligenz

Algorithmen waren schon immer ein wichtiger Bestandteil der maschinellen Bildverarbeitung. Der Algorithmus ermöglicht es dem Computer, alle vom Kamerasystem bereitgestellten Muster, Formen und Farben zu erkennen. Durch den Einsatz künstlicher Intelligenz anstelle herkömmlicher Computer-Vision-Algorithmen wird die Fähigkeit selbstfahrender Autos, Objekte, Straßenschilder, Fahrbahnmarkierungen und Ampeln zuverlässig zu erkennen, erheblich verbessert. Viele KI-Algorithmen werden zum Trainieren selbstfahrender Autos verwendet. Zu den beliebtesten gehören:

- YOLO (You Only Look Once): Ein Echtzeit-Objekterkennungsalgorithmus, der Objekte im Sichtfeld des Autos identifiziert und verfolgt.

- SIFT (Scale-Icar'sant Feature Conversion): Wird zum Extrahieren von Merkmalen verwendet und hilft dem Auto, markante Orientierungspunkte und Objekte in seiner Umgebung zu erkennen.

- Histogramm gerichteter Gradienten (HOG): Wird zur Objekterkennung verwendet und konzentriert sich auf das Extrahieren lokaler Muster und Verläufe aus Bildern.

- TextonBoost: Ein Algorithmus, der bei der Identifizierung von Objekten hilft, indem er Texturen in der Umgebung analysiert.

- AdaBoost: AdaBoost wird zur Klassifizierung von Daten verwendet und kombiniert mehrere schwache Klassifikatoren, um fundierte Entscheidungen über Objekte und Hindernisse auf dem Weg eines Fahrzeugs zu treffen.

Die Bedeutung der Computervision in selbstfahrenden Autos

Computer Vision ist die wichtigste Methode, mit der ein selbstfahrendes Auto seine Umgebung wahrnimmt und versteht. Ohne maschinelles Sehen werden selbstfahrende Autos auf der Skala der Fahrzeugautonomie wahrscheinlich auf Stufe 1 zurückgestuft und erreichen möglicherweise nie die volle Autonomie.

Dank maschineller Bildverarbeitung sind selbstfahrende Autos heute in der Lage, Objekte zu klassifizieren, Fahrspuren und Signale zu erkennen, Schilder zu identifizieren und den Verkehr zu erkennen.

Obwohl viele selbstfahrende Autos mittlerweile verschiedene Sensoren wie LIDAR, RADAR und SONAR verwenden, sind sie alle stark auf Computer Vision angewiesen, um die Umgebung zu sehen, Objekte zu identifizieren und die Bedeutung von Verkehrszeichen und Verkehrssignalen zu verstehen. Alle diese zusätzlichen Sensoren dienen ausschließlich dazu, die maschinelle Sicht zu verbessern und die Sicherheit von Menschen, Tieren und Eigentum zu erhöhen.

Allerdings kann die maschinelle Bildverarbeitung autonom ohne die Unterstützung anderer Sensoren arbeiten und so automatische Steuerungsfunktionen bereitstellen. Tatsächlich haben die neuesten selbstfahrenden Autos von Tesla das Radarsystem über Bord geworfen und verlassen sich nun ausschließlich auf die maschinelle Bildverarbeitung ihres Autopilot-Systems.

Dies stellt zwar nicht unbedingt die Nützlichkeit anderer Sensortechnologien in Frage, zeigt aber die Bedeutung und Leistungsfähigkeit der Computervision in selbstfahrenden Autos.

häufige Fragen

Frage 1. Was ist Computer-Vision-Technologie? In selbstfahrenden Autos?

Bei der Computer-Vision-Technologie handelt es sich um ein hardware- und softwarebasiertes System, das Bilder und Videos analysiert und interpretiert, damit selbstfahrende Autos ihre Umgebung erkennen und während der Fahrt Entscheidungen treffen können.

Frage 2. So funktioniert Computer Vision-Technologie In Autos?

Das Auto ist mit mehreren Kameras und Sensoren ausgestattet, die Bilder und Videos aus der Umgebung erfassen. Diese Daten werden mithilfe fortschrittlicher Software verarbeitet, um Bilder zu analysieren und verschiedene Objekte und Orientierungspunkte auf der Straße zu erkennen.

Frage 3. Welche Bedeutung hat die Computer-Vision-Technologie? Beim autonomen Fahren?

Computer-Vision-Technologie ist für das autonome Fahren von entscheidender Bedeutung, da sie das Erkennen von Verkehrszeichen, anderen Fahrzeugen und Hindernissen auf der Straße ermöglicht. Diese Live-Informationen bilden die Grundlage für automatisierte Entscheidungen, einschließlich der Fahrzeuglenkung und Unfallvermeidung.

Q4. Vor welchen Herausforderungen steht die Bildverarbeitungstechnologie?

Zu den Herausforderungen für die Computer-Vision-Technologie zählen Faktoren wie widrige Wetterbedingungen wie Nebel und Regen, Schwierigkeiten beim Erkennen von Objekten in völliger Dunkelheit sowie Datenschutz und Privatsphäre.

F5. Welche zukünftigen Entwicklungen sind in diesem Bereich zu erwarten?

Es wird erwartet, dass sich die Computer-Vision-Technologie weiterentwickelt und bessere Anwendungen künstlicher Intelligenz sowie verbesserte Sensor- und Bilderkennungsfunktionen bietet. Darüber hinaus ist eine Ausweitung des Einsatzes dieser Technologie auf andere Bereiche als den Automobilbereich möglich.

Die Zukunft der Bildverarbeitung in selbstfahrenden Autos

Computer Vision ist die Grundlage selbstfahrender Autos. Mithilfe von maschinellem Sehen können Autos ihre Umgebung genauso sehen und wahrnehmen wie Menschen. Obwohl weiterhin Herausforderungen bestehen, dürfen die Vorteile der Computervision hinsichtlich Sicherheit und Navigation nicht unterschätzt werden. Was die Zukunft selbstfahrender Fahrzeuge angeht, werden alle weiteren Fortschritte in den Bereichen künstliche Intelligenz, Edge Computing und/oder Kameratechnologie selbstfahrende Autos effizienter machen und sie wahrscheinlich auf ein höheres Automatisierungsniveau bringen.

Kommentarfunktion ist geschlossen.