So installieren Sie die neuesten großen Sprachmodelle (LLMs) lokal auf einem Mac

In den letzten Jahren haben große Sprachmodelle (LLMs) aufgrund ihrer Fähigkeit, menschenähnliche Texte zu generieren und bei verschiedenen Aufgaben zu helfen, zunehmend an Popularität gewonnen. Nicht alle Modelle sind Open Source, aber nahezu jedes große Technologieunternehmen bietet eine Version zum Herunterladen und Ausführen an.

Die lokale Ausführung dieser Modelle auf Ihrem Mac kann sowohl aus Datenschutz- als auch aus Kostengründen vorteilhaft sein. In diesem Artikel erfahren Sie, wie Sie LLMs installieren und ausführen. OllamaEs ist ein leistungsstarkes Werkzeug für Entwickler und unerfahrene Benutzer, und wir werden einige grafische Benutzeroberflächen-Tools besprechen, die den Prozess für diejenigen vereinfachen können, die das macOS-Terminal nicht verwenden möchten.

Auf diese Weise erhalten Sie Zugriff auf die neuesten KI-gestützten Textvorlagen von [Google], [Microsoft], [Meta] und anderen KI-Unternehmen wie [Mistral] und [DeepSeek].

LLMs verstehen: Was bedeuten die Parameter?

Bevor wir uns mit dem Installationsprozess befassen, klären wir zunächst, was Zahlen wie „7B"Oder"14 MrdBei LLMs geben diese Zahlen die Modellgröße in Bezug auf die Lehrer (In Milliarden), die im Wesentlichen „Griffe und Schalter“ sind, die während des Trainings präzise eingestellt werden.

Eine größere Anzahl an Parametern ermöglicht es dem Modell, komplexere Muster und Zusammenhänge in der Sprache zu erfassen, was potenziell zu einer besseren Leistung führt. Es ist jedoch wichtig zu beachten, dass mehr Parameter nicht immer bessere Ergebnisse garantieren; die Qualität der Trainingsdaten und die dem Modell zur Verfügung stehenden Rechenressourcen spielen ebenfalls eine wichtige Rolle.

System Anforderungen

Sie müssen sicherstellen, dass Ihr [Mac] mindestens die folgenden Spezifikationen aufweist:

- macOS 10.15 oder neuer (macOS 13 oder neuer empfohlen)

- Mindestens 8 GB RAM (16 GB oder mehr empfohlen)

- 10 GB freier Speicherplatz (das Minimum, das für die kleinsten Modelle erforderlich ist; fortgeschrittenere Modelle mit einer maximalen Anzahl von Parametern benötigen etwa 700 GB).

- [Intel] Mehrkernprozessor oder [Apple Silicon] Prozessor (M2 oder höher bevorzugt)

Installieren Sie Ollama

Ollama Es handelt sich um ein Open-Source-Tool, mit dem Sie LLMs direkt auf Ihrem lokalen Rechner ausführen können. So gehen Sie vor:

- Ollama herunterladen: Besuchen Sie die Website Ollama Laden Sie die macOS-Version herunter. Alternativ können Sie sie auch mit [Homebrew] installieren, indem Sie folgenden Befehl ausführen:

brew install ollamaIn Ihrem Terminal.

- Installieren Sie OllamaWenn Sie die Installationsdatei heruntergeladen haben, doppelklicken Sie darauf und folgen Sie dem Installationsassistenten. Wenn Sie Homebrew verwenden, fahren Sie mit Schritt 4 fort.

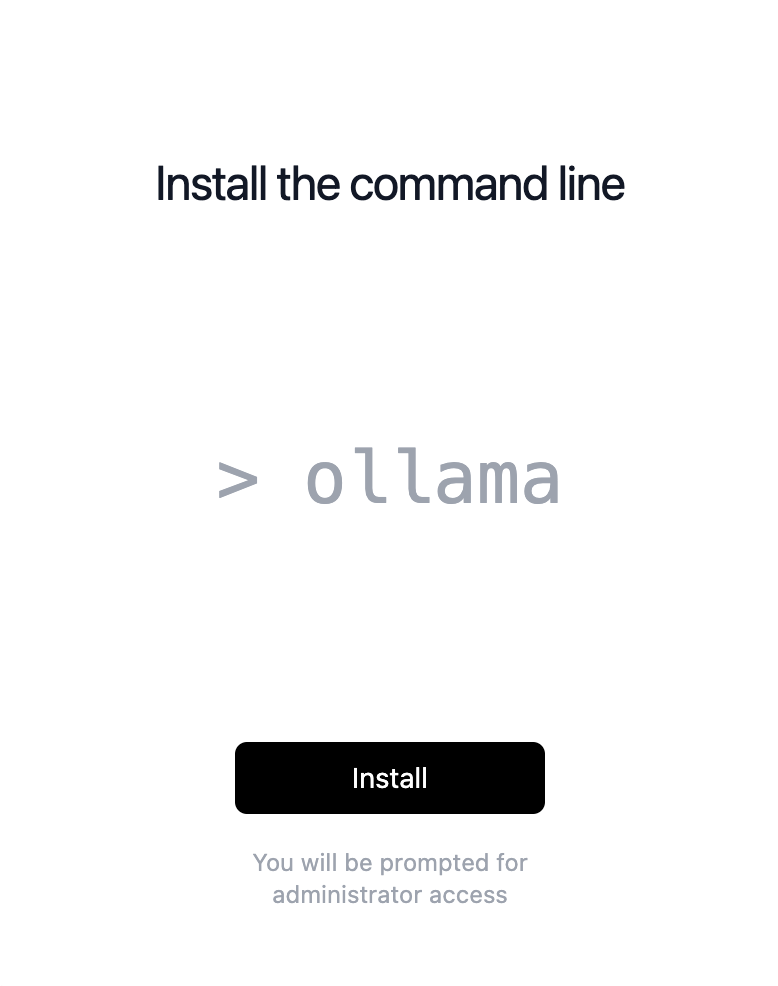

- Der nächste Schritt für den Installateur ist einfach: Er muss nur noch auf die Schaltfläche klicken. تثبيتSie werden dann nach Ihrem Administratorpasswort gefragt.

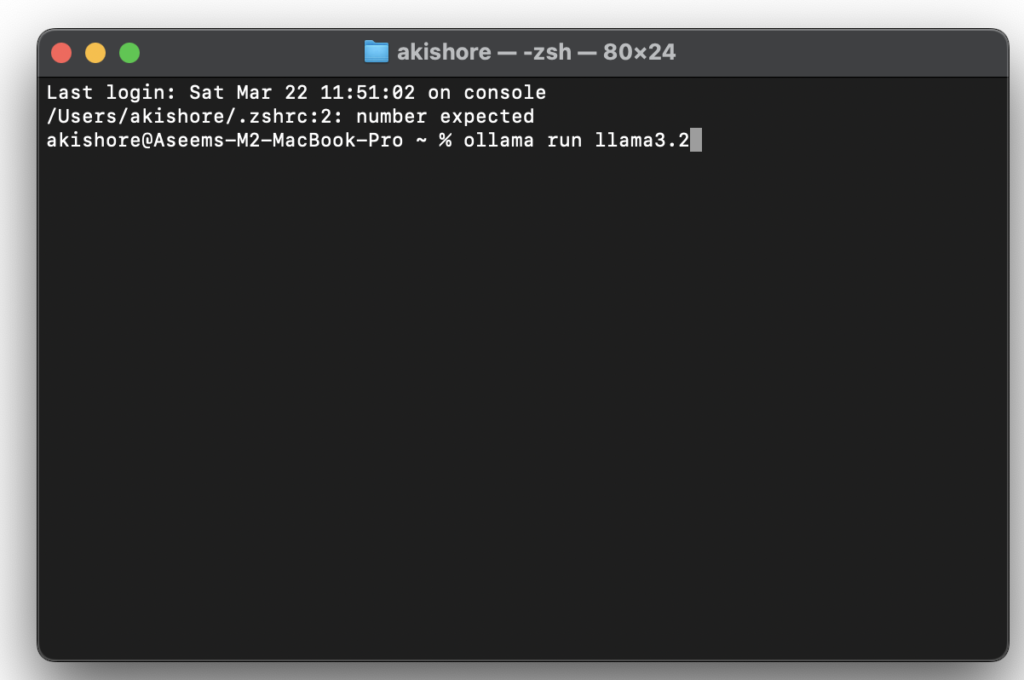

- Lauf OllamaÖffnen Sie ein Terminalfenster und starten Sie Ollama als Dienst mit dem Befehl

brew services start ollamaDadurch wird Ollama unter der Adresse verfügbar sein.http://localhost:11434/. - Laden Sie das Modell herunter und führen Sie es aus.Verwenden Sie den Befehl

ollama pull <model-name>Um eine Vorlage herunterzuladen, dann der Befehlollama run <model-name>Um es auszuführen. Zum Beispiel, um ein Modell auszuführen DeepSeek-R1, benutze den Befehlollama pull deepseek-r1Im Anschluss daran folgte die Bestellungollama run deepseek-r1. - Um eine größere Version der Vorlage herunterzuladen, fügen Sie einfach zwei vertikale Punkte gefolgt von der gewünschten Größe hinzu. Beispiel: Um eine Vorlage herunterzuladen 14 Milliarden DeepSeekSie werden den Befehl verwenden ollama laufe Deepseek-r1:14bAuf der Ollama-Website können Sie auf eines der Formulare klicken, und Ihnen werden alle verschiedenen Befehle für jede Version angezeigt.

Die vollständige Liste finden Sie hier: Ollama-Modelle Hier. Sie können auch den zweiten Befehl wie oben beschrieben verwenden. Falls dieser noch nicht installiert ist, wird er zuerst das Formular abrufen und anschließend ausführen.

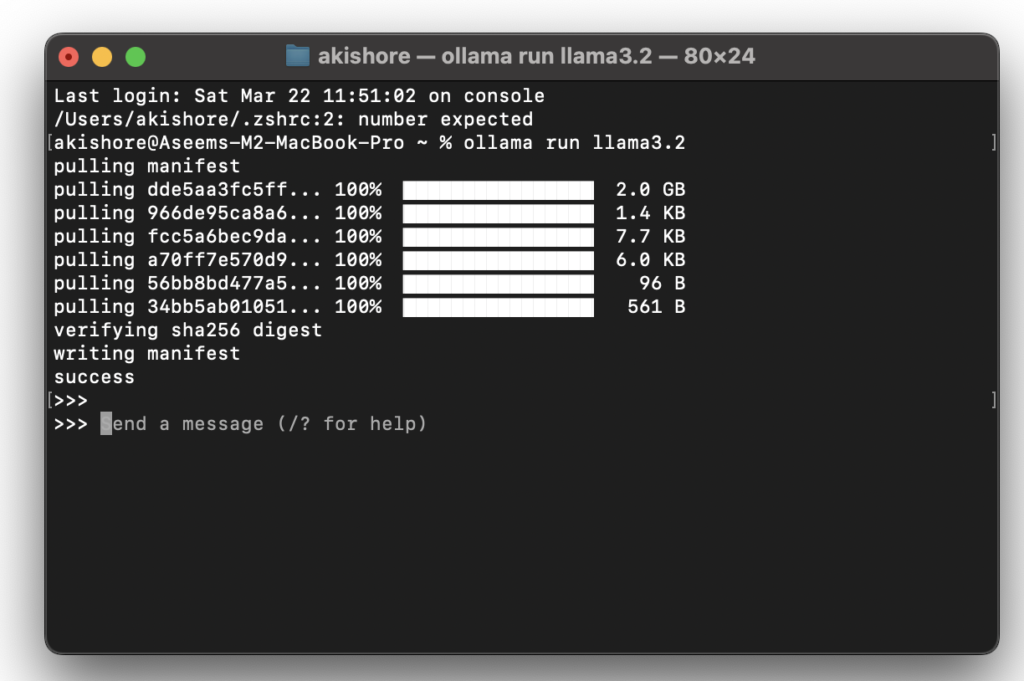

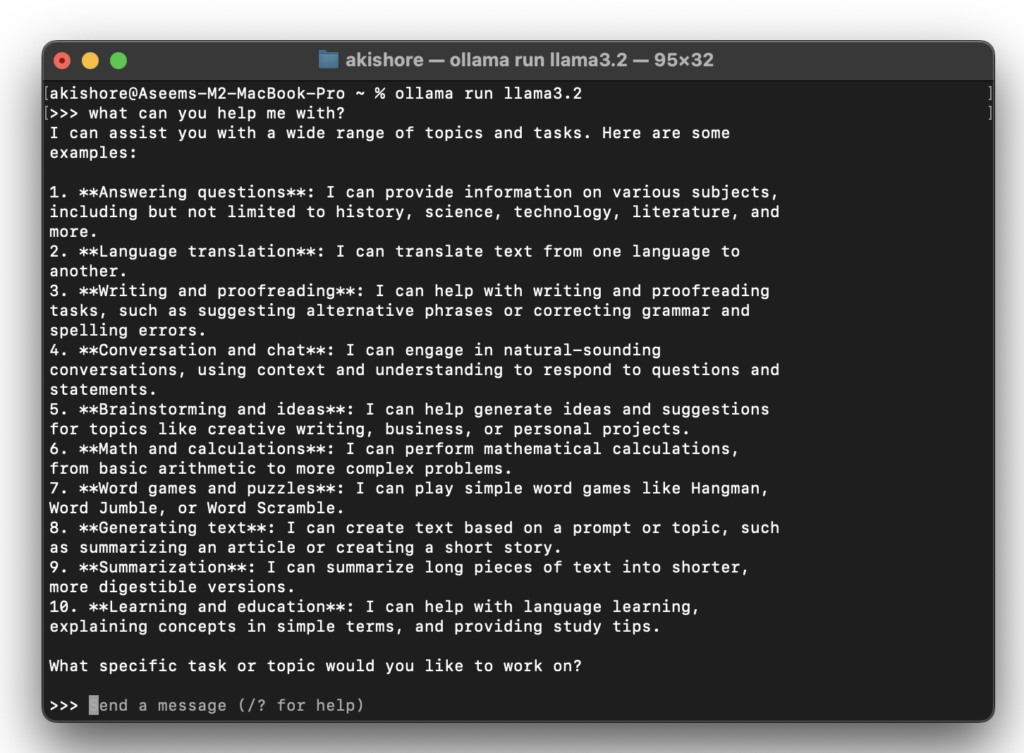

Nachdem Sie nun die drei rechtwinkligen Pfeile (>>>) gesehen haben, können Sie mit der Eingabe von Befehlen in das Formular beginnen.

Das war's! Sie können jetzt lokal mit Ihrem KI-gestützten LLM interagieren, ohne sich Gedanken über Kosten, übermäßige Nutzung oder die Möglichkeit für Dritte machen zu müssen, Ihre Nachrichten zu lesen. Das ist ideal, wenn Sie sensible oder persönliche Themen mit einem KI-gestützten LLM besprechen möchten, aber nicht möchten, dass ein großer Technologiekonzern Ihre Gedanken mitliest.

Verwendung von grafischen Benutzeroberflächen-Tools mit Ollama

Ollama ist zwar leistungsstark und effizient für Entwickler, doch manche Benutzer bevorzugen eine grafische Benutzeroberfläche (GUI) zur Interaktion mit LLMs. Hier sind einige Tools, die eine GUI-Oberfläche für Ollama bereitstellen können:

-

-

- Ollama GUIDies ist eine kostenlose Open-Source-Anwendung für macOS-Nutzer, die mit SwiftUI entwickelt wurde. Sie bietet eine ansprechende Benutzeroberfläche und ist eine hervorragende Option für alle, die lokal auf LLM-Formulare zugreifen möchten, ohne ein Terminal zu verwenden.

- Ollama-BenutzeroberflächeEine einfache, HTML-basierte Web-Benutzeroberfläche, mit der Sie Formulare direkt im Browser definieren und bearbeiten können. Zudem ist eine Chrome-Erweiterung für den einfachen Zugriff verfügbar.

- Chatbox-KIDies ist die einfachste Option für Anfänger, und ich erkläre die Anwendung weiter unten. Beachten Sie, dass Sie den Chatbox AI-Dienst nicht benötigen. Dieser ist ein Abonnement, mit dem Sie auf alle LLM-Vorlagen zugreifen können, ohne Ollama selbst installieren zu müssen.

-

Um die beste Chatbox-KI-Oberfläche zu nutzen, gehen Sie zu Download-Seite Laden Sie die Version für Ihren Mac herunter.

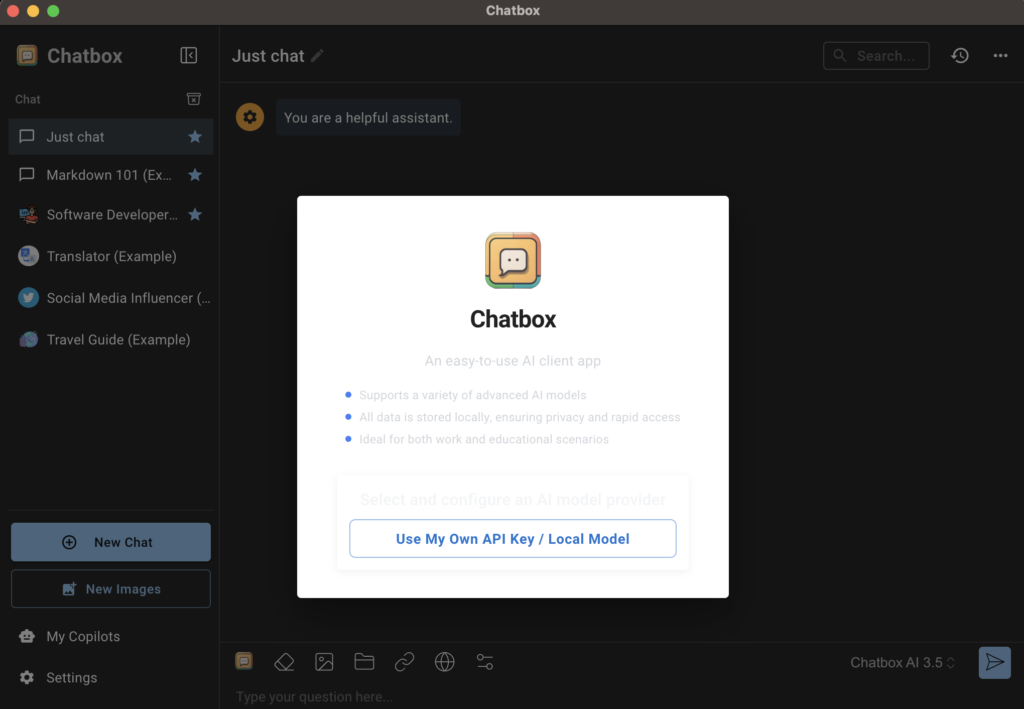

Öffnen Sie anschließend das Installationsprogramm und starten Sie das Programm. Auf dem ersten Bildschirm erscheint ein Popup-Fenster mit Anweisungen zur Verwendung von Chatbox AI.

Sie müssen auf die Schaltfläche klicken. Eigenen API-Schlüssel verwenden / Lokales Modell.

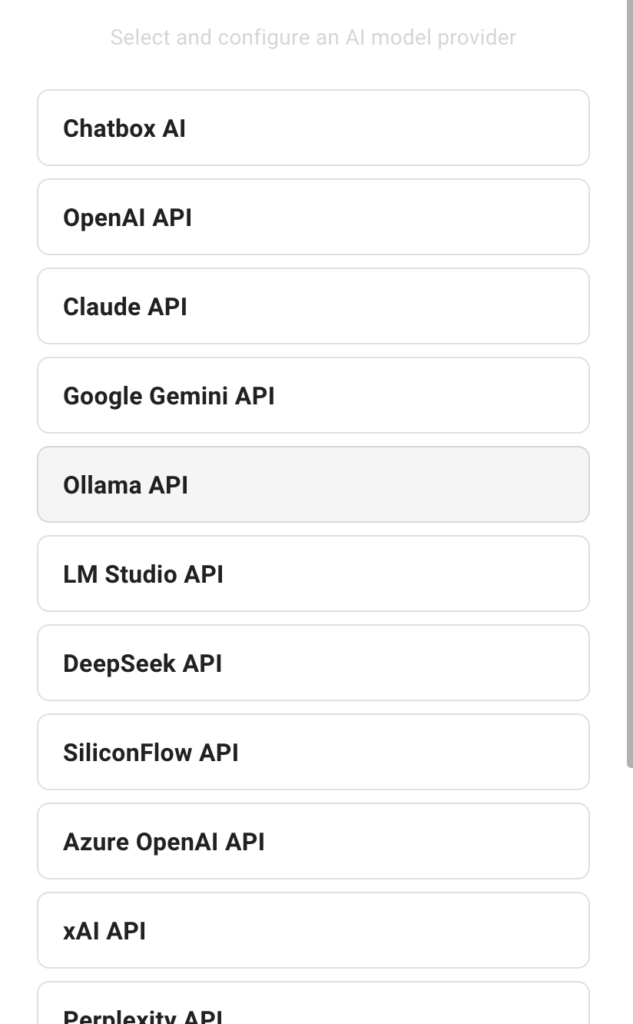

Tippen Sie als Nächstes auf Ollama-API Als Anbieter von Modellen künstlicher Intelligenz.

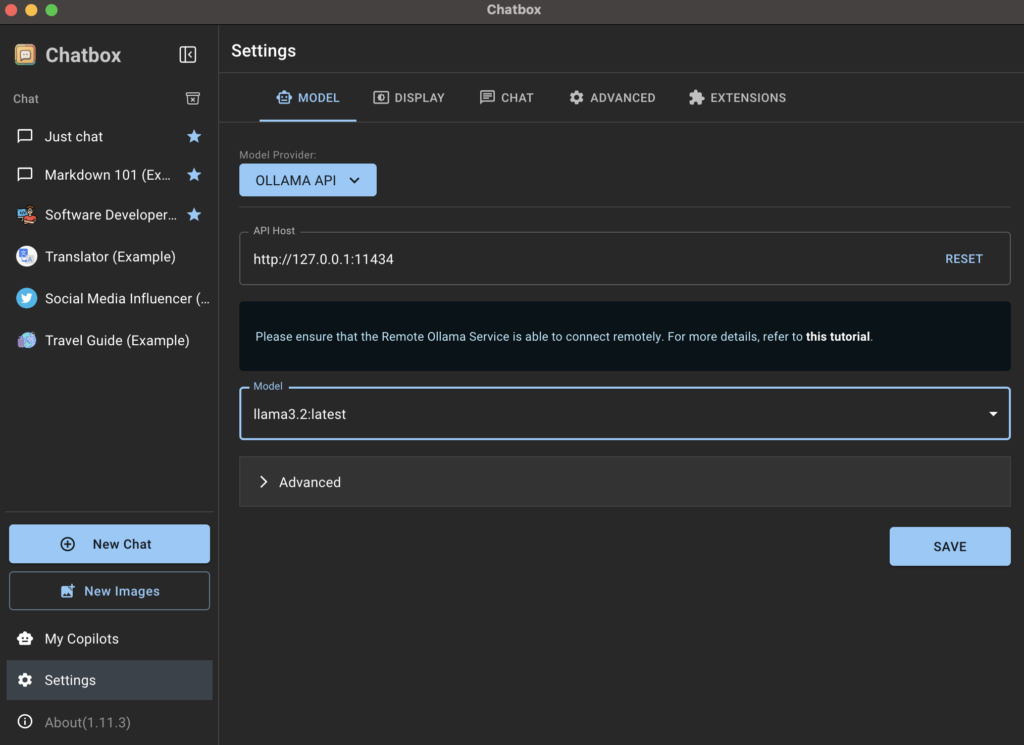

Chatbox AI sollte automatisch erkennen, dass Ollama läuft, und den API-Host auf seinen Standardwert setzen. Loopback-IP-Adresse und Portnummer 11434Sie müssen hier nichts ändern. Innerhalb des Formulars sollten Sie die Formulare sehen, die Sie zuvor über das Terminal installiert haben. In meinem Fall ist es das Formular Lama 3.2.

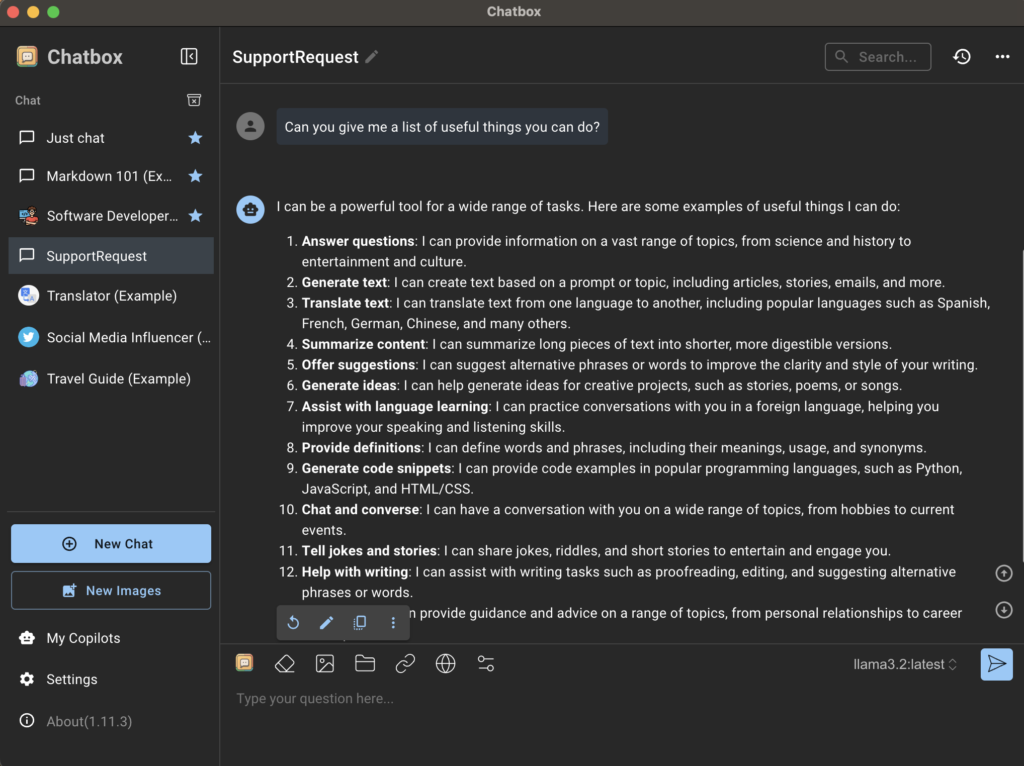

Um zur Startseite der App zurückzukehren, klicken Sie auf Einfach chatten Oder Neuer Chat Achten Sie darauf, unten rechts die richtige Vorlage auszuwählen. Sie können die Vorlage jederzeit ändern, ich empfehle Ihnen jedoch, für jede verwendete Vorlage einen neuen Chat zu erstellen, damit Sie die Unterschiede leichter erkennen können.

Alternative Werkzeuge zum lokalen Ausführen von LLM-Modellen

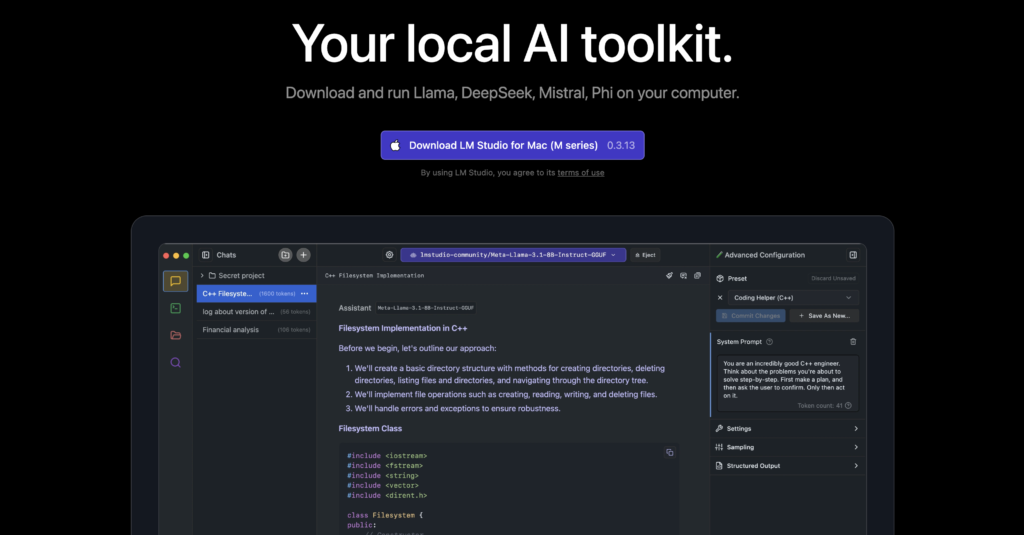

Wenn Sie nach Alternativen zu Ollama suchen oder von Anfang an eine benutzerfreundlichere Erfahrung bevorzugen, dann LM Studio Es ist eine weitere hervorragende Option. Die benutzerfreundliche Oberfläche ermöglicht das Erkunden und Verwenden verschiedener KI-Modelle, die Sie einfach herunterladen und ausführen können. LM Studio ist für Linux, Mac und Windows verfügbar und bietet Funktionen wie die Anpassung von Modellparametern und des Chatverlaufs. Es ist derzeit kostenlos, weshalb ich es dem Abonnementdienst Chatbox AI vorziehe.

Fazit

Die lokale Ausführung großer Sprachmodelle (LLMs) auf Ihrem Mac ist wichtig für alle, die mehr Kontrolle über ihre KI-Anwendungen erlangen und dem Datenschutz Priorität einräumen möchten. Mit Tools wie Ollama und den bereits erwähnten grafischen Benutzeroberflächen, die die Integration von LLMs in Ihren Workflow vereinfachen, können Sie sicher neue Produktivitäts- und Kreativitätspotenziale erschließen.

Für die Einrichtung einer lokalen LLM-Umgebung ist jedoch ein gewisses Verständnis der Parameter und ihrer Auswirkungen auf die Leistung der Modelle auf Ihrem spezifischen System erforderlich. Am besten lernen Sie dies, indem Sie mit verschiedenen Modellen experimentieren und herausfinden, welche die besten Ergebnisse liefern. Sobald Sie dieses Konzept verstanden haben, können Sie fundiertere Entscheidungen darüber treffen, welche Modelle Sie verwenden und wie Sie deren Leistung an Ihre spezifischen Bedürfnisse anpassen.

Kommentare sind geschlossen.