So installieren und verwenden Sie Ollama zum Ausführen großer Sprachmodelle (LLMs) auf Ihrem Windows 11-Computer

Es gibt mehrere Möglichkeiten, große Sprachmodelle (LLMs) lokal auf Ihrem Windows-Computer auszuführen, und Ollama ist eine der einfachsten und effizientesten.

Die häufigste Interaktion, die die meisten von uns derzeit mit KI haben, erfolgt über Cloud-basierte Tools wie ChatGPT Oder CopilotFür die Nutzung dieser Tools ist eine Internetverbindung erforderlich, der Nachteil besteht jedoch darin, dass sie auf fast jedem Gerät verwendet werden können.

Doch nicht jeder möchte bei KI-Anwendungen auf die Cloud setzen, insbesondere Entwickler. Daher sollte Ihr Large Language Model (LLM) lokal auf Ihrem Gerät laufen. Hier kommt Ollama ins Spiel.

Ollama ist ein Inferenztool, mit dem Sie eine Vielzahl von Large Language Models (LLMs) nativ auf Ihrem Computer ausführen können. Dies ist zwar nicht die einzige Möglichkeit, aber eine der einfachsten und unkompliziertesten. Mit Ollama können Sie die Leistungsfähigkeit von KI nutzen, ohne ständig mit dem Internet verbunden zu sein, und haben so die volle Kontrolle über Ihre Daten und Ihre Privatsphäre.

Sobald Sie Ollama und die verwendeten Large Language Models (LLMs) installiert haben, können Sie viel damit anfangen. Der erste Schritt ist jedoch die Einrichtung. Wir führen Sie Schritt für Schritt durch diesen Prozess, damit Sie das Beste aus diesem leistungsstarken Tool herausholen können.

Ollama Systemanforderungen

Die Ausführung von Ollama selbst verbraucht nicht viele Systemressourcen und kann auf einer Vielzahl von Geräten ausgeführt werden. Es ist kompatibel mit Windows 11, macOS und Linux. Sie können es sogar von Ihren Linux-Distributionen innerhalb von Windows 11 über WSL verwenden.

Die Ausführung großer Sprachmodelle (LLMs) erfordert jedoch leistungsfähigere Hardware. Je größer das Modell, desto mehr Rechenleistung wird benötigt. Diese Modelle benötigen einen Grafikprozessor (GPU). Derzeit sind sie nicht für die neuronale Verarbeitungseinheit (NPU) der neuen Copilot+-PCs optimiert.

Glücklicherweise gibt es kleine Modelle, die Sie auf einfacher Hardware verwenden können. Beispielsweise verfügt Googles Gemma 3-Modell über ein Modell mit einer Milliarde Parametern, das nur 1 GB VRAM benötigt, um das gesamte Modell auszuführen. Diese Zahl erhöht sich auf über 2.3 GB VRAM, wenn Sie auf das Modell mit vier Milliarden Parametern umsteigen.

Ähnlich verhält es sich mit Metas Llama 3.2. Hier benötigt das 1-Milliarden-Parameter-Modell eine GPU mit nur 4 GB VRAM, um erfolgreich ausgeführt zu werden. Für das 8-Milliarden-Parameter-Modell erhöht sich dieser Wert dann auf 3 GB.

Kurz gesagt: Wenn Sie einen relativ modernen Computer mit mindestens 8 GB RAM und einer dedizierten GPU haben, sollten Sie von der Verwendung von Ollama einige Vorteile haben.

Ollama-Installationshandbuch unter Windows 11

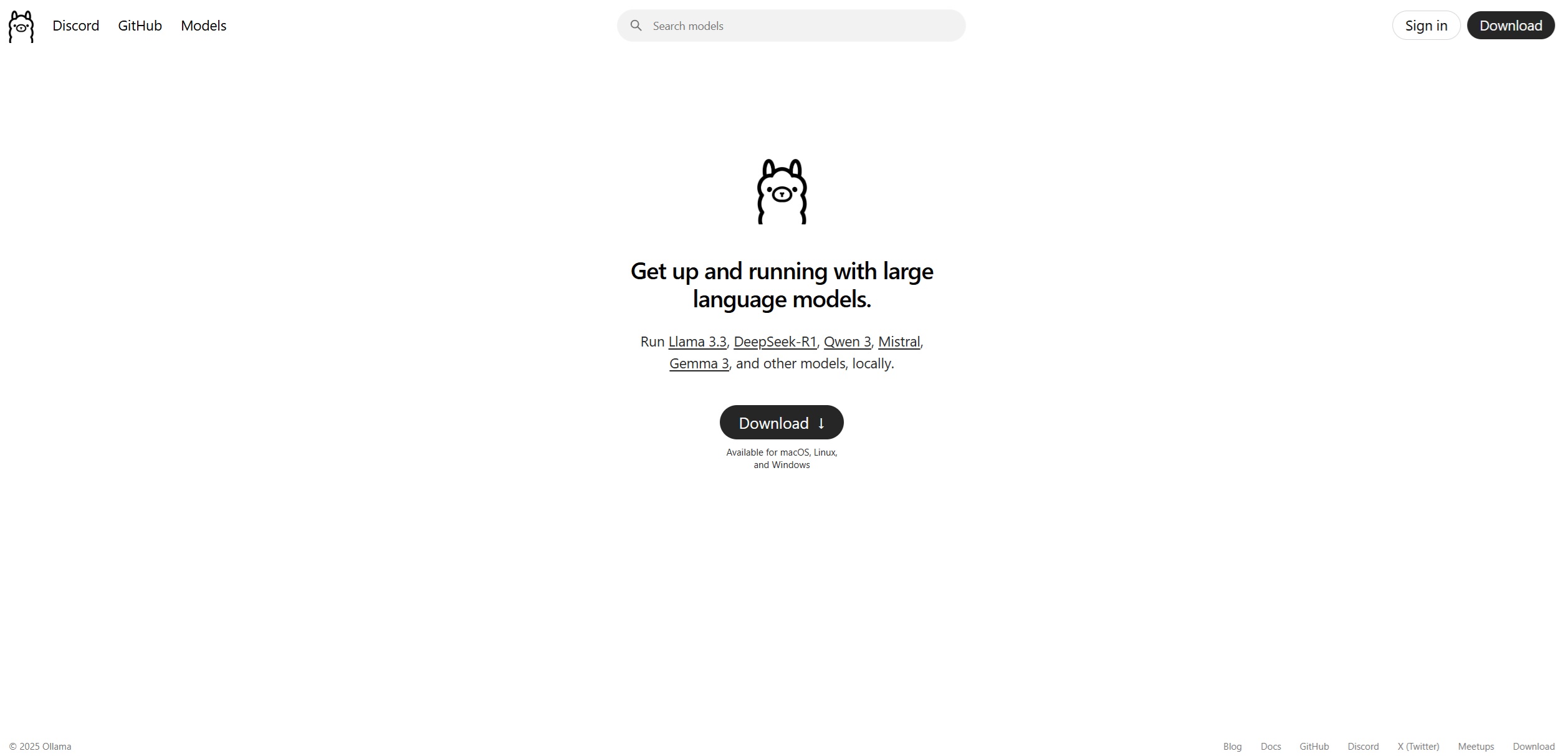

Die Installation von Ollama unter Windows 11 ist ein sehr einfacher Vorgang, der im Download zusammengefasst ist Installieren Sie das Programm von der offiziellen Website Oder von GitHub-Repository, und installieren Sie es dann auf Ihrem Gerät.

Dies sind die einfachen Schritte.

Nach der Installation und dem Start wird auf Ihrem Desktop nichts angezeigt. Das Programm läuft vollständig im Hintergrund, Sie können das Symbol jedoch in der Taskleiste sehen.

Um zu überprüfen, ob das Programm ordnungsgemäß funktioniert, können Sie die Adresse aufrufen localhost: 11434 in Ihrem Webbrowser.

Installieren und führen Sie Ihr erstes großes Sprachmodell (LLM) auf Ollama aus

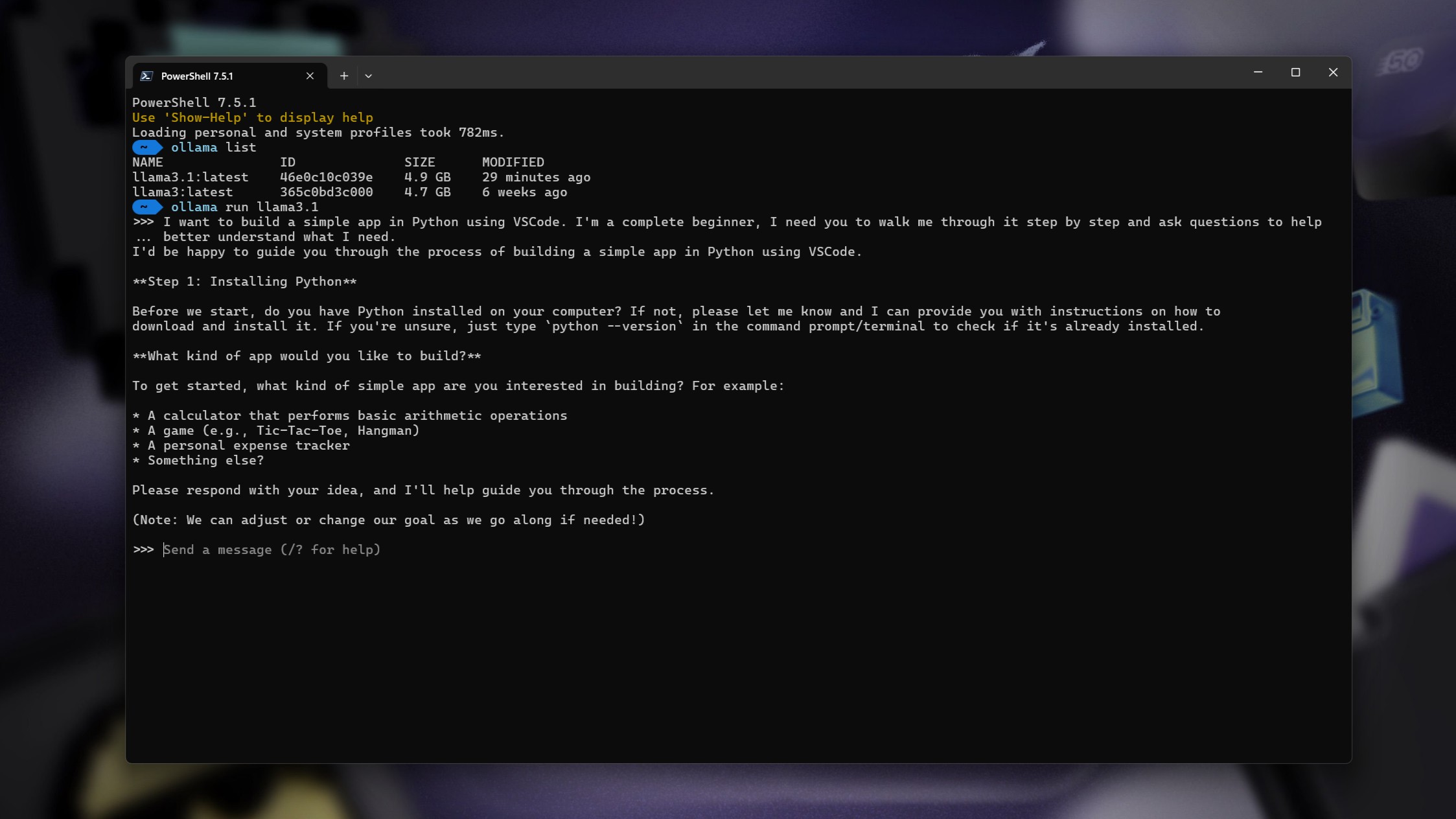

Um Ihr erstes großes Sprachmodell (LLM) mit Ollama auszuführen, benötigen Sie in erster Linie die Befehlszeilenschnittstelle (CLI). Öffnen Sie PowerShell unter Windows oder verwenden Sie WSL, wenn Ollama dort installiert ist.

Obwohl es grafische Benutzeroberflächen (GUIs) für Ollama gibt, konzentrieren wir uns hier auf die Verwendung der Befehlszeile. Es ist hilfreich, wenn Sie mit der CLI vertraut sind.

Die zwei wichtigsten Dinge, die Sie wissen müssen, sind:

Ollama-Lauf

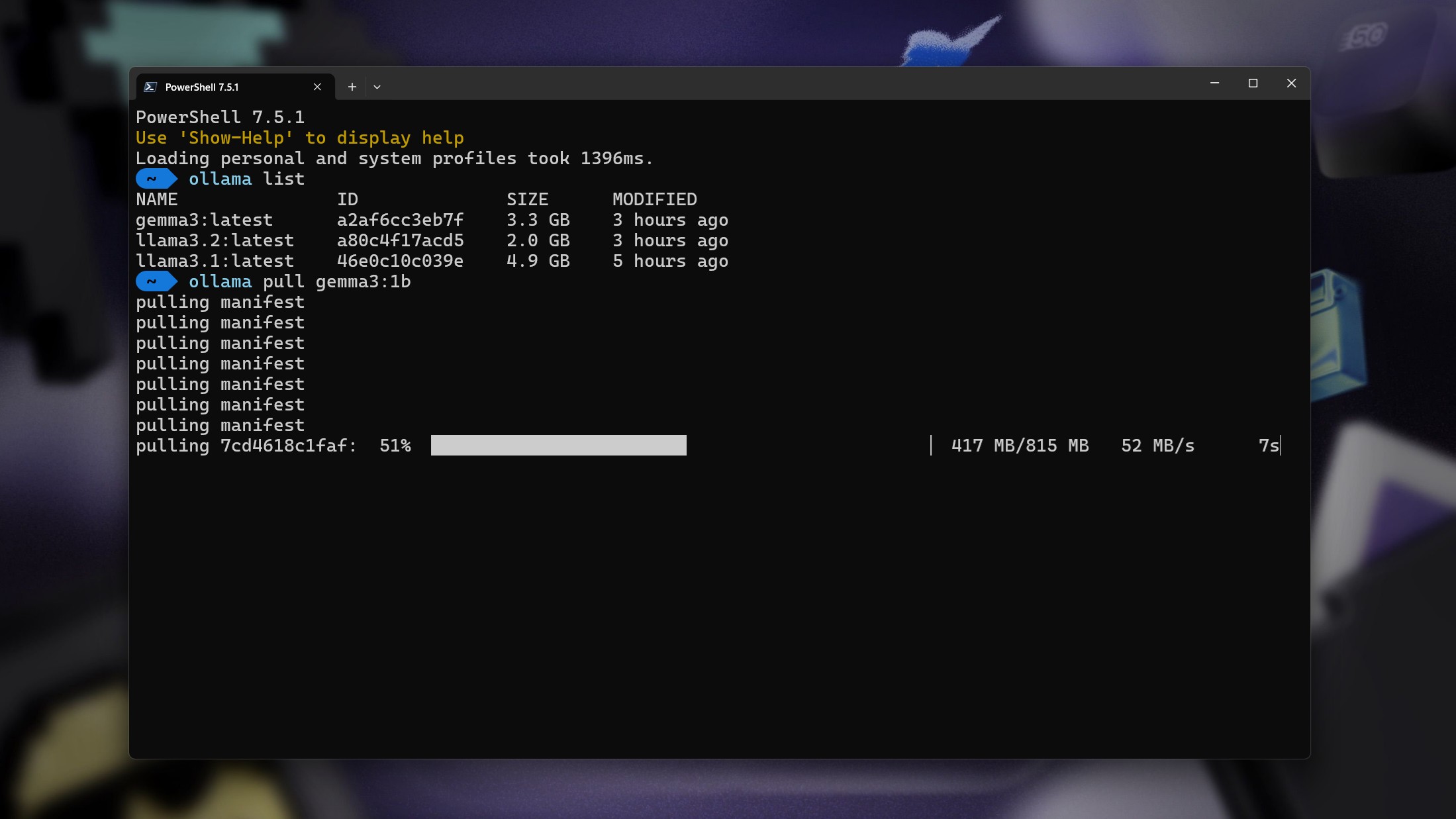

lege es

Wenn Sie Ollama bitten, ein LLM-Modell auszuführen, das derzeit nicht installiert ist, wird es automatisch zuerst heruntergeladen und dann ausgeführt. Die korrekten Namen der großen Sprachmodelle, die Sie installieren möchten, finden Sie ganz einfach unter Ollama Website.

Um beispielsweise das Google Gemma 3 LLM-Modell mit 1 Milliarde Parametern zu installieren und auszuführen, geben Sie den folgenden Befehl ein:

ollama run Gemma:1b

Beachten Sie, dass das Hinzufügen :1b Geben Sie nach dem Namen an, dass Sie das 1-Milliarden-Parameter-Modell wünschen. Wenn Sie das 4-Milliarden-Parameter-Modell wünschen, ändern Sie es in **:4b**.

Wenn Sie Formulare auf Ihrem Terminal ausführen, wird eine vertraute Chatbot-Erfahrung eröffnet, bei der Sie Ihre Eingaben schreiben und Antworten erhalten können, alles lokal auf Ihrem Gerät.

Um das Formular zu verlassen und zu PowerShell zurückzukehren, geben Sie einfach **/bye** ein und der Vorgang wird beendet.

Dies umfasst die grundlegenden Schritte zur Einrichtung von Ollama auf Ihrem Computer, um die verfügbaren LLMs zu nutzen. Die grundlegende Bedienung ist sehr einfach und benutzerfreundlich und erfordert praktisch keine technischen Kenntnisse. Wenn ich es kann, können Sie es auch!

Kommentare sind geschlossen.