Wie plant NVIDIA die Generierung von Frames über Definitionen?

Wichtige Punkte

- NVIDIA und AMD verbessern das Spielerlebnis durch die Frame-Generation-Technologie, die zusätzliche Frames für ein flüssigeres Gameplay erzeugt. NVIDIA nutzt komplexe, hardwarespezifische Methoden, während AMDs einfachere AFMF-Technologie auf Treiberebene arbeitet und somit ohne Eingriff der Spieleentwickler auskommt.

- Es ist unklar, ob NVIDIA eine Frame-Generierungstechnologie auf Basis von Betriebsparametern wie AMDs AFMF einführen wird. Die aktuelle Technologie von NVIDIA setzt stark auf neuere GPUs und kombiniert mehrere Methoden für eine bessere Qualität, was auf eine mögliche Zurückhaltung gegenüber Strategieänderungen hindeutet.

- Beide Methoden verbessern die Bildwiederholrate, können aber visuelle Fehler oder Verzögerungen verursachen. AMDs AFMF-Technologie ist flexibler, aber möglicherweise weniger präzise, während NVIDIAs Ansatz die Qualität priorisiert und sich mit neuen GPU-Generationen weiterentwickeln kann.

Mittlerweile haben wir wohl alle schon von dem neuen Schlagwort in der Gaming-Welt gehört, das von NVIDIA und AMD geprägt wurde:Frame-Generierung„(Frame-Generierung). Diese Technologie, die von Kritikern wie Befürwortern gleichermaßen als die Zukunft des Gamings bezeichnet wird, bedarf noch einiger Verbesserungen, bevor sie zur Lösung werden kann.“Ideal„Um Ihre Leistung zu steigern.“

Mit der AFMF-Technologie von AMD, die einen neuen Standard für ein einfaches Frame-Generierungstool auf Basis von „Druck und BetriebWird NVIDIA also dem Beispiel von AMD folgen und eine universelle Lösung zur Frame-Generierung auf Basis von Betriebsdefinitionen implementieren? Finden wir es heraus.

Wird NVIDIA eine Lösung zur Frame-Generierung auf Basis von Betriebsdefinitionen entwickeln?

Bevor wir zum Hauptthema kommen, wollen wir uns ansehen, wie Upscaling- und Frame-Generierungstechniken funktionieren und einige wichtige Begriffe klären, die es zu verstehen gilt.

Technik DLSS Es ist eine Abkürzung für Deep Learning Super Sampling Es wurde 2017 von NVIDIA eingeführt. 2018 Als Teil der Grafikprozessor-Serie (GPU) RTX-ErweiterungVereinfacht gesagt, scannt und sammelt DLSS Daten aus vorherigen Bildern und verwendet diese Daten, um fehlende Pixel im neuen Bild zu ergänzen. Mit einem Hauch von AISie erhalten ein verbessertes (hochskaliertes) Bild mit Verbesserte Leistung.

Im Gegensatz dazu kann Technologie FSR Von AMD oder Fidelity FX Superauflösung Es funktioniert auf praktisch jedem Grafikprozessor. Es verwendet einen proprietären räumlichen Upscaling-Algorithmus. Open Source Die Erhöhung der Spielauflösung von einer niedrigeren auf eine höhere Auflösung ist wesentlich praktischer als DLSS, da sie nicht hardwareabhängig ist.

Einige wichtige Begriffe und eine Einführung in die Frame-Generierung

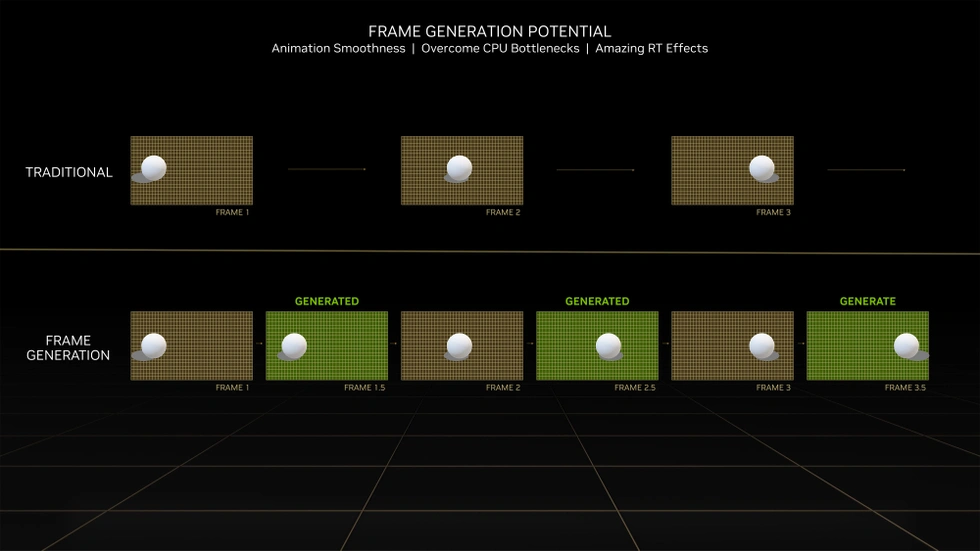

Mit der RTX 40-Serie kam die Technologie an. DLSS-3.0 وNVIDIA Frame GenerationWas genau versteht man unter „Frame-Generierung“? Frame-Generierung ist im einfachsten Fall das Einfügen eines Frames zwischen zwei andere Frames. Dieser Vorgang wird als Frame-Generierung bezeichnet. InterpolationDies war eine gängige Technik bei Fernsehgeräten, um die Bildwiederholfrequenz der angezeigten Inhalte an die Bildwiederholfrequenz des Fernsehers anzupassen.

Upscaling verbessert die Bildqualität und erhöht die Leistung. Frame-Generierung (FG) hingegen erzeugt ein komplett neues Bild zwischen zwei bestehenden Bildern, rendert diese und berechnet das nächste Bild – und das alles bei akzeptabler Reaktionszeit.

Diese fortschrittliche Technologie erfordert Verständnis Zwei Konzepte Wichtige Akteure in diesem Bereich: Optische Flussanalyse وBewegungsvektorenSchauen wir sie uns nacheinander an:

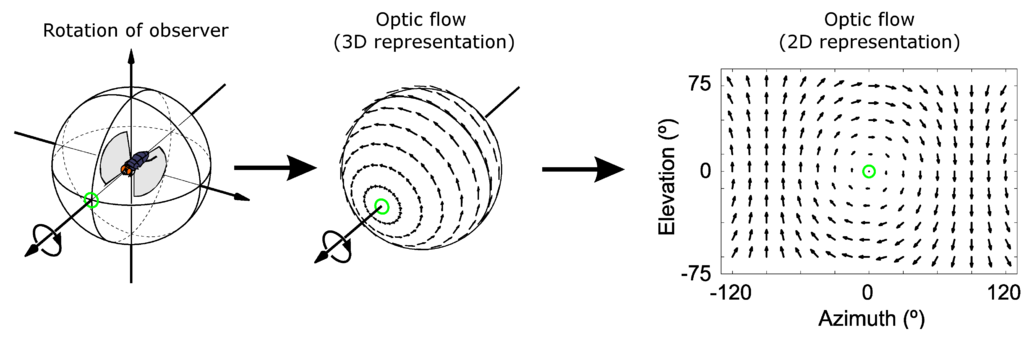

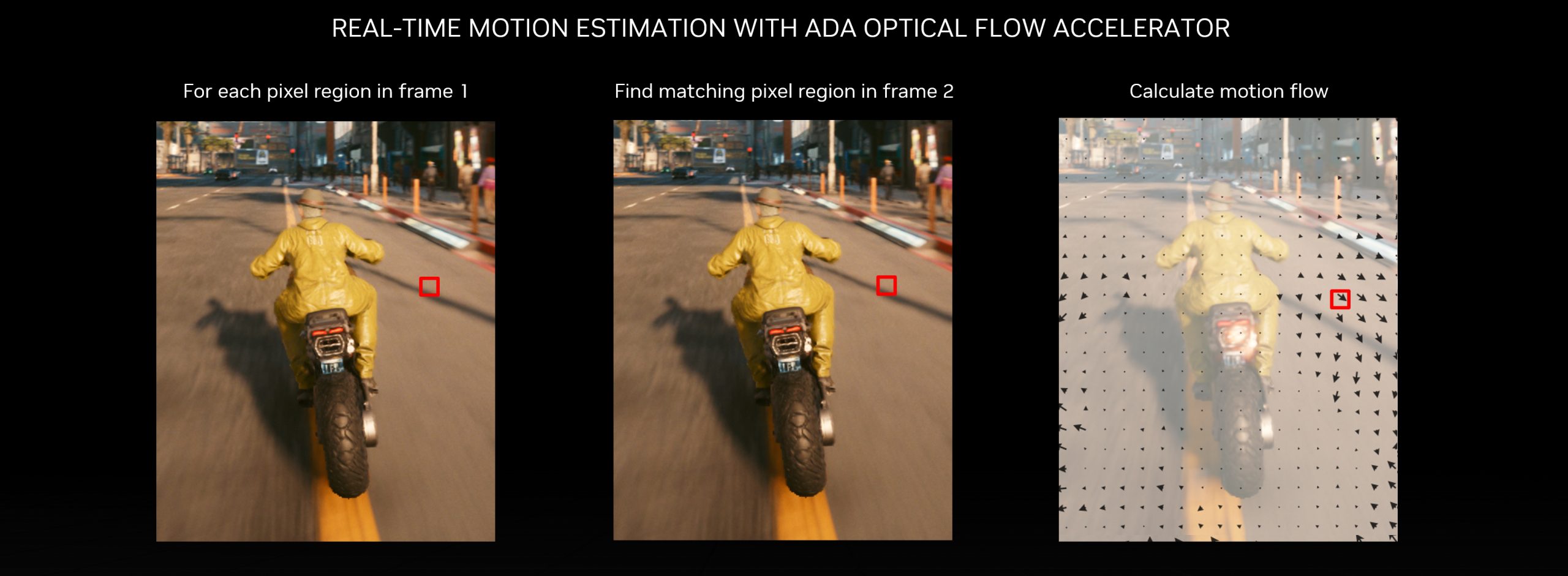

1) Optische Flussanalyse

Dieses Verfahren nimmt eine Reihe von Bildern und schätzt, wie die nächste Version des Bildes aussehen wird. Diese Schätzung erfolgt durch Analyse. Geschwindigkeit, Farbe, Helligkeit Die Objekte im Bild. Anstatt eines klaren und spezifischen Ergebnisses erhält man nur eine grobe Schätzung.

Stellen wir uns einen Ball vor, der auf dem Boden nach rechts rollt. Der Ball erreicht sein Ziel in 5 Einzelne Schritte. Unter der Annahme, dass die Bewegung quasi-linear und geradlinig verläuft, lässt sich das Endziel vorhersagen. Wenn Sie studiert haben Analytische GeometrieSie sind sicherlich schon einmal auf das Doppelpunktformat gestoßen:

y - y1 = (x-x1)(y2-y1) / (x2-x1)Aus nur zwei Punkten lässt sich die Gleichung der gegebenen Geraden bestimmen. Da die Steigung konstant ist, lässt sich die nächste Position des Bildes/Punktes relativ einfach vorhersagen. Die tatsächliche Methode ist jedoch wesentlich komplexer.

Am wichtigsten ist die Analyse des optischen Flusses. لا يتطلب Zugriff auf Spiel-Engine-Daten. Dies kann angewendet werden auf FahrerebeneDie Treibersoftware interpoliert (fügt ein) Frames ein, indem sie die Bewegung auf dem Bildschirm vorhersagt. Vereinfacht gesagt: Die visuelle Flussanalyse interagiert nicht mit der Spiel-Engine.

Der Nachteil besteht darin, dass der Fahrer nicht unterscheiden kann zwischen Benutzeroberfläche (UI) und die Umwelt 3D Da die Originaldaten verwendet werden, können unerwartete Verzerrungen auftreten. Außerdem wird das Ergebnis nie nachbearbeitet, da es mit Rohdaten arbeitet.

2) Bewegungsvektoren in der Spiel-Engine

Bewegungsvektoren sind Richtungsvektoren, die anzeigen إزاحة Objekte bewegen sich von Frame zu Frame. Sie sind ein grundlegender Bestandteil der Spiel-Engine und repräsentieren die Transformation und Bewegung von Objekten. Dies ist eine deutlich effektivere Methode, Bewegung darzustellen, als die Position eines Objekts einfach nur zu „erraten“.

Falls Sie sich fragen: Bewegungsvektoren sind ein wesentlicher Bestandteil der Frame-Generierung. Diese Daten erfordern jedoch Kompatibilität zwischen Treiber und Spiel-Engine. Um diese Kompatibilität zu erreichen, ist eine Implementierung durch die Spieleentwickler notwendig.

Daher sind Bewegungsvektoren zwar der optischen Flussanalyse überlegen, aber in Umfang und Skalierbarkeit sehr begrenzt, und diese Funktion wird nicht in jedem Spiel verfügbar sein. Wenn Sie einen älteren Titel spielen, ... 2010er JahreEs ist sehr wahrscheinlich, dass die Lösungen nicht Reifengeneration (FG) Unterstützt durch Bewegungsvektoren (wie DLSS FG und FSR 3 FG) sind vorhanden.

Vergleich zwischen DLSS-Framegenerierung und FSR-Framegenerierung

Nun wollen wir sehen, wie die aktuellen Frame-Generation-Technologien von Team Grün und Team Rot im Vergleich abschneiden.

↪ NVIDIA:

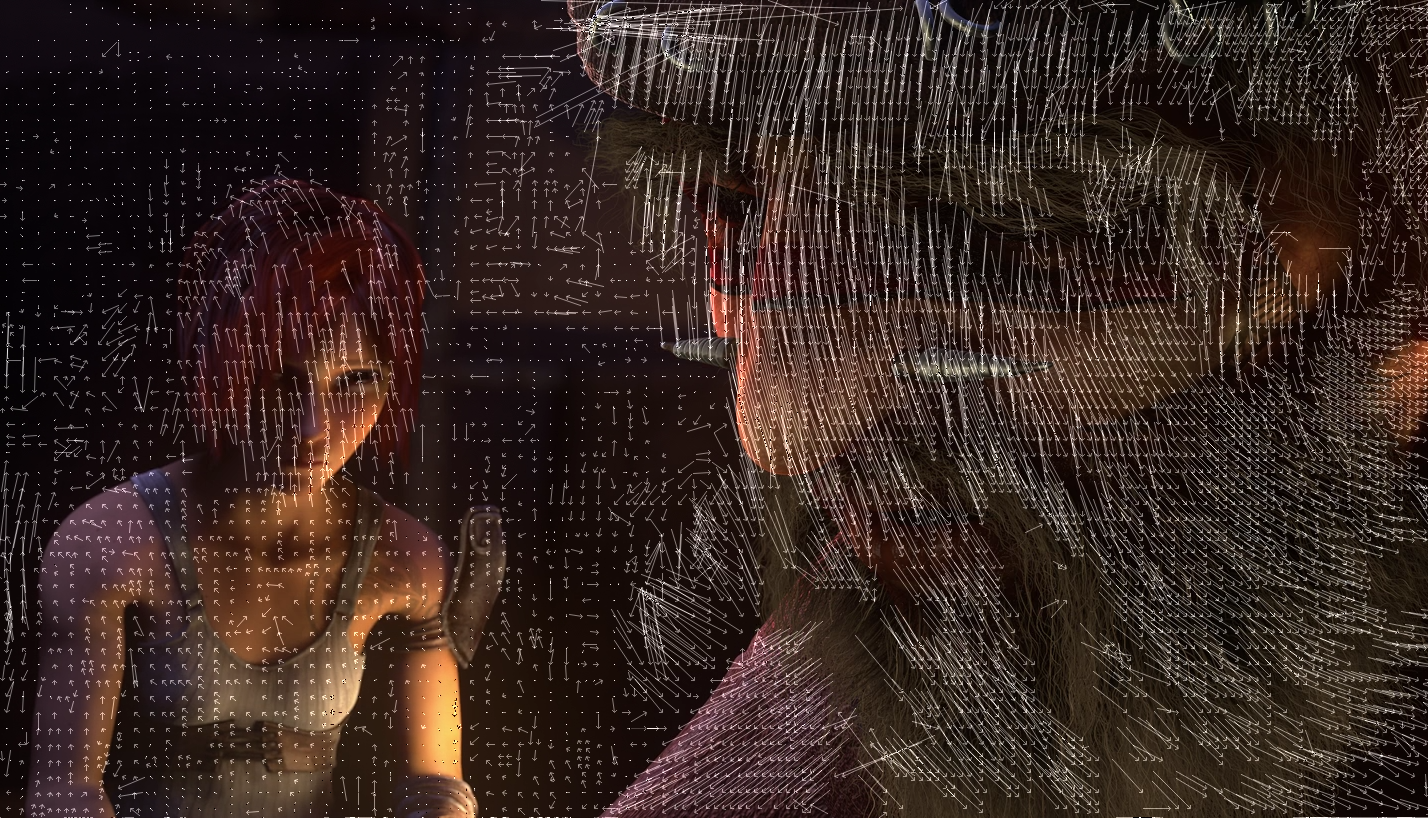

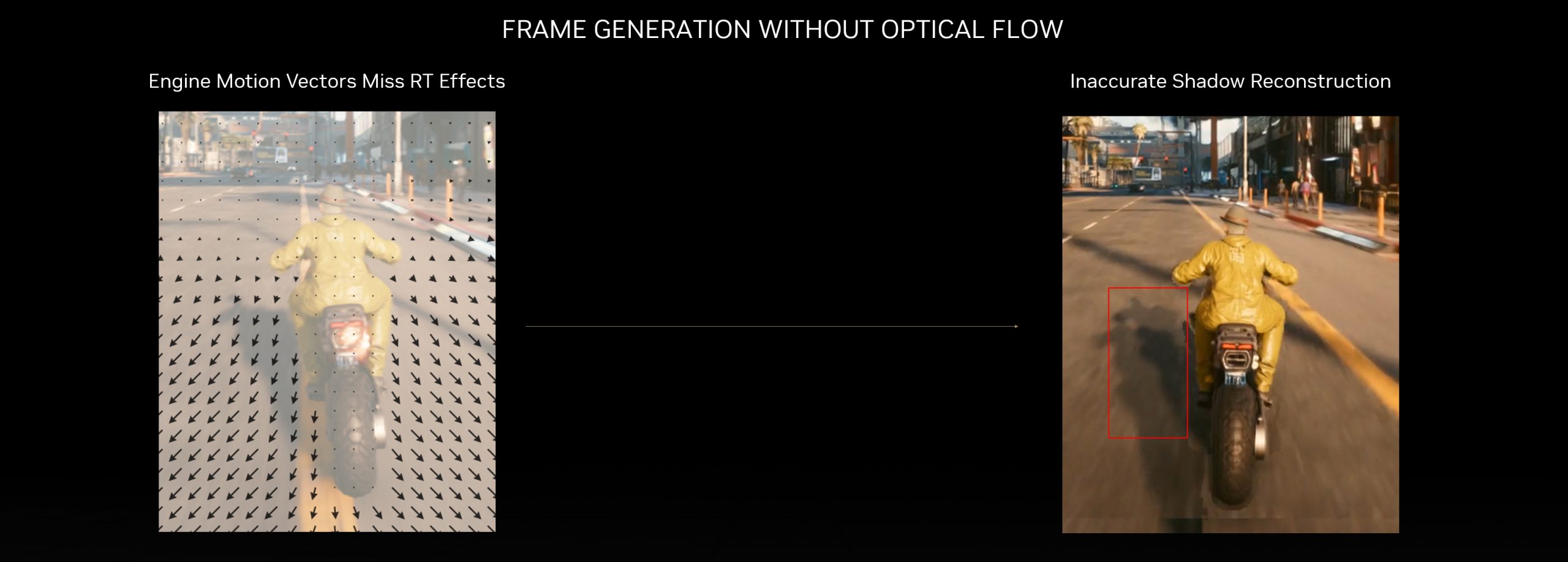

Die Version der Frame-Generierung von NVIDIA verwendet eine Kombination aus Bewegungsvektoren und optischer Flussanalyse. Optischer Flussbeschleuniger Bei RTX-40-GPUs werden zwei Frames analysiert. Dabei werden Informationen identifiziert, die nicht in den Bewegungsvektoren des Spiels enthalten sind, wie beispielsweise Partikel, Reflexionen, Schatten usw. Im folgenden Beispiel ermöglicht die optische Flussanalyse eine präzise Schattenverfolgung.

Im Gegensatz dazu sind Teilspuren Bewegungsvektor Die dreidimensionale Umgebung und die Szenengeometrie. Im Beispiel mit dem Fahrrad können Bewegungsvektoren mathematisch die genaue zukünftige Position des Radfahrers oder der Straße bestimmen. Sie können jedoch den Schatten nicht bestimmen, der aber das Ziel der optischen Flussanalyse ist. Daher müssen beide zusammenwirken, um ein präzises Bild zu erzeugen.

- Benötigt Entwicklerunterstützung die Spiele

- يستخدم mischen من Optische Flussanalyse وBewegungsvektoren

- eingeschränkt mit Hardware Auf Grafikprozessoren RTX 40

- Nicht möglich Implementierung auf Fahrerprogramm-Ebene

↪ AMD:

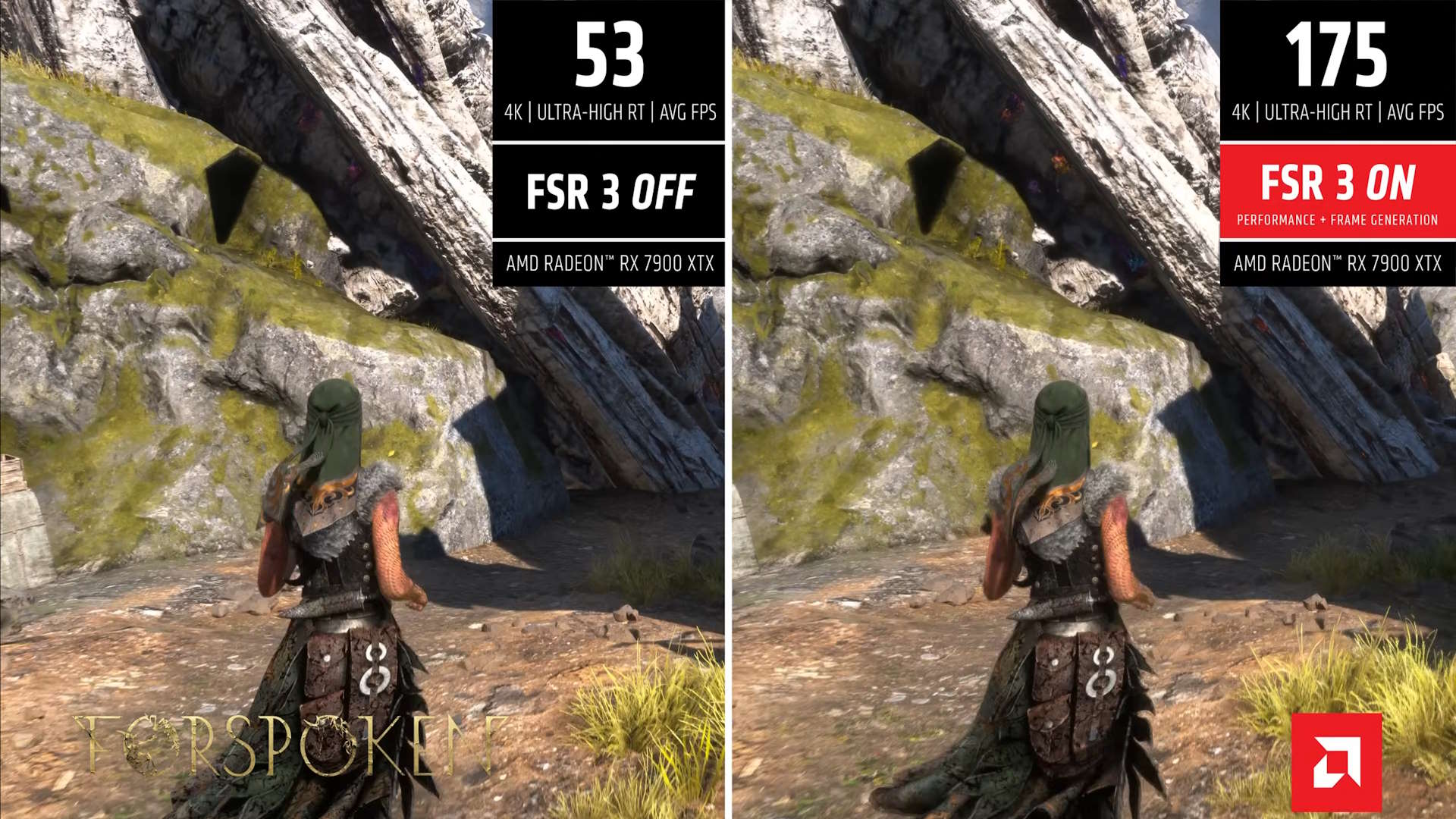

Technologie FSR 3 Reifengeneration Es ähnelt sehr der DLSS-Framegenerierungstechnologie von NVIDIA. Abgesehen von einigen Namensänderungen beinhaltet diese Technologie ebenfalls eine Kombination aus Optische Flussanalyse وBewegungsvektorenAus offensichtlichen Gründen benötigen beide Technologien die Unterstützung von Spieleentwicklern.

- Benötigt Entwicklerunterstützung die Spiele

- يستخدم mischen من Optische Flussanalyse وBewegungsvektoren

- Es kann auf Grafikprozessoren der Serie aktiviert werden. RX 5000/6000 وRTX 20/30/40

- Nicht möglich Implementierung auf Fahrerprogramm-Ebene

Anomalie: AMD Fluid Motion Frames (AFMF)

Am ehesten vergleichbar mit einem vom Bediener definierten Rahmengenerator ist: AMD Fluid Motion-RahmenAFMF interagiert in keiner Weise mit dem Spiel. Es ist abhängig. rein على Optische FlussanalyseOder die Vorhersage des nächsten Bildes.

Dadurch funktioniert es mit allen Adressen. DirectX 11/12 Praktisch benötigt es keine zusätzliche Software. AFMF erhöht zwar nicht die Bildrate, lässt das Spiel aber flüssiger wirken, da Sie ein Plus an Bildern pro Sekunde auf Ihrem Bildschirm sehen.

Was ist also der Nachteil? Nun, AFMF kann mit DLSS FG oder FSR FG nicht annähernd mithalten. Außerdem müssen Benutzer mit Darstellungsfehlern in der Benutzeroberfläche leben. Da es jedoch auf Hardwareebene arbeitet, ist es eine sehr gute Option, wenn man bereit ist, mit möglichen Fehlern umzugehen.

- لا يتطلب Unterstützung von Spieleentwicklern

- يستخدم Nur optische Flussanalyse

- Es unterstützt ausschließlich Grafikprozessoren. RDNA2 oder neuer

- Arbeiten rein على Operatordefinitionsebene

Wird NVIDIA auf AFMF reagieren?

Die naheliegende Antwort ist:Wir wissen nicht„Weil NVIDIA zu einer solchen Option noch keine Stellungnahme abgegeben hat.“ Aaron Steinman AMD glaubt, dass ihr Schritt NVIDIA dazu veranlassen wird, bald etwas Ähnliches wie AFMF zu entwickeln.

„Ich bin gespannt, ob NVIDIA nun der Meinung ist, dass es dem Beispiel von uns folgen und einige dieser Lösungen treiberdefiniert gestalten sollte.“

Aaron Steinmanfür PC Gamer

Interessanterweise haben wir noch keine NVIDIA-Version von AFMF gesehen, insbesondere nachdem stolz verkündet wurde, dass die RTX-40-Serie diese Funktion enthalten würde. Optischer Flussbeschleuniger Besser im Vergleich zu Ampere (RTX 30). Dies war der Hauptgrund, warum NVIDIA FG (unter Verwendung von optischem Fluss + Bewegungsvektoren) nur auf der RTX 30 aktiviert werden konnte. Ada Lovelace.

Andererseits müsste NVIDIA für dieses Projekt möglicherweise ein weiteres Modell von Grund auf trainieren, was erhebliche zusätzliche Kosten verursachen würde.

Lohnt es sich wirklich?

Die Frame-Generierung mittels optischer Flussanalyse und Bewegungsvektoren ist nicht ohne Nachteile. Eingabeverzögerung Die Auswirkungen dieser Funktionen machen sie für Gamer äußerst unattraktiv. Treiberbasiertes AFMF ist jedoch nicht besser, da es durch Interpolation die Bildrate (FPS) verringert und zudem inkonsistent sowie anfällig für visuelle Probleme und Fehler ist.

Die bessere Frage lautet:Sollte NVIDIA nicht zuerst die DLSS-Framegenerierung verbessern?Da sich KI tendenziell mit der Zeit verbessert, dürfte das Latenzproblem weitgehend gelöst sein. Sofern NVIDIA nicht strikt an seine Datenmodelle gebunden ist, dürfte die Entwicklung einer Frame-Generierungslösung (FG) auf Treiberebene nicht schwierig sein, aber lohnt sich der Aufwand?

Wird es sinnlos sein?

Wo würde NVIDIA standardmäßig seine Version von AFMF einsetzen? NVIDIA wird diese Funktion wahrscheinlich auf GPUs der 500er-Serie beschränken. RTX 40 Oder höher, was selbst schon leistungsstark genug ist, um ältere Spiele mit exzellenten Bildraten auszuführen. Oft Zu den neuesten Spielen gehören Unterstützung für DLSS 3 FG / FSR 3 FG.

تعد Mobile Grafikprozessoren (GPUs) Ein anderer Fall, aber ein Ansatz auf Treiberebene wäre für ältere Architekturen wie z. B. sehr nützlich. Pascal Und Maxwell Und Kepler Und FermiLeider ist es aus technischen Gründen praktisch unmöglich, diese Funktion auf diese Geräte auszuweiten. Ihnen fehlt die entsprechende Funktionalität. TensorkerneCUDA kann unterdessen nicht viel ausrichten. Selbst AFMF funktioniert nur mit RDNA2 oder späteren Versionen.

Hoffnungen für die RTX 50 „Blackwell“

Gerüchten zufolge wird eine Serie erscheinen RTX 50 Zum ersten Mal in Viertes Quartal 2024Es ist mit zahlreichen Ankündigungen zu rechnen, die möglicherweise eine universelle Lösung zur Frame-Generierung beinhalten. Trotz der erwarteten Hardware-Bindung an die RTX 40/50-Serie ist NVIDIA nicht dafür bekannt, in irgendeinem Bereich hinterherzuhinken. Dies ist jedoch reine Spekulation.Es gibt keine Gerüchte. Dies bezieht sich auf entsprechende Pläne von NVIDIA.

Fazit

Künstliche Intelligenz (KI) hat zwar ein beispielloses Wachstum erlebt, doch um KI-Inferenz und -Beschleunigung zu ermöglichen, ist leistungsstarke Hardware erforderlich. Sind die GPU-Kerne nicht schnell genug, ist Echtzeit-Frame-Interpolation schlichtweg unmöglich. Zwar ließe sich diese Verarbeitung auf einen Server auslagern, doch das würde ein Abonnement erfordern und zu sehr hohen Latenzzeiten führen. Für GPU-Hersteller ist es daher wichtig, ein ausgewogenes Verhältnis zu finden. Was denken Sie darüber? Teilen Sie uns Ihre Meinung in den Kommentaren mit.

häufige Fragen

Was ist treiberbasierte Frame-Generierung in einfachen Worten?

Vereinfacht ausgedrückt ist die Frame-Generierung auf Definitionsebene eine universelle Lösung zur Erzeugung von Frames innerhalb von Frames, ohne dass die Unterstützung von Spieleentwicklern erforderlich ist.

Falls diese Lösung jemals veröffentlicht wird, wird NVIDIA seine Lösung zur Frame-Generierung auf Treiberebene (FG) auf GPUs der RTX 40-Serie oder höher beschränken?

Höchstwahrscheinlich ja. Da DLSS 3 FG aufgrund seines neuen „Optical Flow Accelerator“ GPUs der RTX 40-Serie benötigt, ist zu erwarten, dass offizielle treiberbasierte Lösungen ähnliche Anforderungen stellen.

Wird die RTX-50-Serie die Frame-Generation-Technologie, wie wir sie kennen, revolutionieren?

Es gibt dazu keine bestätigten Gerüchte. Die Zeit wird es zeigen, insbesondere da die meisten von uns vor NVIDIAs Ankündigung vor zwei Jahren mit der Frame-Generation-Technologie nicht vertraut waren.

Kommentare sind geschlossen.